万方数据

万方数据

1468

小型微型计算机系统2010年

4技术应用

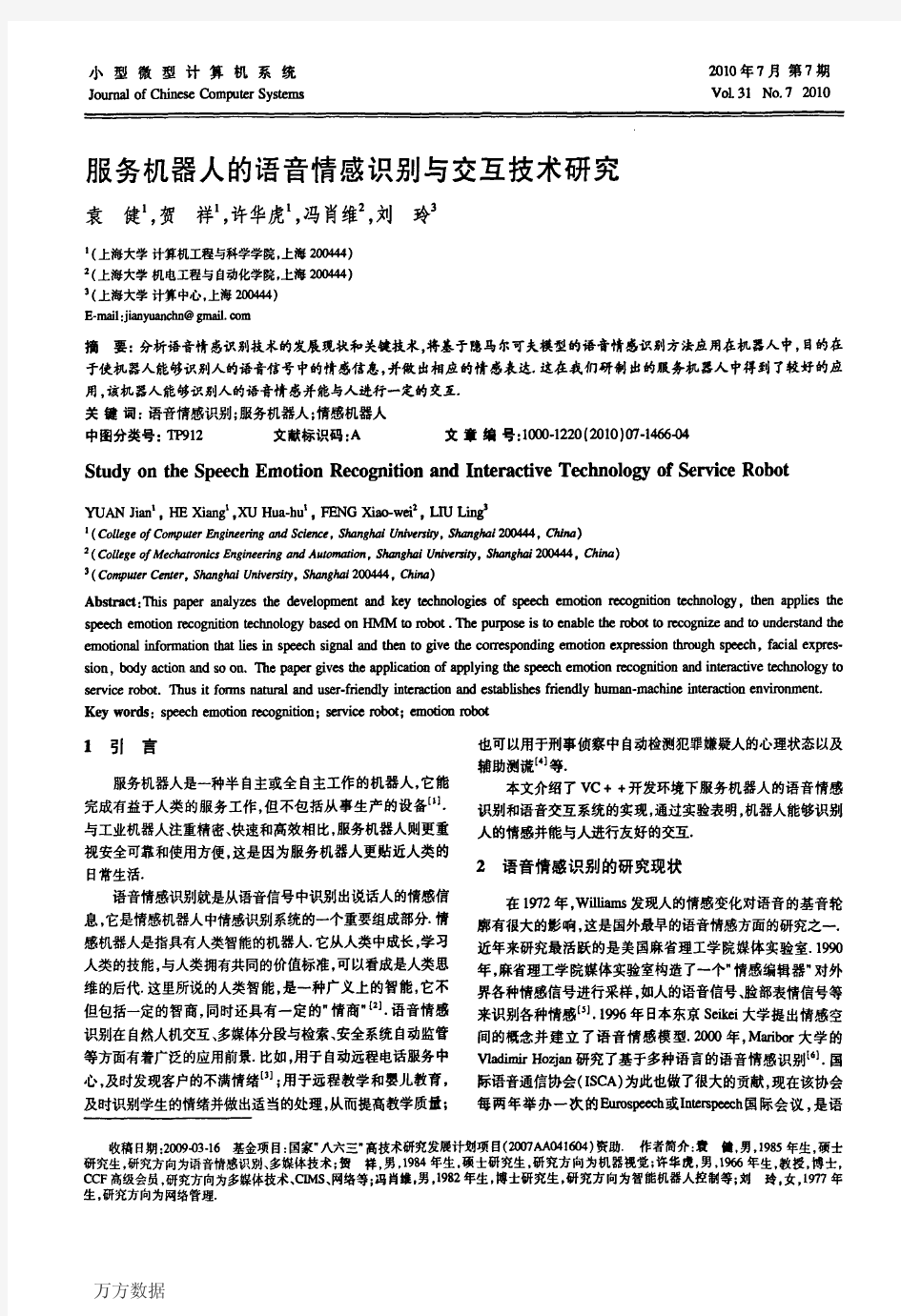

4.1机器人平台介绍

本文将语音情感识别技术应用在国家”八六三“高技术

研究发展计划项目”家庭生活支援多机器人系统”的语音子

系统中,验证了语音情感特征提取和情感识别方法的有效性.该机器人的头部能够实现眼球的转动、眼睑的闭合、嘴的闭合、头部的转动等并能做出基本的表情.机器人的结构设计和系统设计完全根据生理学人体结构来设计,控制系统采用上下位机结构.机器人的移动部分使用两轮差动机构进行驱动,并且配有两个6自由度的手臂,可以进行复杂操作.上位机采

电源L

毪。

-——z==一

—包QQ翻

麦克风卜上位监控PC

-—====—??J

摄像头卜

............一

———1—一I

工业现场总线

l

自囱审豳豳囱囱

图2机器人平台构成

Fig.2

Theslructureofrobot

p/afform

用工业PC机,主要负责导航、身体的协调控制、语音情感的识别、语音识别和语音合成等工作;下位机是基于现场总线的集散式控制模块,主要负责传感器信息接收及初级处理、电机驱动和运动控制等工作.监控模块与各执行机构之间通过传感系统进行联系,上位机和下位机通过局域网进行连接和通信.用户可以通过网络、手机、无线麦克风等方式实现对该机器人的控制,以此满足各种家庭信息的需求.通过下位监控模块的感知,机器人上位监控程序针对不同的语音输人识别出不同的情感状态,从而做出不同的情感表达和交互.如图2为机器入平台构成.

图3实验系统主界面

Hg.3

Themaininterfaceofexperimentalsystem

4.2机器人语音情感识别系统实验过程

本实验主要完成机器人对语音信号的情感的识别,使人

与机器人之间可以完成情感和语音的交互,同时可使机器人听从人的指挥完成一定的任务.如图3为语音情感识别实验系统主界面.

在语音情感识别实验中,首先邀请8名大学生参加录音。

录音者均为表演专业学生.所录制语料经过4名非录音者进行听辨实验,去除了其中30%左右情感类型不明显的语料,

挑选出共计550条语料用于测试,其中包含高兴,伤心,生气,

害怕,惊讶5类情感语料各110句左右,组成了录制情感语音数据库,录制格式为llKHz,16bit的单声道WAV音频格式;然后进行语音信号的特征提取并通过本文隐马尔可夫模型识别方法对语音中的情感进行识别和计算;同时语音识别模块会识别出语音中包含的文字信息,这样机器人可以根据文字和情感信息来与用户进行更人性化的交流.4.3实验结果分析与比较

表l实验结果表明,伤心的识别率为86.4%,生气的识

别率为73.6%,其他三种情感的识别率略低,平均识别率为69.8%,还是比较理想的.

表1语音情感识别实验结果

Table1

Theresultof

experiment

文献[14]研究了基音频率、振幅能量和共振峰等目前常

用的情感特征在语音情感识别中的作用,重点研究了加1。C

和AMFCC,将处理后的频谱特征参数同原有的BP人工神经网络模型有效地结合起来,形成完整的语音情感识别系统。取得了64.4%的平均识别率.该方法对于生气、高兴、伤心、害怕的识别率分别达到了64.5%、54.9%、83.3%、55.0%。而本

图4语音交互模块框图

Fig.4

The

diagramofspeechinteractionmodule

文中的识别方法对这几种情感的识别率都有所提高,平均识

别率也提高了5.4%.文献[15]利用模糊熵理论来分析语音信号情感特征参数相对于识别情感模式的不确定度,提出了

一种利用模糊熵对情感参数有效性进行度量的方法,并将参

数有效性分析结合模糊综合判别对情感语音信号作情感识

万方数据

万方数据

服务机器人的语音情感识别与交互技术研究

作者:袁健, 贺祥, 许华虎, 冯肖维, 刘玲, YUAN Jian, HE Xiang, XU Hua-hu, FENG Xiao-wei, LIU Ling

作者单位:袁健,贺祥,许华虎,YUAN Jian,HE Xiang,XU Hua-hu(上海大学,计算机工程与科学学院,上海200444), 冯肖维,FENG Xiao-wei(上海大学,机电工程与自动化学院,上海200444), 刘玲

,LIU Ling(上海大学,计算中心,上海200444)

刊名:

小型微型计算机系统

英文刊名:JOURNAL OF CHINESE COMPUTER SYSTEMS

年,卷(期):2010,31(7)

参考文献(25条)

1.肖雄军.蔡自兴服务机器人的发展 2004(6)

2.谷学静.石志国.王志良基于BDI Agent技术的情感机器人语音识别技术研究 2003(4)

3.Batliner A.Fischer K.Huber R How to find trouble in communication 2003(1-2)

4.Cowie R.Douglas-Cowie E.Tsapatsonlis N Emotion recognition in human-computer interaction 2001(1)

5.Chennoukh S.Gerrits A.Miet G Speech enhancement via frequency extension using spectral frequency 2001

6.Chen Jian-xin An overview on speech emotion recognition 2003

7.赵力.钱向民.邹采荣.吴镇扬语音信号中的情感识别研究 2001(7)

8.林奕琳.韦岗.杨康才语音情感识别的研究进展 2007(1)

9.Bhatti M W.Wang Y.Guan L A neural network approach for human emotion recognition in speech 2004

10.Zhao Li.Kobayashi Y.Niimi Y Tone recognition of Chinese continuous speech using continuous HMMs 1997(12)

11.詹永照.曹鹏语音情感特征提取和识别的研究与实现 2005(1)

12.Zhou Di-wei Computer speech signal processing 1987

13.Yu Ling-li.Cai Zi-xing.Chen Ming-yi Study on emotion feature analysis and recognition in speech signal:an Overview 2007(4)

14.石瑛.胡学钢基于神经网络的语音情感识别 2008(24)

15.王治平.赵力.邹采荣利用模糊熵进行参数有效性分析的语音情感识别 2003(3)

16.肖雄军.蔡自兴服务机器人的发展 2004(6)

17.谷学静.石志国.王志良基于BDI Agent技术的情感机器人语音识别技术研究 2003(4)

18.陈建厦语音情感识别综述 2003

19.赵力.钱向民.邹采荣.吴镇扬语音信号中的情感识别研究 2001(7)

20.林奕琳.韦岗.杨康才语音情感识别的研究进展 2007(1)

21.詹永照.曹鹏语音情感特征提取和识别的研究与实现 2005(1)

22.周迪伟计算机语音处理 1987

23.余伶俐.蔡自兴.陈明义语音信号的情感特征分析与识别研究综述 2007(4)

24.石瑛.胡学钢基于神经网络的语音情感识别 2008(24)

25.王治平.赵力.邹采荣利用模糊熵进行参数有效性分析的语音情感识别 2003(3)

本文链接:https://www.doczj.com/doc/797990937.html,/Periodical_xxwxjsjxt201007046.aspx

智能机器人的语音识别 语音识别概述 最近,由于其重大的理论意义和实用价值,语音识别已经受到越来越多的关注。到现在为止,多数的语音识别是基于传统的线性系统理论,例如隐马尔可夫模型和动态时间规整技术。随着语音识别的深度研究,研究者发现,语音信号是一个复杂的非线性过程,如果语音识别研究想要获得突破,那么就必须引进非线性系统理论方法。最近,随着非线性系统理论的发展,如人工神经网络,混沌与分形,可能应用这些理论到语音识别中。因此,本文的研究是在神经网络和混沌与分形理论的基础上介绍了语音识别的过程。 语音识别可以划分为独立发声式和非独立发声式两种。非独立发声式是指发音模式是由单个人来进行训练,其对训练人命令的识别速度很快,但它对与其他人的指令识别速度很慢,或者不能识别。独立发声式是指其发音模式是由不同年龄,不同性别,不同地域的人来进行训练,它能识别一个群体的指令。一般地,由于用户不需要操作训练,独立发声式系统得到了更广泛的应用。所以,在独立发声式系统中,从语音信号中提取语音特征是语音识别系统的一个基本问题。 语音识别包括训练和识别,我们可以把它看做一种模式化的识别任务。通常地,语音信号可以看作为一段通过隐马尔可夫模型来表征的时间序列。通过这些特征提取,语音信号被转化为特征向量并把它作为一种意见,在训练程序中,这些意见将反馈到HMM的模型参数估计中。这些参数包括意见和他们响应状态所对应的概率密度函数,状态间的转移概率,等等。经过参数估计以后,这个已训练模式就可以应用到识别任务当中。输入信号将会被确认为造成词,其精确度是可以评估的。整个过程如图一所示。 图1 语音识别系统的模块图

3、理论与方法 从语音信号中进行独立扬声器的特征提取是语音识别系统中的一个基本问题。解决这个问题的最流行方法是应用线性预测倒谱系数和Mel频率倒谱系数。这两种方法都是基于一种假设的线形程序,该假设认为说话者所拥有的语音特性是由于声道共振造成的。这些信号特征构成了语音信号最基本的光谱结构。然而,在语音信号中,这些非线形信息不容易被当前的特征提取逻辑方法所提取,所以我们使用分型维数来测量非线形语音扰动。 本文利用传统的LPCC和非线性多尺度分形维数特征提取研究并实现语音识别系统。 3.1线性预测倒谱系数 线性预测系数是一个我们在做语音的线形预分析时得到的参数,它是关于毗邻语音样本间特征联系的参数。线形预分析正式基于以下几个概念建立起来的,即一个语音样本可以通过一些以前的样本的线形组合来快速地估计,根据真实语音样本在确切的分析框架(短时间内的)和预测样本之间的差别的最小平方原则,最后会确认出唯一的一组预测系数。 LPC可以用来估计语音信号的倒谱。在语音信号的短时倒谱分析中,这是一种特殊的处理方法。信道模型的系统函数可以通过如下的线形预分析来得到: 其中p代表线形预测命令,,(k=1,2,… …,p)代表预测参数,脉冲响应用 h(n)来表示,假设h(n)的倒谱是。那么(1)式可以扩展为(2)式: 将(1)带入(2),两边同时,(2)变成(3)。 就获得了方程(4):

开放实验项目报告 项目名称:语音识别机器人 专业 学生姓名 班级学号 指导教师 指导单位 2012/2013学年第一学期 一.设计背景

在科学日新月异的今天,电子设备的便捷化,人性化,智能化已成为不可逆转的潮流,而语音控制智能,更是其中研究发展的热点。凌阳SPCE061以其便捷的操作,可靠的性能,成为了各位电子爱好者的首选。本实验采用凌阳61板和运动小车(迷你型)模组设计的语音控制小车。凌阳板嵌入小车模型顶部。语音处理技术不仅包括语音的录制和播放,还涉及语音的压缩编码和解码、语音的识别等各种处理技术。本设计的语音控制小车,借助于SPCE061A在语音处理方面的特色,不仅具有前进、后退、左转、右转、停止等基本程序控制功能,而且还具备语音控制功能。 二.总流程图

三.主要模块 1、凌阳SPCE061是继μ’nSP?系列产品SPCE500A等之后凌阳科技推出的又一款16 位结构的微控制器。与SPCE500A不同的是,在存储器资源方面考虑到用户的较少资源的需求以及便于程序调试等功能,SPCE061A里只内嵌32K字的闪存(FLASH )。较高的处理速度使μ’nSP?能够非常容易地、快速地处理复杂的数字信号。因此,与SPCE500A相比,以μ’nSP?为核心的SPCE061A 微控制器是适用于数字语音识别应用领域产品的一种最经济的选择。 其性能如下: A、16 位μ’nSP?微处理器; B、工作电压(CPU) VDD 为2.4~3.6V (I/O) VDDH 为2.4~5.5V C、CPU 时钟:0.32MHz~49.152MHz ; D、内置2K 字SRAM; E、内置32K FLASH; F、可编程音频处理; G、晶体振荡器; H、系统处于备用状态下(时钟处于停止状态),耗电仅为2μA@3.6V ; I、2 个16 位可编程定时器/计数器(可自动预置初始计数值); J、2 个10 位DAC(数-模转换)输出通道; K、32 位通用可编程输入/输出端口; L、14 个中断源可来自定时器A / B ,时基,2 个外部时钟源输入,键唤醒;

信息学院 《人工智能及其应用》课程论文题目:基于神经网络的语音信号识别 作者黄超班级自动08-1BF班 系别信息学院专业自动化 完成时间 2011.6.12

基于神经网络的语音信号识别 摘要 语言是人类之间交流信息的主要手段之一,自电脑发明以来,人们就一直致力于使电 脑能够理解自然语言。语音识别技术是集声学、语音学、语言学、计算机、信息处理和人工 智能等诸领域的一项综合技术,应用需求十分广阔,长期以来一直是人们研究的热点。 神经网络是在现代科学研究成果的基础上提出来的模拟人脑结构机制的一门新兴科 学,它模拟了人类神经元活动的原理,具有自学习、联想、对比、推理和概括能力,为很好 地解决语音识别这样一个复杂的模式分类问题提供了新的途径。 本文针时语音识别的特点.对BP神经网络在语音识别技术中的应用进行了探索性研究, 进而结合人工智能领域较为有效的方法——遗传(GA)算法。针对传统BP算法识别准确率高 但训练速度慢的缺点,对BP网络进行改进,构建了一种基于遗传神经网络的语音识别算法(GABP),并建立相应的语音识别系统。仿真实验表明,该算法有效地缩短了识别时问,提 高了网络训练速度和语音的识别率。 关键词:语音识别,神经网络,遗传算法,遗传神经网络,BP网络 THE RSREARCH OF SPEECH RECOGNITION BASED ON THE NEURAL NETWORK ABSTRACT Language is one of the most important means of exchanging information among the mankind.Since the computer was invented,many scientists have been devoted to enabling the computer to understand the natural language.Speech recognition is a comprehensive technology of such areas as acoustics,phonetics,linguistics,computer science,information processing and artificial intelligence,which can be used widely.The research of speech recognition technology has been focused by the world for a long time.The neural network is a new developing science,which simulates the mechanism of human brain and was putted forward by the developing of modern science.It is not the overall description of human brain,but the abstract,simulation and simplifying of the physical neural networks of human beings. The purpose of the research in this area is exploring the human brain mechanisms in information processing,storing and searching.If people can understand these mechanisms,a new way for the research of artificial intelligence,information processing and etc.

计算机科学与信息工程学院《人机交互》课程 小论文 2014年6月

语音识别 1、语音识别的背景与意义 语音识别是解决机器“听懂”人类语言的一项技术。作为智能计算机研究的主导方向和人机语音通信的关键技术,语音识别技术一直受到各国科学界的广泛关注。 随着现代科学的发展,人们在与机器的信息交流中,需要一种更加方便、自然的方式,而语言是人类最重要、最有效、最常用和最方便的通信形式。这就很容易让人想到能否用自然语言代替传统的人机交流方式(如键盘、鼠标等)。人机自然语音对话就意味着机器应具有听觉,能“听懂”人类的口头语言,这就是语音识别(Speech Recognition)的功能。语音识别是语音信号处理的重要研究方向之一,它是一门涉及面很广的交叉学科,与计算机、通信、语音语言学、数理统计、信号处理、神经生理学、神经心理学、模式识别、声学和人工智能等学科都有密切的联系。它还涉及到生理学、心理学以及人的体态语言。 2、语音识别系统 语音识别本质上是一种模式识别的过程,未知语音的模式与已知语音的参考模式逐一进行比较,最佳匹配的参考模式被作为识别结果。图1是基于模式匹配原理的自动语音识别系统原理框图。 (1)预处理模块:对输入的原始语音信号进行处理,滤除掉其中的不重要的信息以及背景噪声,并进行语音信号的端点检测、语音分帧以及预加重等处理。 (2)特征提取模块:负责计算语音的声学参数,并进行特征的计算,以便提取出反映信号特征的关键特征参数用于后续处理。现在较常用的特征参数有线性预测(LPC)参数、线谱对(LSP)参数、LPCC、MFCC、ASCC、感觉加权的线性预测(PLP)参数、动态差分参数和高阶信号谱类特征等[1]。其中,Mel频率倒谱系数(MFCC)参数因其良好的抗噪性和鲁棒性而应用广泛。 (3)训练阶段:用户输入若干次训练语音,经过预处理和特征提取后得到特征矢量参数,建立或修改训练语音的参考模式库。

毕业论文(设计) 题目语音识别机器人的设计 系部电子信息工程 专业电子信息工程年级 06级学生姓名 学号 指导教师 语音识别机器人的设计

【摘要】语音识别可划分为训练和识别两个过程。在第一阶段,语音识别系统对人类的语言进行学习,把学习内容组成语音库存储起来,在第二阶段就可以把当前输入的语音在语音库中查找相应的词义或语义。凌阳16位SPCE061A单片机内嵌32K字闪存,2K字SRAM,内置10位ADC、DAC,有多达14个的中断源。它的CPU内核采用16位具有DSP功能的微处理器芯片, 而且CPU可最高工作在49MHz的主频下,能够非常容易地、快速地处理复杂的数字信号,因此与其他类型的单片机相比,在数字语音处理方面SPCE061A更具有优势。基于SPCE061A设计了一个具有语音识别功能的机器人。经过训练,训练人可使用各种命令让机器人完成许多有趣的动作,使得人机交互更具智能化。 【关键词】SPCE061A单片机语音识别机器人

The Design of the Speech Recognition Robot 【Abstract】The speech recognition is divided into two stages, namely, training and recognition. At the first stage, the speech recognition system learns about the language and stores what it a speech database. Then at the next stage, the meaning of each inputted speech can immediately be found in the speech database.Sunplus 16-bit SPCE061ASCM is embedded with 32K word Flash and 2K word SRAM, with built-in 10-bit ADC and DAC as well as more than 14 interrupt sources. The core of its CPU is a 16-bit microprocessor chip which of DSP. Besides, the CPU can work with a frequency up to 49 MHz, and process complex digital signals easily and quickly. Therefore, compared with other types of SCM, SPCE061A speech processing. Based on SPCE061A, a speech recognition robot designed. After training, the robot can complete many interesting actions according to the orders, which makes the -computer interaction more intelligent. 【Key words】SPCE061A SCM Speech Recognition Robot 目录

深度解析智能语音机器人的常见问题 一般智能语音机器人会自动处理以下问题:语音识别、语义分析、智能交互,实现对话交互策略。人工辅助过于复杂或者必须通过人工干预的通话转交给对应技能座席。今天我们一起来了解下深度解析电话机器人的常见问题。 一、什么是智能语音机器人? 智能语音机器人是一种运用于电话营销领域的电话机器人,它是通过ASR(语音识别)和TTS(文本转录音)模拟真人和用户通话,可以真人预先录音,用户很难察觉到是机器人。 二、市面上ASR接口有哪些? 智能语音机器人主要ASR接口供应商有科大讯飞,百度语音识别,阿里云语音识别,腾讯语音识别等,有SDK/API/MRCP类接口。智能语音机器人采用的是在讯飞研究院科学家研制的*版语音识别引擎,能精准识别反映客户意愿的词汇,快速划分非意向与意向,语音识别率达到了95%,不误判客户意向,避免浪费您的宝贵号码资源、浪费人力跟进非意向客户,同时对环境噪音、客户口音均有良好的适应能力。 三、智能语音机器人由哪些部分组成? 语音识别引擎≠电销机器人,语音识别能力是电销机器人重要的组成,但并非*,智能语音机器人还需要将呼叫平台(保证呼叫稳定)、电话线路、话术体系、操作后台集成在云端,达到直接在web上登陆操作目的,至此可以理解为一台“汽车”的硬件造好了。 但是汽车的性能怎么样,还需要检测关键技术指标、跑几下(各种测试),配置上软件(电销机器人的话术还没有配好)。因此,用讯飞技术≠智能语音机器人,如果用**技术就等于**牌子,那么所有的电脑都应该叫intel英特尔电脑,还有戴尔、联想什么事。

四、智能语音机器人为什么按路收费? 一个智能语音机器人研发好了,理论上可以支持N路并发(开一个接口就是一个机器人),主要的瓶颈是语音识别。免费的ASR一般*几万次,量大是需要付费使用的。一个智能语音机器人对接一路识别语音引擎(向ASR公司付费)、对应一条外呼线路(通信运营商向你收取),因此按路收费。有了这些机器人才能听懂话、打出去电话。 五、智能语音机器人话术系统是怎样一回事? 做话术≠做录音,如果没有对客户说话的正确理解,只是播放录音,没有互动,体验怎么能好。智能语音机器人建立在数据的基础上,智能语音机器人话术定制涉及到机器人语言设计、知识库的丰富,方便机器人理解,同时经过大量测试,保证准确理解客户的回复。 总结 智能语音机器人对于销售工作的开展无疑是提高效率的,工具虽然好,但也要了解怎么使用,更要知道正确使用的方向。

语音识别技术的现状与未来 The Present and Future of Speech Recognition (CSLT-TRP-20160034) 王东(Dong Wang) 2017/01/08 CSLT, RIIT, Tsinghua Univ.

语音识别任务及其研究意义 语音识别(Automatic Speech Recognition, ASR)是指利用计算机实现从语音到文字自动转换的任务。在实际应用中,语音识别通常与自然语言理解、自然语言生成和语音合成等技术结合在一起,提供一个基于语音的自然流畅的人机交互方法。 早期的语音识别技术多基于信号处理和模式识别方法。随着技术的进步,机器学习方法越来越多地应用到语音识别研究中,特别是深度学习技术,它给语音识别研究带来了深刻变革。同时,语音识别通常需要集成语法和语义等高层知识来提高识别精度,因此和自然语言处理技术息息相关。另外,随着数据量的增加和机器计算能力的提高,语音识别越来越依赖数据资源和各种数据优化方法,这使得语音识别与大数据、高性能计算等新技术产生广泛结合。综上所述,语音识别是一门综合性应用技术,集成了包括信号处理、模式识别、机器学习、数值分析、自然语言处理、高性能计算等一系列基础学科的优秀成果,是一门跨领域、跨学科的应用型研究。 语音识别研究具有重要的科学价值和社会价值。语音信号是典型的局部稳态时间序列,研究这一信号的建模方法具有普遍意义。事实上,我们日常所见的大量信号都属于这种局部稳态信号,如视频、雷达信号、金融资产价格、经济数据等。这些信号的共同特点是在抽象的时间序列中包括大量不同层次的信息,因而可用相似的模型进行描述。历史上,语音信号的研究成果在若干领域起过重要的启发作用。例如,语音信号处理中的隐马尔可夫模型在金融分析、机械控制等领域都得到了广泛应用。近年来,深度神经网络在语音识别领域的巨大成功直接促进了各种深度学习模型在自然语言处理、图形图象处理、知识推理等众多应用领域的发展,取得了一个又一个令人惊叹的成果。 在实用价值方面,语音交互是未来人机交互的重要方式之一。随着移动电话、穿戴式设备、智能家电等可计算设备的普及,基于键盘、鼠标、触摸屏的传统交互方式变得越来越困难。为了解决这种困难,手势、脑波等一系统新的人机交互方式进入人们的视野。在这些五花八门的新兴交互方式中,语音交互具有自然、便捷、安全和稳定等特性,是最理想的交互方式。在语音交互技术中,语音识别是至关重要的一环:只有能“听懂”用户的输入,系统才能做出合理的反应。今天,语音识别技术已经广泛应用在移动设备、车载设备、机器人等场景,在搜索、操控、导航、休闲娱乐等众多领域发挥了越来越重要的作用。随着技术越来越成熟稳定,我们相信一个以语音作为主要交互方式的人机界面新时代将很快到来。 研究内容和关键科学问题 语音识别研究主要包括如下三方面内容:语音信号的表示,即特征抽取;语音信号和语言知识建模;基于模型的推理,即解码。语音信号的复杂性和多变性使得这三方面的研究都面临相当大的挑战。图1给出一个语音识别系统的典型架构。

智能机器人语音识别技术 姓名:李占博 学号:201215715

关键词:智能机器人;语音识别;隐马尔可夫模型 DSP 摘要:给出了一种由说话者说出控制命令,机器人进行识别理解,并执行相应动作的实现技术。在此,提出了一种高准确率端点检测算法、高精度定点DSP动态指数定标算法,以解决定点DSP实现连续隐马尔科夫模型CHMM识别算法时所涉及的大量浮点小数运算问题,提高了定点DSP实现的实时性、精度,及其识别率。 关键词:智能机器人;语音识别;隐马尔可夫模型;DSP 1 语音识别概述 语音识别技术最早可以追溯到20世纪50年代,是试图使机器能“听懂”人类语音的技术。按照目前主流的研究方法,连续语音识别和孤立词语音识别采用的声学模型一般不同。孤立词语音识别一般采用DTW动态时间规整算法。连续语音识别一般采用HMM模型或者HMM与人工神经网络ANN相结合。 语音的能量来源于正常呼气时肺部呼出的稳定气流,喉部的声带既是阀门,又是振动部件。语音信号可以看作是一个时间序列,可以由隐马尔可夫模型(HMM)进行表征。语音信号经过数字化及滤噪处理之后,进行端点检测得到语音段。对语音段数据进行特征提取,语音信号就被转换成为了一个向量序列,作为观察值。在训练过程中,观察值用于估计HMM 的参数。这些参数包括观察值的概率密度函数,及其对应的状态,状态转移概率等。当参数估计完成后,估计出的参数即用于识别。此时经过特征提取后的观察值作为测试数据进行识别,由此进行识别准确率的结果统计。训练及识别的结构框图如图1所示。

1. 1 端点检测 找到语音信号的起止点,从而减小语音信号处理过程中的计算量,是语音识别过程中一个基本而且重要的问题。端点作为语音分割的重要特征,其准确性在很大程度上影响系统识别的性能。 能零积定义:一帧时间范围内的信号能量与该段时间内信号过零率的乘积。 能零积门限检测算法可以在不丢失语音信息的情况下,对语音进行准确的端点检测,经过450个孤立词(数字“0~9”)测试准确率为98%以上,经该方法进行语音分割后的语音,在进入识别模块时识别正确率达95%。 当话者带有呼吸噪声,或周围环境出现持续时间较短能量较高的噪声,或者持续时间长而能量较弱的噪声时,能零积门限检测算法就不能对这些噪声进行滤除,进而被判作语音进入识别模块,导致误识。图2(a)所示为室内环境,正常情况下采集到的带有呼气噪声的数字“0~9”的语音信号,利用能零积门限检测算法得到的效果示意图。最前面一段信号为呼气噪声,之后为数字“0~9”的语音。

一单项选择题 1 下述基本人机交互技术中,主要用于输入一个数值的人机交互技术是(C)。 A:定位B:笔划C:定值D:选择E:字符串输入 2 下述人机交互技术中,不属于图形人机交互技术的是(C )。A:几何约束B:引力场C:语音识别D:橡皮筋技术 3 下列各种模型中,用于描述交互操作的人机交互界面行为模型的是(D)。 A:GOMS模型B:LOTOS模型C: UAN模型D:状态转换网络4 使用从行为模型到结构模型的转换算法得到的人机界面结构模型中,不可能包含的事件类型为(C)。 A:用户事件B:内部事件C:系统事件D:外部事件 5 在将人机界面的行为模型向结构模型转换时,只有在处理(C )运算符时才会向模型中加入一个终止态。 A: ||| B: [] C: [> D: >> 二基本概念 // 1 简述人机交互的基本能概念和主要研究内容有哪些。 人机交互(Human-Computer Interaction,HCI)是关于设计、评价和实现供人们使用的交互式计算机系统,且围绕这些方面的主要现象进行研究的科学。 人机交互的主要研究内容包括 人机交互界面表示模型与设计方法(Model and Methodology)

可用性分析与评估(Usability and Evaluation)。 多通道交互技术(Multi-Modal) 认知与智能用户界面(Intelligent User Interface,IUI) 群件(Groupware) Web设计(Web-Interaction) 移动界面设计(Mobile and Ubicomp) //2 简述人机交互技术经历了那几个主要阶段?各阶段的主要特点? 语言命令交互阶段:特点是用户以命令行的方式与计算机进行交互。这个阶段是最早期交互阶段。 图形用户界面(GUI)交互阶段:主要特点是桌面隐喻、WIMP 技术、直接操纵和“所见即所得”。 自然和谐的交互阶段:主要特点是使用基于语音、手写体、姿势、视线跟踪、表情等多种输入手段的多通道交互,其目的是使人能以声音、动作、表情等自然方式进行交互操作。// 3 简述人机交互技术有哪些应用领域? 人机交互技术的应用领域几乎涵盖的当前人类社会的所有领域,主要领域包括制造业、教育科研、军事、日常生活、文化娱乐和体育等多个领域。 // 4 简述Norman认知模式的概念,说明认知模式的划分对人机交互系统设计的指导意义。 Norman把认知模式划分为经验认知模式和思维认知模式。其中

语音识别机器人制作 编辑:robotain 来源:网络2009-12-06 发表评论 方案简介说明书 1 方案概述 语音识别机器人可以充分发挥学生的创新能力,增加学生的动手实践能力,增加学生学习单片机的兴趣爱好。本方案以SPCE061A 单片机为核心,改装市场上的玩具机器人,使改装后的机器人具有语音识别能力,根据识别的语音完成跳舞等动作,这也是智能机器人的一个方面。 1.1 设计要求 利用SPCE061A 单片机、机器人机体(包括2 个用于走路的电机、1 个用于头部旋转的电机、1 个用于加速1 个用于弹射的电机等),要求语音识别机器人具有下述功能: 1. 通过语音命令对其进行控制。 2. 两种跳舞模式。 3. 走步功能、转向功能、转头功能。 4. 发射飞盘功能。 1.2 技术要求 1. 要求语音识别机器人可以识别15 条命令。 2. 要求语音识别机器人具有2 种跳舞模式。 2 方案设计简介 2.1 硬件框图 系统以SPCE061A 为核心,结合机器人机体,如下图所示。

2.2 功能框图 SPCE061A 应用方案 SPCE061A 在语音识别机器人中的应用

在现代社会机器人这个词语已经不再新鲜,而且形形色色的机器人出现在我们的日常生活中。为了提高广大单片机爱好者学习单片机的兴趣与爱好,凌阳科技大学计划教育推广中心推出了应用SPCE061A 控制的兴趣产品语音识别机器人,本文对语音识别机器人的软硬件制作进行介绍。 1 引言 为了提高广大单片机爱好者学习单片机的兴趣,凌阳科技大学计划教育推广中心推出了应用SPCE061A 作为主控制器,外加电机驱动电路制作的语音识别机器人。该机器人采用特定人语音识别对机器人进行控制,可以完成向前走、倒退、左转、右转、跳两首舞曲、向左瞄准、向右瞄准、发射、连续发射等功能。该语音识别机器人可以大大提高在校学生学习单片机的兴趣。 2 设计要求 2.1 设计要求 利用SPCE061A 单片机、机器人机体(包括2 个用于走路的电机、1 个用于头部旋转的电机、1个用于加速1 个用于弹射的电机等),要求语音识别机器人具有下述功能: 通过语音命令对其进行控制。 两种跳舞模式。 走步功能、转向功能、转头功能。 发射飞盘功能。 2.2 技术要求 要求智能机器人可以识别15 条命令。 要求智能机器人具有2 种跳舞模式。 模组特性简介 3.1 SPCE061A 特性简介 SPCE061A 是凌阳科技研发生产的性价比很高的一款十六位单片机,使用它可以非常方便灵活的实现语音的录放系统,该芯片拥有8 路10 位精度的ADC,其中一路为音频转换通道,并且内置有自动增益电路。这为实现语音录入提供了方便的硬件条件。两路10 精度的DAC,只需要外接功放(SPY0030A)即可完成语音的播放。另外凌阳十六位单片机具有易学易用的效率较高的一套指令系统和集成开发环境。在此环境中,支持标准C 语言,可以实现C 语言与凌阳汇编语言的互相调用,并且,提供了语音录放的库函数,只要了解库函数的使用,就会很容

人机交互技术的发展与 现状精编W O R D版 IBM system office room 【A0816H-A0912AAAHH-GX8Q8-GNTHHJ8】

人机交互技术的发展与现状 一. 什么是人机交互技术 二. 人机交互技术(Human-Computer Interaction Techniques)是指通过计算机输 入、输出设备,以有效的方式实现人与计算机对话的技术。人机交互技术包括机器通过输出或显示设备给人提供大量有关信息及提示请示等,人通过输入设备给机器输入有关信息,回答问题及提示请示等。人机交互技术是计算机用户界面设计中的重要内容之一。它与认知学、人机工程学、心理学等学科领域有密切的联系。 也指通过电极将神经信号与电子信号互相联系,达到人脑与电脑互相沟通的技术,可以预见,电脑甚至可以在未来成为一种媒介,达到人脑与人脑意识之间的交流,即心灵感应。二.人机交互技术的发展人机交互的发展历史,是从人适应计算机到计算机不断地适应人的发展史。 1959年美国学者B.Shackel从人在操纵计算机时如何才能减轻疲劳出发,提出了被认为是人机界面的第一篇文献的关于计算机控制台设计的人机工程学的论文。1960年,Liklider JCK首次提出人机紧密共栖(Human-Computer Close Symbiosis)的概念,被视为人机界面学的启蒙观点。 1969年在英国剑桥大学召开了第一次人机系统国际大会,同年第一份专业杂志国际人机研究(IJMMS)创刊。可以说,1969年是人机界面学发展史的里程碑。在1970年成立了两个HCI研究中心:一个是英国的Loughbocough大学的HUSAT研究中心,另一个是美国Xerox公司的Palo Alto研究中心。 1970年到1973年出版了四本与计算机相关的人机工程学专着,为人机交互界面的发展指明了方向。 20世纪80年代初期,学术界相继出版了六本专着,对最新的人机交互研究成果进行了总结。人机交互学科逐渐形成了自己的理论体系和实践范畴的架构。理论体系方面,从人机工程学独立出来,更加强调认知心理学以及行为学和社会学的某些人文科学的理论指导;实践范畴方面,从人机界面(人机接口)拓延开来,强调计算机对于人的反馈交互作用。人机界面一词被人机交互所取代。HCI中的I,也由

创新创业课程教学案例——语音识别客服机器人

一、导言 客服需求蓬勃增长,传统的客服方式已无法适应企业用工、消费服务等方面的需求。客服需求依据语音识别技术形成了巨大的市场。语音识别是一门交叉学科。近二十年来,语音识别技术取得显著进步,开始从实验室走向市场。人们预计,未来10年内,语音识别技术语音识别将会推动物联网的革命,将进入工业、家电、通信、汽车电子、医疗、家庭服务、消费电子产品,以及可穿戴设备等各个领域。 二、用户痛点 在传统的客服服务中,存在着很多不足,如服务质量把控难、培训成本高、人员离职率高、考核成本高等情况。 三、创新原理 语音识别客服机器人实现了全新的语音识别技术,在识别率、连续服务、渠道 等方面,获得了多个方面的创新(图1),提高了企业的服务水平。 采用深度神经网络算法和自然语言处理技术研发而成,实现机器人多轮对话,识别数百种方言,识别率高。 采用在线学习算法,实现智能机器人自适应、动态、增量式的机器自学习能力,能够精准回复重复性或相似的问题。 采用智能机器人、人工客服、工单等完整的三位一体交互切换客服体系,全天不间断服务,节省客服成本。 采用微信、QQ app、WeblM、SDK、微博等渠道,简单快速的接口服务,提供移动式办公,时刻保持在线沟通,提供一致的客户体验。 多维可视化数据分析,包括效率统计、满意度统计、会话统计、工单统计和访客记录统计等,有利于企业更好地挖掘客户信息。

图1语音识别客服系统架构图 四、产品特点 语音识别客服机器人建立了四位一体交互体系(图2),能够更好地进行服务。它具有以下特点: 7×24小时机器人在线,精准回答客户重复性问题。 桌面网页、移动网页、APP等一键接入、多平台统一平台管理。 多维客服数据分析,客观全面考核客服人员KPI。 移动端APP实现客服人员移动办公,让您与客户时刻保持在线沟通。 图2语音识别客服机器人四位一体交互体系 五、应用场景 行政服务中心、银行、中小企业客服、呼叫中心等。 六、创意激发 AiKF爱客服智能机器人技术在时间、空间、人力等方面获得了重大突破,

中英文资料外文翻译 译文: 改进型智能机器人的语音识别方法 2、语音识别概述 最近,由于其重大的理论意义和实用价值,语音识别已经受到越来越多的关注。到现在为止,多数的语音识别是基于传统的线性系统理论,例如隐马尔可夫模型和动态时间规整技术。随着语音识别的深度研究,研究者发现,语音信号是一个复杂的非线性过程,如果语音识别研究想要获得突破,那么就必须引进非线性系统理论方法。最近,随着非线性系统理论的发展,如人工神经网络,混沌与分形,可能应用这些理论到语音识别中。因此,本文的研究是在神经网络和混沌与分形理论的基础上介绍了语音识别的过程。 语音识别可以划分为独立发声式和非独立发声式两种。非独立发声式是指发音模式是由单个人来进行训练,其对训练人命令的识别速度很快,但它对与其他人的指令识别速度很慢,或者不能识别。独立发声式是指其发音模式是由不同年龄,不同性别,不同地域的人来进行训练,它能识别一个群体的指令。一般地,由于用户不需要操作训练,独立发声式系统得到了更广泛的应用。所以,在独立发声式系统中,从语音信号中提取语音特征是语音识别系统的一个基本问题。 语音识别包括训练和识别,我们可以把它看做一种模式化的识别任务。通常地,语音信号可以看作为一段通过隐马尔可夫模型来表征的时间序列。通过这些特征提

取,语音信号被转化为特征向量并把它作为一种意见,在训练程序中,这些意见将反馈到HMM的模型参数估计中。这些参数包括意见和他们响应状态所对应的概率密度函数,状态间的转移概率,等等。经过参数估计以后,这个已训练模式就可以应用到识别任务当中。输入信号将会被确认为造成词,其精确度是可以评估的。整个过程如图一所示。 图1 语音识别系统的模块图 3、理论与方法 从语音信号中进行独立扬声器的特征提取是语音识别系统中的一个基本问题。解决这个问题的最流行方法是应用线性预测倒谱系数和Mel频率倒谱系数。这两种方法都是基于一种假设的线形程序,该假设认为说话者所拥有的语音特性是由于声道共振造成的。这些信号特征构成了语音信号最基本的光谱结构。然而,在语音信号中,这些非线形信息不容易被当前的特征提取逻辑方法所提取,所以我们使用分型维数来测量非线形语音扰动。 本文利用传统的LPCC和非线性多尺度分形维数特征提取研究并实现语音识别系统。 3.1线性预测倒谱系数 线性预测系数是一个我们在做语音的线形预分析时得到的参数,它是关于毗邻语音样本间特征联系的参数。线形预分析正式基于以下几个概念建立起来的,即一个语音样本可以通过一些以前的样本的线形组合来快速地估计,根据真实语音样本在确切的分析框架(短时间内的)和预测样本之间的差别的最小平方原则,最后会确认出唯一的一组预测系数。 LPC可以用来估计语音信号的倒谱。在语音信号的短时倒谱分析中,这是一种特殊的处理方法。信道模型的系统函数可以通过如下的线形预分析来得到:

人机交互技术是指通过计算机输入、输出设备,以有效的方式实现人与计算机对话、交换信息的技术。人们可以借助键盘、鼠标、操作杆、位置跟踪器、数据手套等设备,用手、脚、声音、姿态和身体的动作、视线甚至脑电波等向计算机传递信息;计算机通过打印机,绘图仪、头盔式显示器、音频等输出设备或显示设备给人提供信息。 目前,人机交互技术正处于多通道、多媒体的智能人机交互阶段,已经取得了不少研究成果,不少产品已经问世。侧重多媒体技术的有:触摸式显示屏实现的“桌面”计算机,能够随意折叠的柔性显示屏制造的电子书,从电影院搬进客厅指日可待的3D显示器,使用红绿蓝光激光二极管的视网膜成像显示器;侧重多通道技术的有:“汉王笔”手写汉字识别系统,结合在微软的Tablet PC 操作系统中数字墨水技术,广泛应用于Office/XP的中文版等办公、应用软件中的IBM/Via Voice连续中文语音识别系统,输入设备为摄像机、图像采集卡的手势识别技术,以IPHONE手机为代表的可支持更复杂的姿势识别的多触点式触摸屏技术,以及IPHONE中基于传感器的捕捉用户意图的隐式输入技术。 人机交互技术领域热点技术的应用潜力已经开始展现,比如智能手机配备的地理空间跟踪技术,应用于可穿戴式计算机、隐身技术、浸入式游戏等的动作识别技术,应用于虚拟现实、遥控机器人及远程医疗等的触觉交互技术,应用于呼叫路由、家庭自动化及语音拨号等场合的语音识别技术,对于有语言障碍的人士的无声语音识别,应用于广告、网站、产品目录、杂志效用测试的眼动跟踪技术,针对有语言和行动障碍人开发的“意念轮椅”采用的基于脑电波的人机界面技术等。热点技术的应用开发是机遇也是挑战,基于视觉的手势识别率低,实时性差,需要研究各种算法来改善识别的精度和速度,眼睛虹膜、掌纹、笔迹、步态、语音、唇读、人脸、DNA等人类特征的研发应用也正受到关注,自然语言理解虽然目前在语言模型、语料库等方面有进展外,仍将是人机交互的重要目标,多通道的整合也是人机交互的热点,另外,与“无所不在的计算”、“云计算”等相关技术的融合与促进也需要继续探索。 人机交互技术与计算机始终相伴发展,CPU、GPU的运算能力日趋强大,网络和通信技术的快速发展,显示技术的重大突破都将为人机交互提供新的起点与高度。也许有一天,你的房间的墙壁和窗户都是基于PLED技术的巨型显示器,无需遥控器和控制器,游戏机或电视机就能“感应”到你目光的变化、捕捉到你的手势和动作、听懂你语音的命令,用你的头、手、足、躯干就可以控制游戏中

改进型智能机器人的语音识别方法 2、语音识别概述 最近,由于其重大的理论意义和实用价值,语音识别已经受到越来越多的关注。到现在为止,多数的语音识别是基于传统的线性系统理论,例如隐马尔可夫模型和动态时间规整技术。随着语音识别的深度研究,研究者发现,语音信号是一个复杂的非线性过程,如果语音识别研究想要获得突破,那么就必须引进非线性系统理论方法。最近,随着非线性系统理论的发展,如人工神经网络,混沌与分形,可能应用这些理论到语音识别中。因此,本文的研究是在神经网络和混沌与分形理论的基础上介绍了语音识别的过程。 语音识别可以划分为独立发声式和非独立发声式两种。非独立发声式是指发音模式是由单个人来进行训练,其对训练人命令的识别速度很快,但它对与其他人的指令识别速度很慢,或者不能识别。独立发声式是指其发音模式是由不同年龄,不同性别,不同地域的人来进行训练,它能识别一个群体的指令。一般地,由于用户不需要操作训练,独立发声式系统得到了更广泛的应用。所以,在独立发声式系统中,从语音信号中提取语音特征是语音识别系统的一个基本问题。 语音识别包括训练和识别,我们可以把它看做一种模式化的识别任务。通常地,语音信号可以看作为一段通过隐马尔可夫模型来表征的时间序列。通过这些特征提取,语音信号被转化为特征向量并把它作为一种意见,在训练程序中,这些意见将反馈到HMM的模型参数估计中。这些参数包括意见和他们响应状态所对应的概率密度函数,状态间的转移概率,等等。经过参数估计以后,这个已训练模式就可以应用到识别任务当中。输入信号将会被确认为造成词,其精确度是可以评估的。整个过程如图一所示。 图1 语音识别系统的模块图

《人机交互技术》课程试卷( 卷) 校区( )专业年级 1.本卷考试形式为闭卷,考试时间为两小时。 2.考生不得将装订成册的试卷拆散,不得将试卷或答题卡带出考场。 3.可以使用普通计算器。 一、(名词解释)题(共 10 小题,每题 2 分,共计 20 分 1, 产生式规则 2, GOMS 3, MVC 模型 4, E-O 模型 5, 人机交互 6, 多通道技术

7,可用性评估 8,WEB信息交互模型 9,移动互联 10,窗口系统 答题要求:(请简要回答出主要内容) 1.人机交互技术研究的主要内容是什么? 2.阐述数字化人机工程?

3.多通道用户界面的基本特点?4.描述语音识别系统的处理流程?

5.支持可用性的设计原则? 三、(综合题)题(共 5 小题,共计 40 分) 答题要求:(要求详细解答,写出步骤) 1,下列程序在交互式界面设计中起什么作用?(8分) ?while(1){ ?read_event(myevent); ?switch(myevent.type){ ?case type_1: ?do_type1_process(); ?break; ?case type_2: ?do_type2_process(); ?break; ?… ?case type_n: ?do_typen_process(); ?break; ?} ?} 2,请详细阐述行为模型到结构模型的转换思想和算法(8分)

3.阐述WEB页面一般包括哪些主要元素以及它们所发挥的作用。(8分)

4.试举几个网站的例子,并对其进行可用性评估?(8分)

一种基于语音识别的智能人机交互模式构想一种基尹吾Bi羯啲 智能人机交互模式构想 □文/杨婷、李靖、黄成琳 近年来,随着人工智能技术的快速发展,语音识别技术越来越成熟,语 音交互模式正逐渐发展成为一种简单、可依赖的智能人机交互模式。在 以智能语音为主要交互方式的智能时代中,人们的双手和双眼将得以解 放,人们的生活将更加便利和美好。 计算机行业变革的原动力及前智能时代面临的问题 科技改变生活、改变世界,计算机技术的兴起与发展历程真切有力地证实了这一点。 20世纪末期,微软、苹果用鼠标点开了PC时代的大门,让个人电脑走进千家万户,使得信息的传播摆脱了时空的束缚。21世纪初,苹果、谷歌在触屏上划开了移动时代的帷幕,让智能手机风靡全球,使得社交和娱乐无处不在。作为计算机领域最具典型性的两种不同形态的产品,个人电脑和智能手机均以独有的方式得到了千千万万的人们的普遍认可和接受,从而引发了时代的变革。 早期电脑依赖于键盘和字符屏幕的交互体验模式将多数人拒之于计算机的门外,而依赖于鼠标点击的图形用户界面交互模式的发明,无疑极大地降低了普通民众使用和理解个人电脑的门槛,使得PC时代的步伐悄 然而至,进而深刻地影响了人们的生活。传 统手机依赖于实体键盘或笔触交互的体验模 式,让手机的使用总显得不那么便捷,而依 赖于多点触控的交互体验模式让人们对手机 的操作更加得心应手、方便快捷,使得移动 时代的浪潮汹涌而至,从而改变人们日常生 活的方方面面。 事实表明,引发计算机时代变革的真正 动力,源于技术,却并非纯粹的技术。确切 的说,那是一种建立在计算机技术上的最友 好便捷的人机交互体验模式。这是一个用户 体验至上的年代,计算机的使命是为人们创 造出一个简单、可依赖,却又不乏趣味的多 彩世界,只有最大限度地降低人们的学习和 使用成本,才能创造出最具普适性的大众产 品。 紧随移动时代的步伐,我们即将迎来一 2019年第5期21