第三节 多元线性相关与回归分析

一、标准的多元线性回归模型

上一节介绍的一元线性回归分析所反映的是1个因变量与1个自变量之间的关系。但是,在现实中,某一现象的变动常受多种现象变动的影响。例如,消费除了受本期收入水平的影响外,还会受以往消费和收入水平的影响;一个工业企业利润额的大小除了与总产值多少有关外,还与成本、价格等有关。这就是说,影响因变量的自变量通常不是一个,而是多个。在许多场合,仅仅考虑单个变量是不够的,还需要就一个因变量与多个自变量的联系来进行考察,才能获得比较满意的结果。这就产生了测定与分析多因素之间相关关系的问题。 研究在线性相关条件下,两个和两个以上自变量对一个因变量的数量变化关系,称为多元线性回归分析,表现这一数量关系的数学公式,称为多元线性回归模型。多元线性回归模型是一元线性回归模型的扩展,其基本原理与一元线性回归模型相类似,只是在计算上比较麻烦一些而已。限于本书的篇幅和程度,本节对于多元回归分析中与一元回归分析相类似的内容,仅给出必要的结论,不作进一步的论证。只对某些多元回归分析所特有的问题作比较详细的说明。

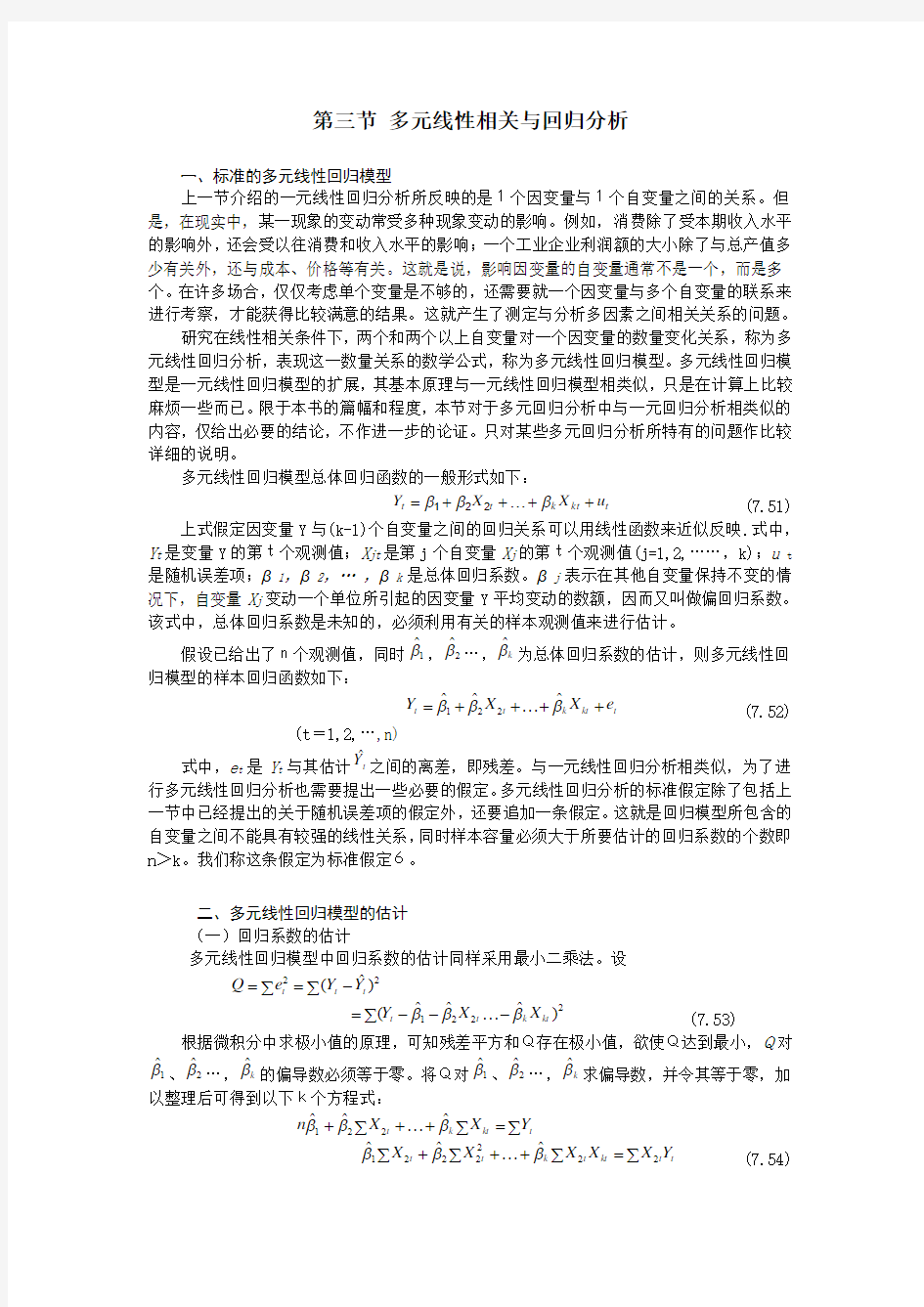

多元线性回归模型总体回归函数的一般形式如下:

t kt k t t u X X Y ++?++=βββ221 (7.51)

上式假定因变量Y 与(k-1)个自变量之间的回归关系可以用线性函数来近似反映.式中,Y t 是变量Y 的第t个观测值;X jt 是第j 个自变量X j 的第t个观测值(j=1,2,……,k);u t 是随机误差项;β1,β2,… ,βk 是总体回归系数。βj 表示在其他自变量保持不变的情况下,自变量X j 变动一个单位所引起的因变量Y 平均变动的数额,因而又叫做偏回归系数。该式中,总体回归系数是未知的,必须利用有关的样本观测值来进行估计。

假设已给出了n个观测值,同时1?β,2?β…,k β?为总体回归系数的估计,则多元线性回

归模型的样本回归函数如下:

t kt k t t e X X Y ++?++=βββ???221 (7.52)

(t =1,2,…,n)

式中,e t 是Y t 与其估计t Y ?之间的离差,即残差。与一元线性回归分析相类似,为了进

行多元线性回归分析也需要提出一些必要的假定。多元线性回归分析的标准假定除了包括上一节中已经提出的关于随机误差项的假定外,还要追加一条假定。这就是回归模型所包含的自变量之间不能具有较强的线性关系,同时样本容量必须大于所要估计的回归系数的个数即n >k 。我们称这条假定为标准假定6。

二、多元线性回归模型的估计

(一)回归系数的估计

多元线性回归模型中回归系数的估计同样采用最小二乘法。设

∑-=∑=22)?(t t t Y Y e Q

2221)???(kt k t t X X Y βββ-?--∑= (7.53)

根据微积分中求极小值的原理,可知残差平方和Q存在极小值,欲使Q达到最小,Q对1?β、2?β…,k β?的偏导数必须等于零。将Q对1?β、2?β…,k β?求偏导数,并令其等于零,加以整理后可得到以下k个方程式:

∑=∑+?+∑+t kt k t Y X X n βββ???221 ∑=∑+?+∑+∑t t kt t k t t Y X X X X X 2222221???βββ (7.54)

………

∑=∑+?+∑+∑t kt kt k kt t kt Y X X X X X 2221???βββ

以上k元一次方程组称为正规方程组或标准方程组,通过求解这一方程组便可以得到1?β、2?β…,k β?。

求解多元回归方程,用矩阵形式来表达较为简便1[1]。记

??????? ??=n y y y 21Y ??????? ??=kn 2n k 22k 21x x x x x x 11121X

??????? ??=n 21u u u U ??????? ??=k βββ 21Β ??????? ??=n y y y ????21 Y ??????? ??=k βββ????21 Β

??????? ??=n e e e 21e 则总体回归函数(7.51)式可以写为:

Y =XB +U (7.55)

样本回归函数(7.52)式可以写为:

Y =X Β

?+e (7.56) 标准方程组(7.54)式可以写为:

(X' X)Β

?=X' Y (7.57) 式中X'表示X 的转置矩阵。(X'X)是一个k×k的对称矩阵,根据标准假定6,k个自

变量之间不存在高度的线性相关,因此其逆矩阵存在。在(7.57)式的两边同时左乘(X'X)-1,

可以得到:

Β

?=(X'X)-1X'Y (7.58) 上式是回归系数最小二乘估计的一般形式。

实际求解多元回归方程中的回归系数的估计值,通常需要依靠电子计算机。在电子计算机技术十分发达的今天,多元回归分析的计算已经变得相当简单。利用现成的软件包如EXCEL 等,只要将有关数据输入电子计算机,并指定因变量和相应的自变量,立刻就能得到计算结果。因此,对于从事应用研究的人们来说,更为重要的是要能够理解输入和输出之间相互对应的关系,以及对电子计算机输出的结果做出正确的解释。

限于篇幅,这里不给出具体的数值计算实例。而在下一节中,我们将结合实际的例子,讲解如何利用EXCEL 进行多元线性回归分析。

(二)总体方差的估计

除了回归系数以外,多元线性回归模型中还包含了另一个未知参数,那就是随机误差项

的方差σ2。与一元回归分析相类似,多元线性回归模型中的σ2也是利用残差平方和除以其自由度来估计的。即有:

S2=k n e t

-∑2 (7.59)

上式中,n是样本观测值的个数;k是方程中回归系数的个数;在(k-1)元回归模型中,标准方程组有k个方程式,残差必须满足k个约束条件,因此其自由度为(n -k)。数学上可

以证明,S2是σ2的无偏估计。S2的正平方根S 又叫做回归估计的标准误差。S越小表明

样本回归方程的代表性越强。

1[1] 这里给出的矩阵形式具有一般性,对于一元线性回归模型也同样适用。对于尚未学过矩阵代数的读者,可以不必掌握这一部分内容。

在编制计算机程序时,残差平方和一般不是按照其定义式计算,而是利用以下公式计算:

∑=

2t e e'e =Y'Y - Β

'?X'Y (7.60) 上式是残差平方和的矩阵形式。式中的“′”表示求转置;Y 是因变量样本观测值向量;

X 是自变量样本观测值矩阵;Β'?是回归系数估计值向量的转置向量。 (三)最小二乘估计量的性质

与一元线性回归模型类似,多元线性回归模型中回归系数的最小二乘估计量也是随机变量。数学上可以证明,在标准假定条件可以得到满足的情况下,多元回归模型中回归系数最小二乘估计量的期望值同样等于总体回归系数的真值,即有:

E(B

?)=B (7.61) 回归系数最小二乘估计量的方差、协方差矩阵为:

Var(B ?)=E(B ?-B )(B

?-B )'

=σ2(X'X )-1 (7.62)

该矩阵主对角元素是各回归系数估计量的方差E(j β?-βj )2,其他元素是各回归系数估

计量之间的协方差E(j β?-βj ) (i β?-βi ) (i ≠j )。在此基础上,还可以进一步证明回归系

数的最小二乘估计量是最优线性无偏估计量和一致估计量。也就是说,在标准的多元线性回归模型中,高斯.马尔可夫定理同样成立。

三、多元线性回归模型的检验和预测

(一)拟合程度的评价

在多元线性回归分析中,总离差平方和的分解公式依然成立。因此也可以用上一节所定义的决定系数作为评价模型拟合程度的一项指标。不过,为了避免混淆,多元回归的决定系

数用R2表示。

利用R2来评价多元线性回归方程的拟合程度,必须注意以下问题。

R2=1- ∑-∑22)(Y Y e t t

(7.63)

由决定系数的定义可知,R2的大小取决于残差平方和∑2t e 在总离差平方和∑

-2

)Y Y t (中所占的比重。在样本容量一定的条件下,总离差平方和与自变量的个数无关,而残差平方

和则会随着模型中自变量个数的增加不断减少,至少不会增加。因此,R2是自变量个数的

非递减函数。 在一元线性回归模型中,所有模型包含的变量数目都相同,如果所使用的样本容量也一样,决定系数便可以直接作为评价拟合程度的尺度。然而在多元线性回归模型中,

各回归模型所含的变量的数目未必相同,以R2的大小作为衡量拟合优劣的尺度是不合适的。因此,在多元回归分析中,人们更常用的评价指标是所谓的修正自由度的决定系数2

R 。 该指标的定义如下:

2R =1-∑---∑)1/()()

/(22n Y Y k n e t t (7.64) =1-)()

(k n n --1(1-R2)2[2] (7.65) 式中,n是样本容量;k是模型中回归系数的个数。(n-1)和(n-k)实际上分别是总离差平方和与残差平方和的自由度。

修正自由度的决定系数2R 具有以下特点:

2[2]对于不包含常数项的回归方程,该公式不适用。

1. 2R ≤R2。因为k≥1,所以根据2

R 和R2各自的定义式可以得出这一结论。对于给定的R2值和n值,k值越大2

R 越小。在进行回归分析时,一般总是希望以尽可能少的自变量去达到尽可能高的拟合程度。

2

R 作为综合评价这两方面情况的一项指标显然比R2更为合适。 2. 2R 小于1,但未必都大于0。在拟合极差的场合,2R 有可能取负值。

【例7-9】假设有7年的年度统计资料,现利用其对同一因变量拟合了两个样本回归方

程。方程一中:k=6,R2=0.82;方程二中:k=2,R2=0.80。试对这两个回归方程的拟

合程度做出评价。

解: 如果仅从R2考察,似乎方程一的拟合程度更佳。但是,由于两个方程选用的自

变量个数不同,这一结论是不正确的。将上列数据代入(7.65)式,可得:

方程一的2R =1-((7-1)/(7-6))(1-0.82)=-0.08

方程二的2

R =1-((7-1)/(7-2))(1-0.80)=0.76

由此可见,方程二的实际拟合程度远远优于方程一。

(二)显著性检验

多元线性回归模型的显著性检验同样包括两方面的内容,即回归系数的显著性检验与回归方程的显著性检验。现分述如下:

1.回归系数的显著性检验

多元回归中进行这一检验的目的主要是为了检验与各回归系数对应的自变量对因变量的影响是否显著,以便对自变量的取舍做出正确的判断。一般来说,当发现某个自变量的影响不显著时,应将其从模型中删除。这样才能够做到以尽可能少的自变量去达到尽可能高的拟合优度。

多元模型中回归系数的检验同样采用t检验,其原理和基本步骤与一元回归模型中的t检验基本相同,这里不再赘述。下面仅给出回归系数显著性检验t统计量的一般计算公式。

tj β?=

j S j ββ?? j=1,2,…,k (7.66) 式中,j β?是回归系数的估计值,Sj β?是j β?的标准差的估计值。Sj β?按下式计算:

Sj β?= jj

S ψ?2 (7.67) 式中,jj ψ是(X'X)-1

的第j个对角线元素,S2是随机误差项方差的估计值。(7.66)式的

t统计量背后的原假设是H0:βj =0,因此t的绝对值越大表明βj 为0的可能性越小,即表明相应的自变量对因变量的影响是显著的。

2.回归方程的显著性检验

多元线性回归模型包含了多个回归系数, 因此对于多元回归模型,除了要对单个回归系数进行显著性检验外,还要对整个回归模型进行显著性检验。由离差平方和的分解公式可知,回归模型的总离差平方和等于回归平方和与残差平方和的和。回归模型总体函数的线性关系是否显著,其实质就是判断回归平方和与残差平方和之比值的大小问题。由于回归平方和与残差平方和的数值会随观测值的样本容量和自变量个数的不同而变化,因此不宜直接比较,而必须在方差分析的基础上利用F检验进行。其具体的方法步骤可归纳如下:

(1)假设总体回归方程不显著,即有

H0:β2=β3=……=βk =0

(2)进行方差分析,列出回归方差分析表(见表7-3)

表7-3 回归模型方差分析表

表中, 回归平方和的取值受k个回归系数估计值的影响,同时又要服从∑=Y n Y t /?的

约束条件,因此其自由度是k-1。残差平方和取决于n个因变量的观测值,同时又要服从k个正规方程式的约束,因此其自由度是n-k 。 回归平方和与残差平方和各除以自身的自由度得到的是样本方差。

(3)根据方差分析的结果求F统计量,即

F=k)/(n-SS 1)

/(k-SS E R (7.68)

数学上可以证明,在随机误差项服从正态分布同时原假设成立的条件下,F服从于自由度为(k-1)和(n-k)的F分布。

(4)根据自由度和给定的显著性水平α,查F分布表中的理论临界值Fα。当F>Fα时,拒绝原假设,即认为总体回归函数中各自变量与因变量的线性回归关系显著。当F<Fα时,接受原假设,即认为总体回归函数中,自变量与因变量的线性关系不显著,因而所建立的回归模型没有意义。

(三)多元线性回归预测

在通过各种检验的基础上,多元线性回归模型可以用于预测。多元线性回归预测与一元线性回归预测的原理是一致的,其基本公式如下:

kf k f f X X Y βββ????221+?++= (7.69) 式中,X j f (j=2,3,……k)是给定的X j 在预测期的具体数值;

j β?是已估计出的样本回归系数;f Y ?是X j 给定时Y的预测值。

该方程的矩阵形式为: βX ??'f f Y = (7.70)

式中,

??????? ??=kf f f X X 21X

??????? ??=k βββ????21 β 多元线性回归预测标准误差的计算公式如下:

f f ef S S X X X X 1'')(1-+= (7.71)

式中,S 是回归方程估计的标准误差。

多元线性回归预测Yf 的(1-α)的置信区间可由下式给出:

Yf ±t α/2×ef

S (7.72)

式中,t α/2是显著水平为α的t 分布双侧临界值。

四、复相关系数和偏相关系数

在多变量的情况下,变量之间的相关关系是很复杂的,需要计算复相关系数与偏相关系

数。

(一)复相关系数

样本复相关系数(以下简称复相关系数)的定义式如下:

R=∑∑∑----22)?()()?)((Y Y Y Y Y Y Y Y t t t t (7.73)

上式与单相关系数的定义式十分类似,不同之处仅在于用根据X 2,X 3,……,X K 等计算的回归估计值t Y ?代替了单相关系数定义式中的X t 。在所涉及的变量只有两个时,因为t Y ?

是X t 的严密函数,所以(7.73)式完全等价于单相关系数的定义式。而在多元分析的场合,以上定义的复相关系数的平方实际上就是多元线性回归方程的决定系数。

实际计算复相关系数时,一般不直接根据其定义式,而是先计算出决定系数,然后再求决定系数的平方根。应当指出:在多个变量的情况下,Y 与其他多个变量之间既可能有正相关又可能有负相关,所以复相关系数也就只取正值。因此,复相关系数只是反映一个变量Y 与其他多个变量X 2,X 3,……,X K 之间线性相关程度的指标,而不能反映其相互之间线性相关的方向。

复相关系数的取值区间为:0≤R≤1。复相关系数为1表明Y 与X 2,X 3,……,X K 之间存在严密的线性关系,复相关系数为0则表明Y 与X 2,X 3,……,X K 之间不存在任何线性相关关系。一般情况下,复相关系数的取值在0和1之间,表明变量之间存在一定程度的线性相关关系。

(二)偏相关系数

在对其他变量的影响进行控制的条件下,衡量多个变量中某两个变量之间的线性相关程度和相关方向的指标称为偏相关系数。偏相关系数不同于上一节中所介绍的单相关系数。在计算单相关系数时,只需要掌握两个变量的观测数据,并不考虑其他变量对这两个变量可能产生的影响。而在计算偏相关系数时,需要掌握多个变量的数据,一方面考虑多个变量相互之间可能产生的影响,一方面又采用一定的方法控制其他变量,专门考察两个特定变量的净相关关系。在多变量相关的场合,由于变量之间存在错综复杂的关系,因此偏相关系数与单相关系数在数值上可能相差很大,有时甚至符号都可能相反。单相关系数受其他因素的影响,反映的往往是表面的非本质的联系,而偏相关系数则较能说明现象之间真实的联系。例如,一种商品的需求既受收入水平的影响又受其价格的影响。按照经济学理论,在一定的收入水平下,该商品的价格越高,商品的需求量就越小。也就是说,需求与价格之间应当是负相关。可是,在现实经济生活中,由于收入和价格常常都有不断提高的趋势,如果不考虑收入对需求的影响,仅仅利用需求和价格的时间序列数据去计算单相关系数,就有可能得出价格越高需求越大的错误结论。

在明确偏相关系数与单相关系数区别的基础上,我们再来讨论偏相关系数的定义公式。在上一节中,我们已经给出了样本单相关系数的定义公式 r=∑∑∑----2

2)()())((Y Y X X Y Y X X t t t t (7.74)

样本相关系数的定义还可以从另一个角度给出。在进行相关分析时,对于所涉及的两个变量X和Y是同等看待的。若设 t t X Y 21???ββ+= (7.75)

t t Y X

21???αα+= (7.76) 则样本单相关系数也可定义为两个样本回归系数的乘积的开方,即:

r= ±22??αβ (7.77)

上式中r的符号应与回归系数的符号一致。回归系数为正数时,r取正值;回归系数为负数时,r取负值。容易证明(7.74)式与(7.77)式是完全等价的。也就是说,单相关系数可以表现为两个回归系数的几何平均数。样本偏相关系数也可以按照类似的形式来定义,即偏相关系数等于两个相应的偏回归系数的几何平均数。

为简明起见,下面举3变量的偏相关分析为例。设有3个变量X 1、X 2和X 3。3个变量各自以另两个变量为自变量拟合的样本回归方程如下:

t t t X X X 32.1323.1223.11????βββ++= (7.78)

t t t X X X 31.2313.2113.22????βββ++= (7.79)

t t t X X X 21.3212.3112.33????βββ++= (7.80)

以上各式中的第1项均为截距系数,表示当模型中的自变量取零值时因变量的平均值。

例如,23.1?β表示X 2、 X 3为0时X 1的平均值。式中其他的回归系数称为偏回归系数,它们都有三个下标,在小圆点左边的下标为主下标,小圆点右边的下标为次下标。主下标表示所要考察的两个变量;次下标表示在考察上述两个变量的关系时,使其保持不变的变量。不难理解,偏回归系数表示:当其他自变量保持不变时,某一自变量变化一个单位而使因变量平均变化的数值。例如,3.12?β表示X 3保持不变时,X 2变化一单位而引起的X 1平均变化的数值;1.32?β表示X 1保持不变时,X 2变化一单位而引起的X 3平均变化的数值。

利用以上偏回归系数,3个变量之间的偏相关系数可定义如下: 3.213.123.12??ββ±=r (7.81)

2

.312.132.13??ββ±=r (7.82) 1.321.231.23??ββ±=r (7.83)

偏相关系数的取值范围与单相关系数一样也是在-1至+1之间,其符号与相应的偏回归系数相同。

以上偏相关系数的定义可以推广到k个变量的场合。在进行实际的客观现象的定量分析时,人们所关心的通常是某一个因变量Y 与多个自变量之间的偏相关程度。这时若令Y 为X 1,则Y 与各自变量的偏相关系数的一般形式可表现为:

=+-k j j j r ,),(),(,,,. 11321±k j j j k j j j ,),1(),1(,,3,2.1,),1(),1(,,3,2.1?? +-+-ββ

(j=2,3,),k (7.84)

式中,k j j j ,),1(),1(,3,2.1? +-β是Y 对X j 的偏回归系数;

k j j j ,),1(),1(,3,2.1? +-β是X j 对Y 的偏回归系数。

k j j j r

,),1),(1,(,3,2.1 +-表示k个变量情况下Y 与X j 的偏相关系数,它反映其他自变量保持不变时Y 与X j 的净相关程度。

案例分析报告(2014——2015学年第一学期) 课程名称:预测与决策 专业班级:电子商务1202 学号:2204120202 学生姓名:陈维维 2014 年11月

案例分析(一元线性回归模型) 我国城镇居民家庭人均消费支出预测 一、研究目的与要求 居民消费在社会经济的持续发展中有着重要的作用,居民合理的消费模式和居民适度的消费规模有利于经济持续健康的增长,而且这也是人民生活水平的具体体现。从理论角度讲,消费需求的具体内容主要体现在消费结构上,要增加居民消费,就要从研究居民消费结构入手,只有了解居民消费结构变化的趋势和规律,掌握消费需求的热点和发展方向,才能为消费者提供良好的政策环境,引导消费者合理扩大消费,才能促进产业结构调整与消费结构优化升级相协调,才能推动国民经济平稳、健康发展。例如,2008年全国城镇居民家庭平均每人每年消费支出为11242.85元,最低的青海省仅为人均8192.56元,最高的上海市达人均19397.89元,上海是黑龙江的2.37倍。为了研究全国居民消费水平及其变动的原因,需要作具体的分析。影响各地区居民消费支出有明显差异的因素可能很多,例如,零售物价指数、利率、居民财产、购物环境等等都可能对居民消费有影响。为了分析什么是影响各地区居民消费支出有明显差异的最主要因素,并分析影响因素与消费水平的数量关系,可以建立相应的计量经济模型去研究。 二、模型设定 我研究的对象是各地区居民消费的差异。居民消费可分为城镇居民消费和农村居民消费,由于各地区的城镇与农村人口比例及经济结构有较大差异,最具有直接对比可比性的是城市居民消费。而且,由于各地区人口和经济总量不同,只能用“城镇居民每人每年的平均消费支出”来比较,而这正是可从统计年鉴中获得数据的变量。 所以模型的被解释变量Y选定为“城镇居民每人每年的平均消费支出”。 因为研究的目的是各地区城镇居民消费的差异,并不是城镇居民消费在不同时间的变动,所以应选择同一时期各地区城镇居民的消费支出来建立模型。因此建立的是2008年截面数据模型。影响各地区城镇居民人均消费支

第九章 线性回归和相关分析 9.1 什么叫做回归分析?直线回归方程和回归截距、回归系数的统计意义是什么,如何计算?如何对直线回归进行假设测验和区间估计? 9.2 a s 、b s 、x y s /、y s 、y s ?各具什么意义?如何计算(思考各计算式的异同)? 9.3 什么叫做相关分析?相关系数、决定系数各有什么具体意义?如何计算?如何对相关系数作假设测验? 9.4 什么叫做协方差分析?为什么要进行协方差分析?如何进行协方差分析(分几个步骤)?为什么有时要将i y 矫正到x 相同时的值?如何矫正? 9.5 测得不同浓度的葡萄糖溶液(x ,mg /l )在某光电比色计上的消光度(y )如下表,试计算: (1)直线回归方程y ?=a +bx ,并作图;(2)对该回归方程作假设测验;(3)测得某样品的消光度为0.60,试估算该样品的葡萄糖浓度。 x 0 5 10 15 20 25 30 y 0.00 0.11 0.23 0.34 0.46 0.57 0.71 [答案:(1)y ? =-0.005727+0.023429x ,(2)H0被否定,(3)25.85mg/l] 9.6 测得广东阳江≤25oC 的始日(x)与粘虫幼虫暴食高峰期(y)的关系如下表(x 和y 皆以8月31日为0)。试分析:(1)≤25oC 的始日可否用于预测粘虫幼虫的暴食期;(2)回归方程及其估计标准误;(3)若某年9月5日是≤25oC 的始日,则有95%可靠度的粘虫暴食期在何期间? 年份 54 55 56 57 58 59 60 x 13 25 27 23 26 1 15 y 50 55 50 47 51 29 48 [答案:(1)r=0.8424;(2)y ? =33.2960+0.7456x , x y s /=4.96;(3)9月22日~10月23日] 9.7 研究水稻每一单茎蘖的饱粒重(y ,g)和单茎蘖重(包括谷粒)(x ,g)的关系,测定52个早熟桂花黄单茎蘖,得:SSx=234.4183,SSy=65.8386,SP=123.1724,b=0.5254,r=0.99;测定49个金林引单茎蘖,得SSx=65.7950,SSy=18.6334,SP=33.5905,b=0.5105,r=0.96。试对两回归系数和相关系数的差异作假设测验,并解释所得结果的意义。 [答案: 2 1b b s -=0.0229,t <1; 2 1z z s -=0.2053,t=3.413] 9.8 下表为1963、1964、1965三年越冬代棉红铃虫在江苏东台的化蛹进度的部分资料,试作协方差分析。 x 日 期 (以6月10日为0) y 化 蛹 进 度(%) 1963年 1964年 1965年

国际旅游外汇收入是国民经济发展的重要组成部分,影响一个国家或地区旅游收入的因素包括自然、文化、社会、经济、交通等多方面的因素,本例研究第三产业对旅游外汇收入的影响。《中国统计年鉴》把第三产业划分为12个组成部分,分别为x1农林牧渔服务业,x2地质勘查水利管理业,x3交通运输仓储和邮电通信业,x4批发零售贸易和餐饮业,x5金融保险业,x6房地产业,x7社会服务业,x8卫生体育和社会福利业,x9教育文化艺术和广播,x10科学研究和综合艺术,x11党政机关,x12其他行业。采用1998年我国31 个省、市、自治区的数据,以国际旅游外汇收入(百万美元)为因变量y,以如上12 个行业为自变量做多元线性回归,其中自变量单位为亿元人民币。即样本量n=31,变量p=12。 利用SPSS软件对数据进行处理,输出: 图1 输入/移除变量 图1即输入了所有模型中的变量,分别为 x1:农林牧渔服务业 x2:地质勘查水利管理业 x3:交通运输仓储和邮电通信业 x4:批发零售贸易和餐饮业 x5:金融保险业 x6:房地产业 x7:社会服务业 x8:卫生体育和社会福利业 x9:教育文化艺术和广播 x10:科学研究和综合艺术 x11:党政机关 x12:其他行业

图2 模型概述 即回归方程对样本观测值的拟合程度,复相关系数R=0.875,决定系数R 2=0.935。由决定系数接近1,得出回归拟合的效果较好,但是并不能作为严格的显著性检验。由R 2决定模型优劣时需慎重,尤其是样本量与自变量个数接近时。 图3 回归方程显著性的F 检验 F=10.482,F α(n,n-p-1)=F α(30,18)=2.11(α=0.05),P 值=0.000,表明回归方程高度显著,即12个自变量整体对因变量y 产生显著线性影响。但是并不能说明回归方程中所有自变量都对因变量y 有显著影响,因此还要对回归系数进行检验。 图4 回归系数的显著性t 检验(t 0.05(20)=1.725) y 对12个自变量的线性回归方程为: 1234 5678 9101112y 205.388 1.438 2.622 3.2970.9465.521 4.068 4.16215.40417.3389.15510.536 1.37x x x x x x x x x x x x =--++--++-++-+

多元线性回归分析预测法 (重定向自多元线性回归预测法) 多元线性回归分析预测法(Multi factor line regression method,多元线性回归分析法) [编辑] 多元线性回归分析预测法概述 在市场的经济活动中,经常会遇到某一市场现象的发展和变化取决于几个影响因素的情况,也就是一个因变量和几个自变量有依存关系的情况。而且有时几个影响因素主次难以区分,或者有的因素虽属次要,但也不能略去其作用。例如,某一商品的销售量既与人口的增长变化有关,也与商品价格变化有关。这时采用一元回归分析预测法进行预测是难以奏效的,需要采用多元回归分析预测法。 多元回归分析预测法,是指通过对两上或两个以上的自变量与一个因变量的相关分析,建立预测模型进行预测的方法。当自变量与因变量之间存在线性关系时,称为多元线性回归分析。 [编辑] 多元线性回归的计算模型[1] 一元线性回归是一个主要影响因素作为自变量来解释因变量的变化,在现实问题研究中,因变量的变化往往受几个重要因素的影响,此时就需要用两个或两个以上的影响因素作为自变量来解释

因变量的变化,这就是多元回归亦称多重回归。当多个自变量与因变量之间是线性关系时,所进行的回归分析就是多元性回归。 设y为因变量,为自变量,并且自变量与因变量之间为线性关系时,则多元线性回归模型为: 其中,b0为常数项,为回归系数,b1为固定时,x1每增加一 个单位对y的效应,即x1对y的偏回归系数;同理b2为固定时,x2每增加一个单位对y的效应,即,x2对y的偏回归系数,等等。如果两个自变量x1,x2同一个因变量y呈线相关时,可用二元线性回归模型描述为: 其中,b0为常数项,为回归系数,b1为固定时,x2每增加一 个单位对y的效应,即x2对y的偏回归系数,等等。如果两个自变量x1,x2同一个因变量y呈线相关时,可用二元线性回归模型描述为: y = b0 + b1x1 + b2x2 + e 建立多元性回归模型时,为了保证回归模型具有优良的解释能力和预测效果,应首先注意自变量的选择,其准则是: (1)自变量对因变量必须有显著的影响,并呈密切的线性相关; (2)自变量与因变量之间的线性相关必须是真实的,而不是形式上的; (3)自变量之彰应具有一定的互斥性,即自变量之彰的相关程度不应高于自变量与因变量之因的相关程度; (4)自变量应具有完整的统计数据,其预测值容易确定。 多元性回归模型的参数估计,同一元线性回归方程一样,也是在要求误差平方和()为最小的前提下,用最小二乘法求解参数。以二线性回归模型为例,求解回归参数的标准方程组为 解此方程可求得b0,b1,b2的数值。亦可用下列矩阵法求得

线性回归模型的研究毕业论文 1 引言 回归分析最早是由19世纪末期高尔顿(Sir Francis Galton)发展的。1855年,他发表了一篇文章名为“遗传的身高向平均数方向的回归”,分析父母与其孩子之间身高的关系,发现父母的身高越高或的其孩子也越高,反之则越矮。他把儿子跟父母身高这种现象拟合成一种线性关系。但是他还发现了个有趣的现象,高个子的人生出来的儿子往往比他父亲矮一点更趋向于平均身高,矮个子的人生出来的儿子通常比他父亲高一点也趋向于平均身高。高尔顿选用“回归”一词,把这一现象叫做“向平均数方向的回归”。于是“线形回归”的术语被沿用下来了。 回归分析中,当研究的因果关系只涉及因变量和一个自变量时,叫做一元回归分析;当研究的因果关系涉及因变量和两个或两个以上自变量时,叫做多元回归分析。此外,回归分析中,又依据描述自变量与因变量之间因果关系的函数表达式是线性的还是非线性的,分为线性回归分析和非线性回归分析。按照参数估计方法可以分为主成分回归、偏最小二乘回归、和岭回归。 一般采用线性回归分析,由自变量和规定因变量来确定变量之间的因果关系,从而建立线性回归模型。模型的各个参数可以根据实测数据解。接着评价回归模型能否够很好的拟合实际数据;如果不能够很好的拟合,则重新拟合;如果能很好的拟合,就可以根据自变量进行下一步推测。 回归分析是重要的统计推断方法。在实际应用中,医学、农业、生物、林业、金融、管理、经济、社会等诸多方面随着科学的发展都需要运用到这个方法。从而推动了回归分析的快速发展。 2 回归分析的概述 2.1 回归分析的定义 回归分析是应用极其广泛的数据分析方法之一。回归分析(regression analysis)是确定两种或两种以上变数间相互依赖的定量关系的一种统计分析方法。 2.2 回归分析的主要容

一般线性回归分析案例 1、案例 为了研究钙、铁、铜等人体必需元素对婴幼儿身体健康地影响,随机抽取了30个观测数据,基于多员线性回归分析地理论方法,对儿童体内几种必需元素与血红蛋白浓度地关系进行分析研究.这里,被解释变量为血红蛋白浓度(y),解释变量为钙(ca)、铁(fe)、铜(cu). 表一血红蛋白与钙、铁、铜必需元素含量 (血红蛋白单位为g;钙、铁、铜元素单位为ug) case 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30y(g) 7.00 7.25 7.75 8.00 8.25 8.25 8.50 8.75 8.75 9.25 9.50 9.75 10.00 10.25 10.50 10.75 11.00 11.25 11.50 11.75 12.00 12.25 12.50 12.75 13.00 13.25 13.50 13.75 14.00 14.25 ca 76.90 73.99 66.50 55.99 65.49 50.40 53.76 60.99 50.00 52.34 52.30 49.15 63.43 70.16 55.33 72.46 69.76 60.34 61.45 55.10 61.42 87.35 55.08 45.02 73.52 63.43 55.21 54.16 65.00 65.00 fe 295.30 313.00 350.40 284.00 313.00 293.00 293.10 260.00 331.21 388.60 326.40 343.00 384.48 410.00 446.00 440.01 420.06 383.31 449.01 406.02 395.68 454.26 450.06 410.63 470.12 446.58 451.02 453.00 471.12 458.00 cu 0.840 1.154 0.700 1.400 1.034 1.044 1.322 1.197 0.900 1.023 0.823 0.926 0.869 1.190 1.192 1.210 1.361 0.915 1.380 1.300 1.142 1.771 1.012 0.899 1.652 1.230 1.018 1.220 1.218 1.000

多元回归分析法的介绍及具体应用

————————————————————————————————作者: ————————————————————————————————日期: ?

多元回归分析法的介绍及具体应用 在数量分析中,经常会看到变量与变量之间存在着一定的联系。要了解变量之间如何发生相互影响的,就需要利用相关分析和回归分析。回归分析的主要类型:一元线性回归分析、多元线性回归分析、非线性回归分析、曲线估计、时间序列的曲线估计、含虚拟自变量的回归分析以及逻辑回归分析等。这里主要讲的是多元线性回归分析法。 1. 多元线性回归的定义 说到多元线性回归分析前,首先介绍下医院回归线性分析,一元线性回归分析是在排除其他影响因素或假定其他影响因素确定的条件下,分析某一个因素(自变量)是如何影响另一事物(因变量)的过程,所进行的分析是比较理想化的。其实,在现实社会生活中,任何一个事物(因变量)总是受到其他多种事物(多个自变量)的影响。 一元线性回归分析讨论的回归问题只涉及了一个自变量,但在实际问题中,影响因变量的因素往往有多个。例如,商品的需求除了受自身价格的影响外,还要受到消费者收入、其他商品的价格、消费者偏好等因素的影响;影响水果产量的外界因素有平均气温、平均日照时数、平均湿度等。 因此,在许多场合,仅仅考虑单个变量是不够的,还需要就一个因变量与多个自变量的联系来进行考察,才能获得比较满意的结果。这就产生了测定多因素之间相关关系的问题。 研究在线性相关条件下,两个或两个以上自变量对一个因变量的数量变化关系,称为多元线性回归分析,表现这一数量关系的数学公式,称为多元线性回归模型。 多元线性回归模型是一元线性回归模型的扩展,其基本原理与一元线性回归模型类似,只是在计算上更为复杂,一般需借助计算机来完成。 2. 多元回归线性分析的运用 具体地说,多元线性回归分析主要解决以下几方面的问题。 (1)、确定几个特定的变量之间是否存在相关关系,如果存在的话,找出它们

spss多元线性回归分析

作者: 日期:

SPSS多元线性回归分析试验 在科学研究中,我们会发现某些指标通常受到多个因素的影响,如血压值除了受年龄影响之外,还受到性别、体重、饮食习惯、吸烟情况等因素的影响,用方程定量描述一个因变量y与多个自变量x1、x2、x3 之间的线性依存关系,称为多元线性回归。 有学者认为血清中低密度脂蛋白增高是引起动脉硬化的一个重要原因。现测量30名怀疑患有动脉硬化的就诊患者的载脂蛋白A、载脂蛋白B、载脂蛋白E、载脂蛋白C、低密度脂蛋白中的胆固醇含量。资料如下表所示。求低密度脂蛋白中的胆固醇含量对载脂蛋白A、载脂蛋白E、载脂蛋白E、载脂蛋白C的线性回归方程。 表1 30名就诊患者资料表

spss数据处理步骤: (1)打开spss输入数据后,点击“分析”—“回归”—“线性”。然后将“低密度脂蛋白”选入因变量框,将“载脂蛋白A” “载脂蛋白E” “载脂蛋白E” “载脂蛋白C”依次选入自变量框。方法选为“逐步”。 (2)单击“统计量”选项,原有选项基础上选择“R方变化”。在残差中选“Durbin-Watson”,单击“继续”。

i [粘贴(E)] i ss (印11取消i L 帮助 (3)单击“绘制”,将“DEPENDNT ”选入“X2”中,将“*SRESID ”选入“Y 中,在标准残差图选项中选择“直方图”和“正态概率图”。单击“继续”。 S3 闵蠢墨fD): 制IK DEPEHDNT T ZPRED *ZF?ESID PRESID ?ADdPRED 怡尺匚SID 怡口穆 ESILJ 呵直方便(比 “正态槪率副曰 继续 将(3),, 取卷 帮肋 銭性回归 册回归:圏 踰点1的1 厂产空所有制分團(巳 (4)单击“选项”,在原有选项的基础上单击“继续”,最后单击“确定”,就完 成了。

回归分析 实验内容:基于居民消费性支出与居民可支配收入的简单线性回归分析 【研究目的】 居民消费在社会经济的持续发展中有着重要的作用。影响各地区居民消费支出的因素很多,例如居民的收入水平、商品价格水平、收入分配状况、消费者偏好、家庭财产状况、消费信贷状况、消费者年龄构成、社会保障制度、风俗习惯等等。为了分析什么是影响各地区居民消费支出有明显差异的最主要因素,并分析影响因素与消费水平的数量关系,可以建立相应的经济模型去研究。 【模型设定】 我们研究的对象是各地区居民消费的差异。由于各地区的城市与农村人口比例及经济结构有较大差异,现选用城镇居民消费进行比较。模型中被解释变量Y选定为“城市居民每人每年的平均消费支出”。从理论和经验分析,影响居民消费水平的最主要因素是居民的可支配收入,故可以选用“城市居民每人每年可支配收入”作为解释变量X,选取2010年截面数据。 1、实验数据 表1: 2010年中国各地区城市居民人均年消费支出和可支配收入

2、实验过程 作城市居民家庭平均每人每年消费支出(Y)和城市居民人均年可支配收入(X)的散点图,如图1:

表2 模型汇总b 表3 相关性 从散点图可以看出居民家庭平均每人每年消费支出(Y)和城市居民人均年可支配收入(X)大体呈现为线性关系,所以建立如下线性模型:Y=a+bX

表4 系数a 3、结果分析 表2模型汇总:相关系数为0.965,判定系数为0.932,调整判定系数为0.930,估计值的标准误877.29128 表3是相关分析结果。消费性支出Y与可支配收入X相关系数为0.965,相关性很高。 表4是回归分析中的系数:常数项b=704.824,可支配收入X的回归系数a=0.668。a的标准误差为0.034,回归系数t的检验值为19.921,P值为0,满足95%的置信区间,可认为回归系数有显著意义。得线性回归方程Y=0.668X+704.824. 【实验结论】 (1)结果显示,变量之间具有如下关系式:Y=0.668X+704.824.也就是说消费与收入之间存在稳定的函数关系。随着收入的增加,消费将增加,但消费的增长低于收入的增长。这与凯尔斯的绝对收入消费理论刚好吻合。但为了研究方便,这里假设边际消费倾向为常数。由公式知X每增长1个单位,Y增加0.668个单位。

SPSS--回归-多元线性回归模型案例解析!(一) 多元线性回归,主要是研究一个因变量与多个自变量之间的相关关系,跟一元回归原理差不多,区别在于影响因素(自变量)更多些而已,例如:一元线性回归方程为: 毫无疑问,多元线性回归方程应该为: 上图中的x1, x2, xp分别代表“自变量”Xp截止,代表有P个自变量,如果有“N组样本,那么这个多元线性回归,将会组成一个矩阵,如下图所示: 那么,多元线性回归方程矩阵形式为: 其中:代表随机误差,其中随机误差分为:可解释的误差和不可解释的误差,随机误差必须满足以下四个条件,多元线性方程才有意义(一元线性方程也一样) 1:服成正太分布,即指:随机误差必须是服成正太分别的随机变量。 2:无偏性假设,即指:期望值为0 3:同共方差性假设,即指,所有的随机误差变量方差都相等 4:独立性假设,即指:所有的随机误差变量都相互独立,可以用协方差解释。 今天跟大家一起讨论一下,SPSS---多元线性回归的具体操作过程,下面以教程教程数据为例,分析汽车特征与汽车销售量之间的关系。通过分析汽车特征跟汽车销售量的关系,建立拟合多元线性回归模型。数据如下图所示:

点击“分析”——回归——线性——进入如下图所示的界面:

将“销售量”作为“因变量”拖入因变量框内,将“车长,车宽,耗油率,车净重等10个自变量拖入自变量框内,如上图所示,在“方法”旁边,选择“逐步”,当然,你也可以选择其它的方式,如果你选择“进入”默认的方式,在分析结果中,将会得到如下图所示的结果:(所有的自变量,都会强行进入) 如果你选择“逐步”这个方法,将会得到如下图所示的结果:(将会根据预先设定的“F统计量的概率值进行筛选,最先进入回归方程的“自变量”应该是跟“因变量”关系最为密切,贡献最大的,如下图可以看出,车的价格和车轴跟因变量关系最为密切,符合判断条件的概率值必须小于0.05,当概率值大于等于0.1时将会被剔除)

第二章 回归分析概要 第五节 多元线性回归分析 一 模型的建立与假定条件 在一元线性回归模型中,我们只讨论了包含一个解释变量的一元线性回归模型,也就是假定被解释变量只受一个因素的影响。但是在现实生活中,一个被解释变量往往受到多个因素的影响。例如,商品的消费需求,不但受商品本身的价格影响,还受到消费者的偏好、收入水平、替代品价格、互补品价格、对商品价格的预测以及消费者的数量等诸多因素的影响。在分析这些问题的时候,仅利用一元线性回归模型已经不能够反映各变量间的真实关系,因此,需要借助多元线性回归模型来进行量化分析。 1. 多元线性回归模型的基本概念 如果一个被解释变量(因变量)t y 有k 个解释变量(自变量)tj x ,k j ,...,3,2,1=, 同时,t y 不仅是tk x 的线性函数,而且是参数0β和k i i ,...3,2,1=,β(通常未知)的线性函数,随即误差项为t u ,那么多元线性回归模型可以表示为: ,...22110t tk k t t t u x x x y +++++=ββββ ),..,2,1(n t = 这里tk k t t t x x x y E ββββ++++=...)(22110为总体多元线性回归方程,简称总体回归方程。 其中,k 表示解释变量个数,0β称为截距项,k βββ...21是总体回归系数。k i i ,...3,2,1=,β表示在其他自变量保持不变的情况下,自变量tj X 变动一个单位所引起的因变量Y 平均变动的数量,因而也称之为偏回归系数。 当给定一个样本n t x x x y tk t t t ,...2,1),,...,,(21=时,上述模型可以表示为: ???? ??? ???????????+++++=+++++=+++++=+++++=t tk k t t t k k k k k k u x x x y u x x x y u x x x y u x x x y ββββββββββββββββ (22110333223110322222211021112211101) 此时,t y 与tj x 已知,i β与t u 未知。 其相应的矩阵表达式为:

多元线性回归分析预测法 多元线性回归分析预测法(Multi factor line regression method,多元线性回归分析法) [编辑] 多元线性回归分析预测法概述 在市场的经济活动中,经常会遇到某一市场现象的发展和变化取决于几个影响因素的情况,也就是一个因变量和几个自变量有依存关系的情况。而且有时几个影响因素主次难以区分,或者有的因素虽属次要,但也不能略去其作用。例如,某一商品的销售量既与人口的增长变化有关,也与商品价格变化有关。这时采用一元回归分析预测法进行预测是难以奏效的,需要采用多元回归分析预测法。 多元回归分析预测法,是指通过对两上或两个以上的自变量与一个因变量的相关分析,建立预测模型进行预测的方法。当自变量与因变量之间存在线性关系时,称为多元线性回归分析。 [编辑] 多元线性回归的计算模型[1] 一元线性回归是一个主要影响因素作为自变量来解释因变量的变化,在现实问题研究中,因变量的变化往往受几个重要因素的影响,此时就需要用两个或两个以上的影响因素作为自变量来解释因变量的变化,这就是多元回归亦称多重回归。当多个自变量与因变量之间是线性关系时,所进行的回归分析就是多元性回归。

设y为因变量,为自变量,并且自变量与因变量之间为线性关系时,则多元线性回归模型为: 其中,b 0为常数项,为回归系数,b1为固定时,x1每增加一 个单位对y的效应,即x 1对y的偏回归系数;同理b2为固定时,x2每增加一 个单位对y的效应,即,x 2对y的偏回归系数,等等。如果两个自变量x1,x2同一个因变量y呈线相关时,可用二元线性回归模型描述为: 其中,b 0为常数项,为回归系数,b1为固定时,x2每增加 一个单位对y的效应,即x 2对y的偏回归系数,等等。如果两个自变量x1,x2同一个因变量y呈线相关时,可用二元线性回归模型描述为: y = b 0 + b1x1 + b2x2 + e 建立多元性回归模型时,为了保证回归模型具有优良的解释能力和预测效果,应首先注意自 变量的选择,其准则是: (1)自变量对因变量必须有显著的影响,并呈密切的线性相关; (2)自变量与因变量之间的线性相关必须是真实的,而不是形式上的; (3)自变量之彰应具有一定的互斥性,即自变量之彰的相关程度不应高于自变量与因变量之 因的相关程度; (4)自变量应具有完整的统计数据,其预测值容易确定。 多元性回归模型的参数估计,同一元线性回归方程一样,也是在要求误差平方和()为最小的前提下,用最小二乘法求解参数。以二线性回归模型为例,求解回归参数的标准方程组为 解此方程可求得b 0,b1,b2的数值。亦可用下列矩阵法求得

线性回归分析的SPSS操作 本节内容主要介绍如何确定并建立线性回归方程。包括只有一个自变量的一元线性回归和和含有多个自变量的多元线性回归。为了确保所建立的回归方程符合线性标准,在进行回归分析之前,我们往往需要对因变量与自变量进行线性检验。也就是类似于相关分析一章中讲过的借助于散点图对变量间的关系进行粗略的线性检验,这里不再重复。另外,通过散点图还可以发现数据中的奇异值,对散点图中表示的可能的奇异值需要认真检查这一数据的合理性。 一、一元线性回归分析 1.数据 以本章第三节例3的数据为例,简单介绍利用SPSS如何进行一元线性回归分析。数据编辑窗口显示数据输入格式如下图7-8(文件7-6-1.sav): 图7-8:回归分析数据输入 2.用SPSS进行回归分析,实例操作如下: 2.1.回归方程的建立与检验 (1)操作 ①单击主菜单Analyze / Regression / Linear…,进入设置对话框如图7-9所示。从左边变量表列中把因变量y选入到因变量(Dependent)框中,把自变量x选入到自变量(Independent)框中。在方法即Method一项上请注意保持系统默认的选项Enter,选择该项表示要求系统在建立回归方程时把所选中的全部自变量都保留在方程中。所以该方法可命名为强制进入法(在多元回归分析中再具体介绍这一选项的应用)。具体如下图所示:

图7-9 线性回归分析主对话框 ②请单击Statistics…按钮,可以选择需要输出的一些统计量。如Regression Coefficients(回归系数)中的Estimates,可以输出回归系数及相关统计量,包括回归系数B、标准误、标准化回归系数BETA、T值及显著性水平等。Model fit项可输出相关系数R,测定系数R2,调整系数、估计标准误及方差分析表。上述两项为默认选项,请注意保持选中。设置如图7-10所示。设置完成后点击Continue返回主对话框。 图7-10:线性回归分析的Statistics选项图7-11:线性回归分析的Options选项 回归方程建立后,除了需要对方程的显著性进行检验外,还需要检验所建立的方程是否违反回归分析的假定,为此需进行多项残差分析。由于此部分内容较复杂而且理论性较强,所以不在此详细介绍,读者如有兴趣,可参阅有关资料。 ③用户在进行回归分析时,还可以选择是否输出方程常数。单击Options…按钮,打开它的对话框,可以看到中间有一项Include constant in equation可选项。选中该项可输出对常数的检验。在Options对话框中,还可以定义处理缺失值的方法和设置多元逐步回归中变量进入和排除方程的准则,这里我们采用系统的默认设置,如图7-11所示。设置完成后点击Continue返回主对话框。 ④在主对话框点击OK得到程序运行结果。

回归分析与相关分析联系、区别?? 简单线性回归分析是对两个具有线性关系的变量,研究其相关性,配合线性回归方程,并根据自变量的变动来推算和预测因变量平均发展趋势的方法。 回归分析(Regression analysis)通过一个变量或一些变量的变化解释另一变量的变化。 主要内容和步骤:首先依据经济学理论并且通过对问题的分析判断,将变量分为自变量和因变量,一般情况下,自变量表示原因,因变量表示结果;其次,设法找出合适的数学方程式(即回归模型)描述变量间的关系;接着要估计模型的参数,得出样本回归方程;由于涉及到的变量具有不确定性,接着还要对回归模型进行统计检验,计量经济学检验、预测检验;当所有检验通过后,就可以应用回归模型了。 回归的种类 回归按照自变量的个数划分为一元回归和多元回归。只有一个自变量的回归叫一元回归,有两个或两个以上自变量的回归叫多元回归。 按照回归曲线的形态划分,有线性(直线)回归和非线性(曲线)回归。 相关分析与回归分析的关系 (一)相关分析与回归分析的联系 相关分析是回归分析的基础和前提,回归分析则是相关分析的深入和继续。相关分析需要依靠回归分析来表现变量之间数量相关的具体形式,而回归分析则需要依靠相关分析来表现变量之间数量变化的相关程度。只有当变量之间存在高度相关时,进行回归分析寻求其相关的具体形式才有意义。如果在没有对变量之间是否相关以及相关方向和程度做出正确判断之前,就进行回归分析,很容易造成“虚假回归”。与此同时,相关分析只研究变量之间相关的方向和程度,不能推断变量之间相互关系的具体形式,也无法从一个变量的变化来推测另一个变量的变化情况,因此,在具体应用过程中,只有把相关分析和回归分析结合起来,才能达到研究和分析的目的。 (二)相关分析与回归分析的区别 1.相关分析中涉及的变量不存在自变量和因变量的划分问题,变量之间的关系是对等的;而在回归分析中,则必须根据研究对象的性质和研究分析的目的,对变量进行自变量和因变量的划分。因此,在回归分析中,变量之间的关系是不对等的。 2.在相关分析中所有的变量都必须是随机变量;而在回归分析中,自变量是确定的,因变量才是随机的,即将自变量的给定值代入回归方程后,所得到的因变量的估计值不是唯一确定的,而会表现出一定的随机波动性。 3.相关分析主要是通过一个指标即相关系数来反映变量之间相关程度的大小,由于变量之间是对等的,因此相关系数是唯一确定的。而在回归分析中,对于互为因果的两个变量(如人的身高与体重,商品的价格与需求量),则有可能存在多个回归方程。 需要指出的是,变量之间是否存在“真实相关”,是由变量之间的内在联系所决定的。相关分析和回归分析只是定量分析的手段,通过相关分析和回归分析,虽然可以从数量上反映变量之间的联系形式及其密切程度,但是无法准确判断变量之间内在联系的存在与否,也无法判断变量之间的因果关系。因此,在具体应用过程中,一定要注意把定性分析和定量分析结合起来,在定性分析的基础上展开定量分析。

SPSS--回归-多元线性回归模型案例解析!(一) 多元线性回归,主要就是研究一个因变量与多个自变量之间的相关关系,跟一元回归原理差不多,区别在于影响因素(自变量)更多些而已,例如:一元线性回归方程 为: 毫无疑问,多元线性回归方程应该 为: 上图中的 x1, x2, xp分别代表“自变量”Xp截止,代表有P个自变量,如果有“N组样本,那么这个多元线性回归,将会组成一个矩阵,如下图所示: 那么,多元线性回归方程矩阵形式为: 其中:代表随机误差, 其中随机误差分为:可解释的误差与不可解释的误差,随机误差必须满足以下四个条件,多元线性方程才有意义(一元线性方程也一样) 1:服成正太分布,即指:随机误差必须就是服成正太分别的随机变量。 2:无偏性假设,即指:期望值为0 3:同共方差性假设,即指,所有的随机误差变量方差都相等 4:独立性假设,即指:所有的随机误差变量都相互独立,可以用协方差解释。 今天跟大家一起讨论一下,SPSS---多元线性回归的具体操作过程,下面以教程教程数据为例,分析汽车特征与汽车销售量之间的关系。通过分析汽车特征跟汽车销售量的关系,建立拟合多元线性回归模型。数据如下图所示:

点击“分析”——回归——线性——进入如下图所示的界面:

将“销售量”作为“因变量”拖入因变量框内, 将“车长,车宽,耗油率,车净重等10个自变量拖入自变量框内,如上图所示,在“方法”旁边,选择“逐步”,当然,您也可以选择其它的方式,如果您选择“进入”默认的方式,在分析结果中,将会得到如下图所示的结果:(所有的自变量,都会强行进入) 如果您选择“逐步”这个方法,将会得到如下图所示的结果:(将会根据预先设定的“F统计量的概率值进行筛选,最先进入回归方程的“自变量”应该就是跟“因变量”关系最为密切,

多元线性回归分析—内容提要 1.多元线性回归的数学模型 【模型的理论假设】设p x x x ,,,21 是) 2 ( ≥p 个自变量(解释变量),y 是因变量,则多元线性回归模型的理论假设是 εββββ+++++=p p x x x y 22110,),0(~2σεN , 其中,p ββββ,,,,210 是1+p 个未知参数,0β称为回归常数,p βββ,,,21 称为回归系数,),0(~2σεN 为随机误差. 【模型的建立】求p 元线性函数 p p x x x Ey ββββ++++= 22110 的经验回归方程 p p x x x y ββββ?????22110++++= , 其中,y ?是Ey 的统计估计,p ββββ?,,?,?,?210 分别是,,,,,210p ββββ 的统计估计,称为经验回归系数. 【模型的数据结构】设对变量向量y x x x p ,,,,21 的n 次观测得到的样本数据为 ),,,,(21i ip i i y x x x ,) 1 ( ,,2,1 +>=p n i .为了今后讨论方便,我们引进矩阵 ??????? ??=n y y y y 21,??????? ??=np n p p x x x x x x X 1221111111,?????? ? ??=p ββββ????10 ,????? ?? ??=n εεεε 21 于是,多元线性回归模型的数据结构为 εβ+=X y 称为多元样本回归方程,其中n p X rank <+=1)(,) ,(~21n n n n I O N ??σε且各个i ε相互独立. 由于矩阵X 是样本数据,X 的数据可以进行设计和控制,因此,矩阵X 称为回归设计矩阵或资料矩阵. 注释 对多元线性回归模型理论假设的进一步说明:

SPSS 统计分析 多元线性回归分析方法操作与分析 实验目的: 引入1998~2008年上海市城市人口密度、城市居民人均可支配收入、五年以上平均年贷款利率和房屋空置率作为变量,来研究上海房价的变动因素。 实验变量: 以年份、商品房平均售价(元/平方米)、上海市城市人口密度(人/平方公里)、城市居民人均可支配收入(元)、五年以上平均年贷款利率(%)和房屋空置率(%)作为变量。 实验方法:多元线性回归分析法 软件: 操作过程: 第一步:导入Excel数据文件 1.open data document——open data——open;

2. Opening excel data source——OK. 第二步: 1.在最上面菜单里面选中Analyze——Regression——Linear ,Dependent(因变量)选择商品房平均售价,Independents(自变量)选择城市人口密度、城市居民人均可支配收入、五年以上平均年贷款利率、房屋空置率;Method 选择Stepwise.

进入如下界面: 2.点击右侧Statistics,勾选Regression Coefficients(回归系数)选项组中的Estimates;勾选Residuals(残差)选项组中的Durbin-Watson、Casewise diagnostics默认;接着选择Model fit、Collinearity diagnotics;点击Continue.

3.点击右侧Plots,选择*ZPRED(标准化预测值)作为纵轴变量,选择DEPENDNT(因变量)作为横轴变量;勾选选项组中的Standardized Residual Plots(标准化残差图)中的Histogram、Normal probability plot;点击Continue.

第十一章线性相关分析与线性回归分析 11.1 两个变量之间的线性相关分析 相关分析是在分析两个变量之间关系的密切程度时常用的统计分析方法。最简单的相关分析是线性相关分析,即两个变量之间是一种直线相关的关系。相关分析的方法有很多,根据变量的测量层次不同,可以选择不同的相关分析方法。总的来说,变量之间的线性相关关系分为三种。一是正相关,即两个变量的变化方向一致。二是负相关,即两个变量的变化方向相反。三是无相关,即两个变量的变化趋势没有明显的依存关系。两个变量之间的相关程度一般用相关系数r 来表示。r 的取值范围是:-1≤r≤1。∣r∣越接近1,说明两个变量之间的相关性越强。∣r∣越接近0,说明两个变量之间的相关性越弱。相关分析可以通过下述过程来实现: 11.1.1 两个变量之间的线性相关分析过程 1.打开双变量相关分析对话框 执行下述操作: Analyze→Correlate(相关)→Bivariate(双变量)打开双变量相关分析对话框,如图11-1 所示。 图11-1 双变量相关分析对话框 2.选择进行相关分析的变量 从左侧的源变量窗口中选择两个要进行相关分析的变量进入Variable 窗口。 3.选择相关系数。 Correlation Coefficient 是相关系数的选项栏。栏中提供了三个相关系数的选项:(1)Pearson:皮尔逊相关,即积差相关系数。适用于两个变量都为定距以上变量,且两个

变量都服从正态分布的情况。这是系统默认的选项。 (2)Kendall:肯德尔相关系数。它表示的是等级相关,适用于两个变量都为定序变量的情况。 (3)Spearman:斯皮尔曼等级相关。它表示的也是等级相关,也适用于两个变量都为定序变量的情况。 4.确定显著性检验的类型。 Test of Significance 是显著性检验类型的选项栏,栏中包括两个选项: (1)Two-tailed:双尾检验。这是系统默认的选项。 (2)One-tailed:单尾检验。 5.确定是否输出相关系数的显著性水平 Flag significant Correlations:是标出相关系数的显著性选项。如果选中此项,系统在输出结果时,在相关系数的右上方使用“*”表示显著性水平为0.05;用“**”表示显著性水平为0.01。 6. 选择输出的统计量 单击Options 打开对话框,如图11-2 所示。 图11-2 相关分析选项对话框 (1)Statistics 是输出统计量的选项栏。 1)Means and standard deviations 是均值与标准差选项。选择此项,系统将在输出文件中输出均值与标准差。 2)Cross- product deviations and covariances 是叉积离差与协方差选项。选择此项,系统将在输出文件中输出每个变量的离差平方和与两个变量的协方差。 上述两项选择只有在主对话框中选择了Pearson:皮尔逊相关后,计算结果才有价值。 (2)缺失值的处理办法 Missing Valuess 是处理缺失值的选项栏。 1)Exclude cases pairwise 是成对剔除参与相关系数计算的两个变量中有缺失值的个案。2)Exclude cases listwise 是剔除带有缺失值的所有个案。 上述选项做完以后,单击Continue 按钮,返回双变量相关分析对话框。 8.单击OK 按钮,提交运行。系统在输出文件窗口中输出相关分析的结果。 11.1.2 两个变量之间的线性相关分析实例分析

多元回归分析法的介绍及具体应用 在数量分析中,经常会看到变量与变量之间存在着一定的联系。要了解变量之间如何发生相互影响的,就需要利用相关分析和回归分析。回归分析的主要类型:一元线性回归分析、多元线性回归分析、非线性回归分析、曲线估计、时间序列的曲线估计、含虚拟自变量的回归分析以及逻辑回归分析等。这里主要讲的是多元线性回归分析法。 1. 多元线性回归的定义 说到多元线性回归分析前,首先介绍下医院回归线性分析,一元线性回归分析是在排除其他影响因素或假定其他影响因素确定的条件下,分析某一个因素(自变量)是如何影响另一事物(因变量)的过程,所进行的分析是比较理想化的。其实,在现实社会生活中,任何一个事物(因变量)总是受到其他多种事物(多个自变量)的影响。 一元线性回归分析讨论的回归问题只涉及了一个自变量,但在实际问题中,影响因变量的因素往往有多个。例如,商品的需求除了受自身价格的影响外,还要受到消费者收入、其他商品的价格、消费者偏好等因素的影响;影响水果产量的外界因素有平均气温、平均日照时数、平均湿度等。 因此,在许多场合,仅仅考虑单个变量是不够的,还需要就一个因变量与多个自变量的联系来进行考察,才能获得比较满意的结果。这就产生了测定多因素之间相关关系的问题。 研究在线性相关条件下,两个或两个以上自变量对一个因变量的数量变化关系,称为多元线性回归分析,表现这一数量关系的数学公式,称为多元线性回归模型。 多元线性回归模型是一元线性回归模型的扩展,其基本原理与一元线性回归模型类似,只是在计算上更为复杂,一般需借助计算机来完成。 2. 多元回归线性分析的运用 具体地说,多元线性回归分析主要解决以下几方面的问题。 (1)、确定几个特定的变量之间是否存在相关关系,如果存在的话,找出它