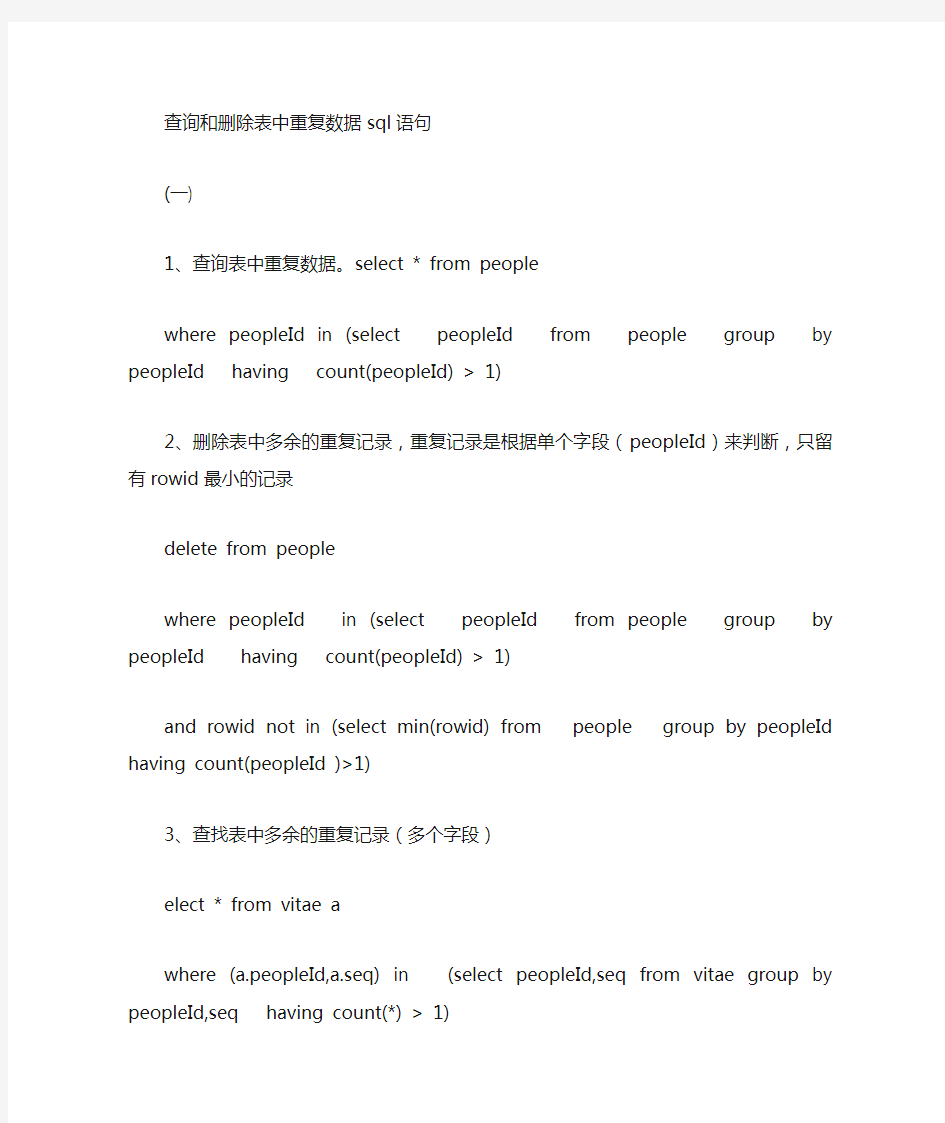

查询和删除表中重复数据sql语句

(一)

1、查询表中重复数据。select * from people

where peopleId in (select peopleId from people group by peopleId having count(peopleId) > 1)

2、删除表中多余的重复记录,重复记录是根据单个字段(peopleId)来判断,只留有rowid 最小的记录

delete from people

where peopleId in (select peopleId from people group by peopleId having count(peopleId) > 1)

and rowid not in (select min(rowid) from people group by peopleId having count(peopleId )>1)

3、查找表中多余的重复记录(多个字段)

elect * from vitae a

where (a.peopleId,a.seq) in (select peopleId,seq from vitae group by peopleId,seq having count(*) > 1)

4、删除表中多余的重复记录(多个字段),只留有rowid最小的记录

delete from vitae a

where (a.peopleId,a.seq) in (select peopleId,seq from vitae group by peopleId,seq having count(*) > 1)

and rowid not in (select min(rowid) from vitae group by peopleId,seq having count(*)>1)

5、查找表中多余的重复记录(多个字段),不包含rowid最小的记录

select * from vitae a

where (a.peopleId,a.seq) in (select peopleId,seq from vitae group by peopleId,seq having count(*) > 1)

and rowid not in (select min(rowid) from vitae group by peopleId,seq having count(*)>1)

(二)

比方说

在A表中存在一个字段“name”,

而且不同记录之间的“name”值有可能会相同,

现在就是需要查询出在该表中的各记录之间,“name”值存在重复的项;

Select Name,Count(*) From A Group By Name Having Count(*) > 1

如果还查性别也相同大则如下:

Select Name,sex,Count(*) From A Group By Name,sex Having Count(*) > 1

(三)

方法一

declare @max integer,@id integer

declare cur_rows cursor local for select 主字段,count(*) from 表名group by 主字段having count(*) >;1

open cur_rows

fetch cur_rows into @id,@max

while @@fetch_status=0

begin

select @max = @max -1

set rowcount @max

delete from 表名where 主字段= @id

fetch cur_rows into @id,@max

end

close cur_rows

set rowcount 0

方法二

"重复记录"有两个意义上的重复记录,一是完全重复的记录,也即所有字段均重复的记录,二是部分关键字段重复的记录,比如Name字段重复,而其他字段不一定重复或都重复可以忽略。

1、对于第一种重复,比较容易解决,使用

select distinct * from tableName

就可以得到无重复记录的结果集。

如果该表需要删除重复的记录(重复记录保留1条),可以按以下方法删除

select distinct * into #Tmp from tableName

drop table tableName

select * into tableName from #Tmp

drop table #Tmp

发生这种重复的原因是表设计不周产生的,增加唯一索引列即可解决。

2、这类重复问题通常要求保留重复记录中的第一条记录,操作方法如下

假设有重复的字段为Name,Address,要求得到这两个字段唯一的结果集

select identity(int,1,1) as autoID, * into #Tmp from tableName

select min(autoID) as autoID into #Tmp2 from #Tmp group by Name,autoID

select * from #Tmp where autoID in(select autoID from #tmp2)

最后一个select即得到了Name,Address不重复的结果集(但多了一个autoID字段,实际写时可以写在select子句中省去此列)

(四)

查询重复

select * from tablename where id in (select id from tablename group by id

having count(id) > 1)

结构大概这样,这只是一个简单的例子,实际情况会复杂得多。 比如我想用一条语句查询得到name不重复的所有数据,那就必须使用distinct去掉多余的重复记录。 select distinct name from table 得到的结果是: name a b c 好像达到效果了,可是,我想要得到的是id值呢?改一下查询语句吧: select distinct name, id from table 结果会是: id name 1 a 2 b 3 c 4 c 5 b distinct怎么没起作用?作用是起了的,不过他同时作用了两个字段 ,也就是必须得id与name都相同的才会被排除。。。。。。。 我们再改改查询语句: select id, distinct name from table 很遗憾,除了错误信息你什么也得不到,distinct必须放在开头。难 到不能把distinct放到where条件里?能,照样报错。。。。。。。 很麻烦吧?确实,费尽心思都没能解决这个问题。没办法,继续找人问。

拉住公司里一JA V A程序员,他给我演示了oracle里使用distinct之后,也没找到mysql里的解决方案,最后下班之前他建议我试试group by。 试了半天,也不行,最后在mysql手册里找到一个用法,用 group_concat(distinct name)配合group by name实现了我所需要的 功能,兴奋,天佑我也,赶快试试。 报错。。。。。。。。。。。。郁闷。。。。。。。连mysql手册也 跟我过不去,先给了我希望,然后又把我推向失望,好狠哪。。。。 再仔细一查,group_concat函数是4.1支持,晕,我4.0的。没办法,升级,升完级一试,成功。。。。。。 终于搞定了,不过这样一来,又必须要求客户也升级了。 突然灵机一闪,既然可以使用group_concat函数,那其它函数能行吗? 赶紧用count函数一试,成功,我。。。。。。。想哭啊,费了这么 多工夫。。。。。。。。原来就这么简单。。。。。。 现在将完整语句放出: select *, count(distinct name) from table group by name 结果: id name count(distinct name) 1 a 1 2 b 1 3 c 1 最后一项是多余的,不用管就行了,目的达到。。。。。

重复数据删除(De-duplication)技术研究 文章地直址:https://www.doczj.com/doc/8b3253162.html,/liuaigui/article/details/5829083 1、Dedupe概述 De-duplication,即重复数据删除,它是一种目前主流且非常热门的存储技术,可对存储容量进行有效优化。它通过删除数据集中重复的数据,只保留其中一份,从而消除冗余数据。如下图所示。这种技术可以很大程度上减少对物理存储空间的需求,从而满足日益增长的数据存储需求。Dedupe技术可以带许多实际的利益,主要包括以下诸多方面: (1) 满足ROI(投资回报率,Return On Investment)/TCO(总持有成本,Total Cost of Ownership)需求; (2) 可以有效控制数据的急剧增长; (3) 增加有效存储空间,提高存储效率; (4) 节省存储总成本和管理成本; (5) 节省数据传输的网络带宽; (6) 节省空间、电力供应、冷却等运维成本。 Dedupe技术目前大量应用于数据备份与归档系统,因为对数据进行多次备份后,存在大量重复数据,非常适合这种技术。事实上,dedupe技术可以用于很多场合,包括在线数据、近线数据、离线数据存储系统,可以在文件系统、卷管理器、NAS、SAN中实施。Dedupe也可以用于数据容灾、数据传输与同步,作为一种数据压缩技术可用于数据打包。Dedupe技术可以帮助众多应用降低数据存储量,节省网络带宽,提高存储效率、减小备份窗口,节省成本。 Dedupe的衡量维度主要有两个,即重复数据删除率(deduplocation ratios)和性能。Dedupe性能取决于具体实现技术,而重复数据删除率则由数据自身的特征和应用模式所决定,影响因素如下表[2]所示。目前各存储厂商公布的重复数据删除率从20:1到500:1不等。

SQL删除重复数据 (2009-05-16 12:40:00) 转载 标签: 分类:一路辛酸---C# sql删除 重复数据 delete 执行效率 it 重复的数据可能有这样两种情况,第一种时表中只有某些字段一样,第二种是两行记录完全一样。 一、对于部分字段重复数据的删除 先来谈谈如何查询重复的数据吧。 下面语句可以查询出那些数据是重复的: select字段1,字段2,count(*) from 表名group by 字段1,字段2 having count(*) > 1 将上面的>号改为=号就可以查询出没有重复的数据了。 想要删除这些重复的数据,可以使用下面语句进行删除 delete from表名a where 字段1,字段2 in (select 字段1,字段2,count(*) from 表名group by 字段1,字段2 having count(*) > 1) 上面的语句非常简单,就是将查询到的数据删除掉。不过这种删除执行的效率非常低,对于大数据量来说,可能会将数据库吊死。所以我建议先将查询到的重复的数据插入到一个临时表中,然后对进行删除,这样,执行删除的时候就不用再进行一次查询了。如下:

CREATE TABLE临时表AS (select 字段1,字段2,count(*) from 表名group by 字段1,字段2 having count(*) > 1) 上面这句话就是建立了临时表,并将查询到的数据插入其中。 下面就可以进行这样的删除操作了: delete from 表名a where 字段1,字段2 in (select 字段1,字段2 from 临时表); 这种先建临时表再进行删除的操作要比直接用一条语句进行删除要高效得多。 这个时候,大家可能会跳出来说,什么?你叫我们执行这种语句,那不是把所有重复的全都删除吗?而我们想保留重复数据中最新的一条记录啊!大家不要急,下面我就讲一下如何进行这种操作。 在oracle中,有个隐藏了自动rowid,里面给每条记录一个唯一的rowid,我们如果想保留最新的一条记录,我们就可以利用这个字段,保留重复数据中rowid最大的一条记录就可以了。 下面是查询重复数据的一个例子: select a.rowid,a.* from表名a where a.rowid != ( select max(b.rowid) from 表名b where a.字段1 = b.字段1 and a.字段2 = b.字段2 ) 下面我就来讲解一下,上面括号中的语句是查询出重复数据中rowid最大的一条记录。 而外面就是查询出除了rowid最大之外的其他重复的数据了。 由此,我们要删除重复数据,只保留最新的一条数据,就可以这样写了: delete from 表名a where a.rowid !=

SQL语句的添加、删除、修改 SQL语句的添加、删除、修改虽然有如下很多种方法,但在使用过程中还是不够用,不知是否有高手把更多灵活的使用方法贡献出来? {select * from 数据表 where 字段名 between 值1 and 值2 insert into 数据表 (字段1,字段2,字段3 …) valuess (值1,值2,值3 …) update 数据表 set 字段名=字段值 where 条件表达式 delete from 数据表 where 条件表达式} 添加、删除、修改使用db.Execute(Sql)命令执行操作 ╔--------------------╗ ☆数据记录筛选☆ ╚--------------------╝ 注意:单双引号的用法可能有误(没有测式) Sql = "Select Distinct 字段名 From 数据表" Distinct函数,查询数据库存表内不重复的记录 Sql = "Select Count(*) From 数据表 where 字段名1>#18:0:0# and 字段名1< #19:00# " count函数,查询数库表内有多少条记录,“字段名1”是指同一字段 例: set rs=conn.execute("select count(id) as idnum from news") response.write rs("idnum") sql="select * from 数据表 where 字段名 between 值1 and 值2" Sql="select * from 数据表where 字段名between #2003-8-10# and #2003-8-12#" 在日期类数值为2003-8-10 19:55:08 的字段里查找2003-8-10至2003-8-12的所有记录,而不管是几点几分。 select * from tb_name where datetime between #2003-8-10# and #2003-8-12# 字段里面的数据格式为:2003-8-10 19:55:08,通过sql查出2003-8-10至2003-8-12的所有纪录,而不管是几点几分。

SQL中重复数据的查询与删除 ========第一篇========= 在一张表中某个字段下面有重复记录,有很多方法,但是有一个方法,是比较高效的,如下语句: select data_guid from adam_entity_datas a where a.rowid > (select min(b.rowid) from adam_entity_datas b where b.data_guid = a.data_guid) 如果表中有大量数据,但是重复数据比较少,那么可以用下面的语句提高效率 select data_guid from adam_entity_datas where data_guid in (select data_guid from adam_entity_datas group by data_guid having count(*) > 1) 此方法查询出所有重复记录了,也就是说,只要是重复的就选出来,下面的语句也许更高效select data_guid from adam_entity_datas where rowid in (select rid from (select rowid rid,row_number()over(partition by data_guid order by rowid) m from adam_entity_datas) where m <> 1) 目前只知道这三种比较有效的方法。 第一种方法比较好理解,但是最慢,第二种方法最快,但是选出来的记录是所有重复的记录,而不是一个重复记录的列表,第三种方法,我认为最好。 ========第二篇========= select usercode,count(*) from ptype group by usercode having count(*) >1 ========第三篇========= 找出重复记录的ID: select ID from ( select ID ,count(*) as Cnt from 要消除重复的表 group by ID ) T1 where https://www.doczj.com/doc/8b3253162.html,t>1 删除数据库中重复数据的几个方法 数据库的使用过程中由于程序方面的问题有时候会碰到重复数据,重复数据导致了数据库部分设置不能正确设置…… 方法一

数据库增删改查基本语句 adoquery1.Fielddefs[1].Name; 字段名 dbgrid1.columns[0].width:=10; dbgrid的字段宽度 adoquery1.Fields[i].DataType=ftString 字段类型 update jb_spzl set kp_item_name=upper(kp_item_name) 修改数据库表中某一列为大写select * from master.dbo.sysobjects ,jm_https://www.doczj.com/doc/8b3253162.html,ers 多库查询 adotable1.sort:='字段名称ASC' adotable排序 SQL常用语句一览 sp_password null,'新密码','sa' 修改数据库密码 (1)数据记录筛选: sql="select * from 数据表where 字段名=字段值orderby 字段名[desc] " sql="select * from 数据表where 字段名like '%字段值%' orderby 字段名[desc]" sql="select top10 * from 数据表where 字段名orderby 字段名[desc]" sql="select * from 数据表where 字段名in('值1','值2','值3')" sql="select * from 数据表where 字段名between 值1 and 值2" (2)更新数据记录: sql="update 数据表set 字段名=字段值where 条件表达式" sql="update 数据表set 字段1=值1,字段2=值2……字段n=值n where 条件表达式" (3)删除数据记录: sql="delete from 数据表where 条件表达式" sql="delete from 数据表"(将数据表所有记录删除) (4)添加数据记录: sql="insert into 数据表(字段1,字段2,字段3…) values(值1,值2,值3…)" sql="insert into 目标数据表select * from 源数据表"(把源数据表的记录添加到目标数据表)

删除SQL Server 的特定实例 若要删除SQL Server 的特定实例,请按照下列步骤操作: 1.找到并删除%drive%:\Program Files\Microsoft SQL Server\MSSQL\Binn 文件 夹,其中%drive%是要删除的SQL Server 实例的位置。 2.找到以下注册表项: o HKEY_LOCAL_MACHINE\SOFTWARE\Microsoft\MSSQLServer 注意:如果要删除默认实例,则必须删除除Client项以外的所有项。 o HKEY_LOCAL_MACHINE\SOFTWARE\Microsoft\Microsoft SQL Server 必须使用Regedt32.exe 来编辑要删除的实例的InstalledInstances 值。默认实例的显示名称为MSSQLSERVER,而命名实例的显示名称则为给该 实例指定的名称。 注意:不能使用Regedit.exe 编辑该值;您必须使用Regedt32.exe。 注意:如果这是SQL Server 2000 的群集实例,请为群集中的每个节点重复执行这些步骤。 删除SQL Server 的所有已知实例 若要删除SQL Server 的所有已知实例,请按照下列步骤操作: 1.找到并删除%drive%:\Program Files\Microsoft SQL Server\MSSQL\Binn 文件 夹。 2.找到并删除以下注册表项: o HKEY_LOCAL_MACHINE\SOFTWARE\Microsoft\MSSQLServer o HKEY_LOCAL_MACHINE\SOFTWARE\Microsoft\Microsoft SQL Server 3.找到并删除以下注册表项: o HKEY_LOCAL_MACHINE\SYSTEM\CurrentControlSet\Services\MSSQL Server o HKEY_LOCAL_MACHINE\SYSTEM\CurrentControlSet\Services\SQLSER VERAGENT o HKEY_LOCAL_MACHINE\SYSTEM\CurrentControlSet\Services\MSSQL ServerADHelper 4.步骤3 中的三个注册表项对应于Microsoft SQL Server 2000 的默认实例。命名实例 对应的注册表项与步骤 3 中列出的注册表项类似,但后面带有$instance_name,因

一、增:有2种方法 1.使用insert插入单行数据: 语法:insert [into]<表名> [列名] values <列值> 例:insert into Strdents (姓名,性别,出生日期) values ('邢金聪','男','1990/6/15') 注意:如果省略表名,将依次插入所有列 2.使用insert,select语句将现有表中的数据添加到已有的新表中 语法:insert into <已有的新表> <列名> select <原表列名> from <原表名> 例:insert into addressList ('姓名','地址','电子邮件')selectname,address,email from Strdents 注意:查询得到的数据个数、顺序、数据类型等,必须与插入的项保持一致 二、删:有2中方法 1.使用delete删除数据某些数据 语法:delete from <表名> [where <删除条件>] 例:delete from awhere name='邢金聪'(删除表a中列值为邢金聪的行) 注意:删除整行不是删除单个字段,所以在delete后面不能出现字段名 2.使用truncate table 删除整个表的数据

语法:truncate table<表名> 例:truncate table addressList 注意:删除表的所有行,但表的结构、列、约束、索引等不会被删除;不能 用于有外建约束引用的表 三、改 使用update更新修改数据 语法:update <表名> set <列名=更新值> [where <更新条件>] 例:truncate table addressList 注意:删除表的所有行,但表的结构、列、约束、索引等不会被删除;不能 用于有外建约束引用的表 四、查 1.普通查询 语法:select <列名> from <表名> [where <查询条件表达试>] [order by<排序的列 名>[asc或desc]] 1).查询所有数据行和列 例:select * from a 说明:查询a表中所有行和 2).查询部分行列--条件查询 例:select i,j,kfrom a where f=5 说明:查询表a中f=5的所有行,并显示i,j,k3列

重复数据删除技术的产生是有一定的渊源,那就从头说起,虽然现在存储介质的价格直线下滑,单位存储成本已经很低。但是仍然跟不上企业数据文件增长的速度。随之而来的,能源消耗、数据备份管理等等也都成了老大难问题。而且一些重复的文件也随着增多了。为此企业现在迫切需要一门技术,能够确保在存储设备中存储的是独一无二的文件。在这种背景下,重复数据删除技术就应运而生啦。重复数据删除技术的目的很简单,就是确保存储的文件不重复,从而减少数据容量。不过在实际工作中,由于种种原因用户对这个技术还存在着一些误解。消除这些误区,对于大家正确使用重复数据删除技术很关键。 误区一:后期处理重复数据删除技术的工作时机。 重复数据删除技术根据其实现的方式可以分为“联机重复数据删除技术”和“后期处理重复数据删除技术”。两个技术各有各的特点。不过由于“后期处理重复数据删除技术”这个名字起得有点其一,所以不少用户对此存在着误解。如一些人会误认为后期处理重复数据删除方式是当所有数据备份过程结束后才进行验证、删除操作的。如果大家这么认为,那么就是大错特错了。 其实后期处理重复数据删除技术通常是在虚拟的磁带介质写入备份数据后就开始进行工作了。也就是说实在等待虚拟磁带写满之后就开始。当然这中间根据需要有一定的延迟。如存储管理员可以根据不同的情况对这个延迟进行设置。可以只延迟短短的几分钟,也可以延迟几个小时。延迟时间具体为多少,主要还是根据企业的实际情况来选择。如有些管理员可能会将这个作业放在服务器比较空闲的时候进行,此时就会把这个延迟设置的比较长一点,如等到下班后进行等等。 这里需要注意的是一般情况下,为了提高数据备份的效率,会对数据备份进行分组管理。此时等待时间是从第一组备份任务传送备份数据流开始算起。当第一盘虚拟的备份磁带写满或者第一组备份数据写入结束后,重复数据删除处理就不存在延迟等待问题。这主要是因为当系统在进行前一组写入备份数据进行重复数据删除处理时,被分系统可以继续往后续虚拟磁带介质中写入第二组的备份数据。简单的说,就是重复数据处理作业与备份数据的写入作业可以独立运行。从而提高数据处理的效率。 误区二:后期处理重复数据删除方式会降低整体备份的效率。 如果光从技术上看,这个结论是成立的。一方面重复删除方式会占用服务器的资源。另一方面,重复删除方式存在着一定的延迟。但是这是一个比较孤立的观点。因为根据现在的重复数据删除技术,完全可以通过合理的配置来消除这种负面影响。 在实际工作中,如果技术人员发现后期处理重复数据删除技术降低了数据备份的效率,那么可以通过如下几种方式来消除这个不利影响。一是可以将重复数据删除技术分配到多个单独的服务器上来分担服务器的压力。一般情况下在对已写入的备份数据进行重复数据删除时,不同的处理引擎往往会访问同一磁盘阵列。不过现在的技术可以使得他们访问同一磁盘阵列的不同区域。换句话说,就是可以实现高速的并发处理。这样的话,就不会和持续写入的备份数据流产生任何的冲突,从而不会影响数据备份的效率。二是可以适当调整数据延迟的时间。如可以缩短延迟时间,或者适当延长延迟时间避开数据备份的高峰时间等等。 总之,后期处理重复数据删除技术在一定程度上确实会影响到数据备份的整体效率。但是通过合理的配置,可以将这个负面影响降低到最低的程度。至少与其优势相比,这个负面影响是可以忽略不计的。 误区三:降低备份数据流的读取速度不利于数据备份。

(Oracle管理)ORACLE 中删除重复记录

ORACLE中删除重复记录 平时工作中可能会遇见当试图对库表中的某一列或几列创建唯一索引时,系统提示ora-01452:不能创建唯一索引,发现重复记录。 下面总结一下几种查找和删除重复记录的方法(以表cz为例): 表cz的结构如下: sql>desccz namenull?type ------------------------------------------------------------------- c1number(10) c10number(5) c20varchar2(3) 删除重复记录的方法原理: (1).在oracle中,每一条记录都有一个rowid,rowid在整个数据库中是唯一的,rowid确定了每条记录是在oracle中的哪一个数据文件、块、行上。 (2).在重复的记录中,可能所有列的内容都相同,但rowid不会相同,所以只要确定出重复记录中那些具有最大rowid的就能了,其余全部删除。 重复记录判断的标准是: c1,c10和c20这三列的值都相同才算是重复记录。 经查看表cz总共有16条记录: sql>setpagesize100 sql>select*fromcz; c1c10c20 -----------------------

12dsf 12dsf 12dsf 12dsf 23che 12dsf 12dsf 12dsf 12dsf 23che 23che 23che 23che 34dff 34dff 34dff 45err 53dar 61wee 72zxc 20rowsselected. 1.查找重复记录的几种方法:

数据库中的有关表删除的SQL关键字有drop,delete以及truncate三个。 它们的SQL语句格式如下:(假如表名为Table_name) drop table Table_name; --------------------完全删除表 delete Table_name;-----------------删除表内数据,保留表结构 truncate table Table_name;-----------------完全删除表内数据,保留表结构delete from Table_name where 条件;-------------------------------删除相关数据下面举例说明它们的区别: 首先,创建一个表Users create table Users( id int identity(1,1), name varchar(20) ) 执行;再往表内插入数据: insert into Users values('A'); insert into Users(name) values('B'); 执行;此时select*from Users; 结果如下: ①如果执行删除语句: delete Users; select*from Users; 结果是 此时再插入数据: insert into Users(name) values('CC'); select*from Users; 结果是: ②如果执行删除语句: truncate table Users; select*from Users; 结果是:

此时再插入数据: insert into Users(name) values('CC'); select*from Users; 结果是: ③如果执行删除语句: drop table Users; 则完全删除表,此时无论执行select*from Users;还是insert into Users(name) values('CC'); 都会提示表Users无效

第39卷第Z1期通信学报V ol.39No.Z1 2018年9月Journal on Communications September 2018 云计算中高效加密数据重复删除方法 张曙光1,2,3,咸鹤群1,2,王利明3,于凯杰4,张曼1 (1. 青岛大学计算机科学技术学院,山东青岛 266071; 2. 西安电子科技大学综合业务网理论及关键技术国家重点实验室,陕西西安 710071; 3.中国科学院信息工程研究所,北京 100093; 4.烟台冰轮铸造有限公司生产制造部,山东烟台 264006) 摘要:将海量数据外包至云服务器的应用模式已经被越来越多的用户所接受。然而,由于安全问题日益凸显,数 据在上传至云服务器之前通常会被用户加密,这给云服务提供商带来巨大的存储压力。相同明文数据或被多个用户 加密为不同密文数据,导致云服务提供商难以执行重复数据删除。目前支持加密数据重复删除的云存储系统过度依 赖可信第三方,且未考虑数据所有权问题,实用性较差。提出云计算中加密数据高效安全存储方法,使用双线性映 射与基于属性代理重加密机制,设计冗余度查询标签生成算法与密钥传递算法,保证云服务提供商在无第三方在线 协助的情况下,能够验证加密数据是否冗余,并完成加密数据重复删除。构造了动态更新该数据的所有权算法,保 证系统的安全性。安全分析与效率评估证明,所提方案能够在保证系统在安全性的前提下,实现存储效率最大化。 关键词:云存储系统;数据安全;加密重复删除;数据所有权 中图分类号:TP309 文献标识码:A doi: 10.11959/j.issn.1000-436x.2018188 Efficient encrypted data deduplication method in cloud computing ZHANG Shuguang1,2,3 , XIAN Hequn1,2 , WANG Liming3, YU Kaijie4, ZHANG Man1 1.College of Computer Science Technology, Qingdao University, Qingdao 266071, China 2. State Key Laboratory of Integrated Services Networks, Xidian University , Xi’an 710071, China 3. Institute of Information Engineering, Chinese Academy of Sciences, Beijing 100093, China 4. Yantai Moon Foundry Co., Manufacturing Department, Yantai 264006, China Abstract: Outsourcing massive data to remote cloud servers has become a common practice. However, as security issues arise increasingly, data are usually encrypted by users before being uploaded to the cloud server, such operation brings huge storage pressure to the cloud service provider. The same plaintext may be encrypted into different ciphertext by multiple users, causing the cloud service provider unable to perform deduplication. Several cloud storage systems that support the encrypted data deduplication have been proposed. However, these schemes are impractical because they rely heavily on third parties and do not address the data ownership update issues. A secure efficient deduplication method for encrypted data in cloud computing was proposed. Based on bilinear mapping and attribute-based proxy re-encryption mechanism, the redundancy check tag generation algorithm and key deliver algorithm were designed to ensure that the cloud service provider can verify the redundancy of encrypted data without any online third-party assistance. A dynamic data ownership update algorithm was constructed to ensure the security of the system. Security analysis and efficiency evaluation show that our scheme can provide promising storage efficiency while ensuring the system with high security. Key words: cloud storage system, data security, encryption deduplication, data ownership 收稿日期:2018-09-18 基金项目:国家自然科学基金资助项目(No.61303197);综合业务网理论及关键技术国家重点实验室开放课题(No.ISN19-14);赛尔网络下一代互联网创新项目(No.NGII20170414) Foundation Items: The National Natural Science Foundation of China (No.61303197), Open Project Program of the State Key La-boratory of Integrated Services Networks(No.ISN19-14), CERNET Innovation Project (No.NGII20170414) 2018188-1 万方数据

一个简单的去除重复字段的SQL查询语句 2009-11-16 17:12 一个简单的去除重复字段的SQL查询语句 [2008-11-04 16:01:15 by rainoxu] | 分类:我的知识库 今天公司里让.Net程序修改一个程序,需要去掉输出中的重复楼盘名称,一开始想到的是Distinct,但死路不通,只能改道,最终偶在网上找到了一个思路,修改了一下就有了。 先看所有记录(这是我在测试的数据库里做的): OK,我们这样来消除重复项:

1. select * from table1 as a where not exists(select 1 from table1 where logID=a.LogID and ID>a.ID) 2. 最近做一个数据库的数据导入功能,发现联合主键约束导致不能导入,原因是源表中有重复数据,但是源表中又没有主键,很是麻烦。经过努力终于解决了,现在就来和大家分享一下,有更好的办法的可以相互交流。 有重复数据主要有一下几种情况: 1.存在两条完全相同的纪录 这是最简单的一种情况,用关键字distinct就可以去掉

example:select distinct * from table(表名) where (条件) 2.存在部分字段相同的纪录(有主键id即唯一键) 如果是这种情况的话用distinct是过滤不了的,这就要用到主键id的唯一性特点及group by分组 example: select * from table where id in (select max(id) from table group by [去除重复的字段名列表,....]) 3.没有唯一键ID 这种情况我觉得最复杂,目前我只会一种方法,有那位知道其他方法的可以留言,交流一下: example: select identity(int1,1) as id,* into newtable(临时表) from table select * from newtable where id in (select max(id) from newtable group by [去除重复的字段名列表,....]) drop table newtable 关于一个去除重复记录的sql语句

使用SQL语句: CREATE DATABASE语句创建数据库 CREATE DATABASE database_name [ON [PRIMARY] [

重复数据删除技术简介 这篇文章基于现有的SNIA材料,描述了重复数据删除流程可以进行的几个不同的地方;探讨了压缩与单实例文件以及重复数据删除之间的不同点;研究了次文件层重复数据删除执行的几个不同方式。它同时还解释了哪种类型的数据适合重复数据删除,以及哪些不适合。 介绍 重复数据删除已经成为存储行业非常热门的话题和一大类商业产品。这是因为重复数据删除可以大幅减少购置和运行成本,同时提高存储效率。随着数据量的爆炸性增长,接近一半的数据中心管理员都将数据增长评为三大挑战之一。根据最近的Gartner调查结果,重复数据删除可以减轻存储预算的压力并帮助存储管理员应对数据的增长。 虽然重复数据删除主要被视为一种容量优化技术,不过该技术也可以带来性能上的好处--随着所需存储的数据的减少,系统所需迁移的数据也减少。 重复数据删除技术可以应用在数据生命周期上的不同点上:从来源端重复数据删除,到传输中重复数据删除,一直到存储目标端重复数据删除。这些技术还可以应用在所有的存储层上:备份、归档和主存储。 重复数据删除的解释 无论使用哪种方式,重复数据删除就是一个在不同层次的粒度性上识别重复数据并将重复数据替代为指向共享复件的指针的过程,这样可以节约存储空间和迁移数据所需的带宽。 重复数据删除流程包括跟踪并识别那些被删除的重复数据,以及识别和存储那些新的和独一无二的数据。数据的终端用户完全不会感到这些数据可能已经被执行重复数据删除流程并已经在其数据生命周期中被重建许多次。 对数据进行重复数据删除操作有几种不同的方式。单实例存储(SIS)是在文件或块层次上进行重复数据删除。重复副本会被一个带着指针的实例所取代,而指针则指向原始文件或对象。 次文件层重复数据删除的操作粒度则比文件或对象更小。这种技术有两种常见的方式:固定块重复数据删除--数据被分解成固定长度的部分或块;可变长度重复数据删除--数据根据一个滑行的窗口进行重复数据删除。 数据压缩是对数据进行编码以减小它的大小;它还可以用于那些已经被重复数据删除的数据以进一步减少存储消耗。重复数据删除和数据压缩虽不同但互补--例如,数据可能重复数据删除的效率很高但是压缩的效率很低。 此外,重复数据删除数据可以在线执行;也就是说,在数据被写入目标端的时候进行重复数据删除操作;当然,重复数据删除也可以以后处理的方式执行,也就是在数据已经被写入并存储在磁盘上的时候执行。 这是一个简化的重复数据删除例子,我们有两个由块组成的对象或文件。下图显示了这些对象或文件的情况。对象或文件可以是可变的或基于窗口的部分、固定块或文件集合--可以应用同样的原则。在这个例子中,每个对象所包含的块由字母来区分。

六种SQL Server删除重复行的方法 SQL Server删除重复行是我们最常见的操作之一,下面就为您介绍六种适合不同情况的SQL Server删除重复行的方法,供您参考。 1.如果有ID字段,就是具有唯一性的字段 1.delect table where id not in ( 2. 3.select max(id) from table group by col1,col2,col3... 4.) group by 子句后跟的字段就是你用来判断重复的条件,如只有col1,那么只要col1字段内容相同即表示记录相同。 2. 如果是判断所有字段也可以这样 1.select * into #aa from table group by id1,id2,.... 2.delete table 3.insert into table 4.select * from #aa 3. 没有ID的情况 1.select identity(int,1,1) as id,* into #temp from tabel 2.delect # where id not in ( 3.select max(id) from # group by col1,col2,col3...) 4.delect table 5.inset into table(...) 6.select ..... from #temp 4. col1+','+col2+','...col5 联合主键 1.select * from table where col1+','+col2+','...col5 in ( 2.select max(col1+','+col2+','...col5) from table 3.where having count(*)>1 4.group by col1,col2,col3,col4 5.) group by 子句后跟的字段就是你用来判断重复的条件,如只有col1,那么只要col1字段内容相同即表示记录相同。 5.

1、使用SQL语句: CREATE DATABASE语句创建数据库 CREATE DATABASE database_name [ON [PRIMARY] [<> [ ,...n] [ , <> [ ,...n ] ] [LOG ON { <> [ ,...n ] } ] <>::= { ( NAME=logical_ , = 'os_' [ SIZE=size [KB|MB|GB|TB] ] [ MAXSIZE={max_size [KB|MB|GB|TB] | UNLIMITED } ] [[KB|MB|GB|TB|% ] ] ) [ ,...n ] } <> ::= { <> [ ,...n ] } T-SQL语法说明: ●“[ ]”中的内容表示可以省略,省略时系统取默认值。 ●“{ }[ ,…n ]”表示花括号中的内容可以重复书写n次,必须用逗号隔 开。 ●“|”表示相邻前后两项只能任取一项。 ●一条语句可以分成多行书写,但多条语句不允许写在一行。 CREATE DATABASE 数据库名 [ ON [PRIMARY] { ( [NAME=数据文件的逻辑名称,] ‘数据文件的物理名称’, [SIZE=数据文件的初始大小[ MB(默认) | KB | GB ] , ] [MAXSIZE={ 数据文件的最大容量[ MB | KB | GB] |UNLIMITED(不受限制) } ,] [数据文件的增长量[ MB | KB | GB | % ] ] )

} [ , …n ] [ 文件组名 { ( [NAME=数据文件的逻辑名称,] [‘数据文件的物理名称’, ] [SIZE=数据文件的初始大小[ MB | KB | GB ] ,] [MAXSIZE={ 数据文件的最大容量[ MB | KB | GB ] | UNLIMITED } ,] [数据文件的增长量[ MB | KB | GB | % ] ] ) } [ , …n ] ] LOG ON { ( [NAME=事务日志文件的逻辑名称,] [‘事务日志文件的物理名称’,] [SIZE=事务日志文件的初始大小[MB | KB | GB ] ,] [MAXSIZE={ 事务日志文件的最大容量[ MB | KB | GB ] | UNLIMITED } ,] [事务日志文件的增长量[ MB|KB|GB| % ]] ) } [ , …n ] ] 说明: ●ON 表示需根据后面的参数创建该数据库。 ●LOG ON 子句用于根据后面的参数创建该数据库的事务日志文件。 ●PRIMARY指定后面定义的数据文件属于主文件组PRIMARY,也可以加入 用户自己创建的文件组。 ●NAME=‘数据文件的逻辑名称’:是该文件在系统中使用的标识名称,相 当于别名。 ●‘数据文件的物理名称’:指定文件的实际名称,包括路径和后缀。 ●UNLIMITED 表示在磁盘容量允许情况下不受限制。 ●文件容量默认单位为MB字节,也可以使用KB单位。 例题一: 用T-SQL语句在C:\DATA\文件夹中创建一个教师信息数据库teacher,该数据库包含: 1、一个主数据文件逻辑名‘teacherdata1 ’, 物理名‘C:\DATA\tdata1.mdf ’, 初始容量1MB,最大容量10MB,每次增长量为15%。 2、一个辅助数据文件逻辑名‘teacherdata2 ’ 物理名‘C:\DATA\tdata2.ndf ’, 初始容量2MB,最大容量15MB,每次增长量为2MB。