龙源期刊网 https://www.doczj.com/doc/dd12421287.html,

基于深度学习的图像分类分析研究

作者:李翔宇孙晓庆

来源:《中国信息化》2019年第04期

随着科学发展,近年来,人工智能、深度学习蓬勃发展,在越来越多的领域中得到了广泛运用,人工智能是当前的热点话题,越来越多的行业正在对人工智能及其相关学科进行研究。人工智能的一大特点就是自学习能力,即提供学习的数据越多,处理能力越强,因此大数据处理是人工智能密不可分的一部分,深度学习作为人工智能的重要部分也具备同样的特点,而图像则是一种重要的学习数据

图像是对人类来说是一种直观的表现方式,我们可以通过图像获取视觉的内容,并且了解其含义,可是对计算机来说,它只能通过图像得到对应的数字矩阵,而通过矩阵来理解内容有一定的难度。因此为了便于计算机理解图像所表达的意义以及传递的思想,需要用到图像分类来解析成计算机可以理解的内容。简单的图像分类包括为图像打上一个具体的标签。复杂的图像分类可以分析图像内容并以人类可以读懂的语句来反馈。

一、深度学习类型

传统分类图像的方法主要通过图像自身特性进行分类,实质是对图像分类基于特征的学习,其中重要的一步是特征提取。在此阶段,运用手动设计的算法,对图像的特定部分编码,比如形状、色彩、材质,用这些特征来评定图像内容。根据这些特征,进而用于训练网络及评估网络。而基于深度学习的分类不同,由监督学习、非监督学习及半监督学习组成。深度学习分类与传统分类的对比如图1所示。监督分类有个特点是要提前建立判别函数。监督学习运用较为广泛的一类。先给定计算机训练数据,创建一个训练集,此模型会对输入给它的数据进行预测,如果发现预测不恰当时,要及时纠正。不断迭代,直到达到某一个停止标准,比如错误率低于某个设定值,或者迭代次數超过某个设定值。常用方法包括K近邻法、马氏距离分

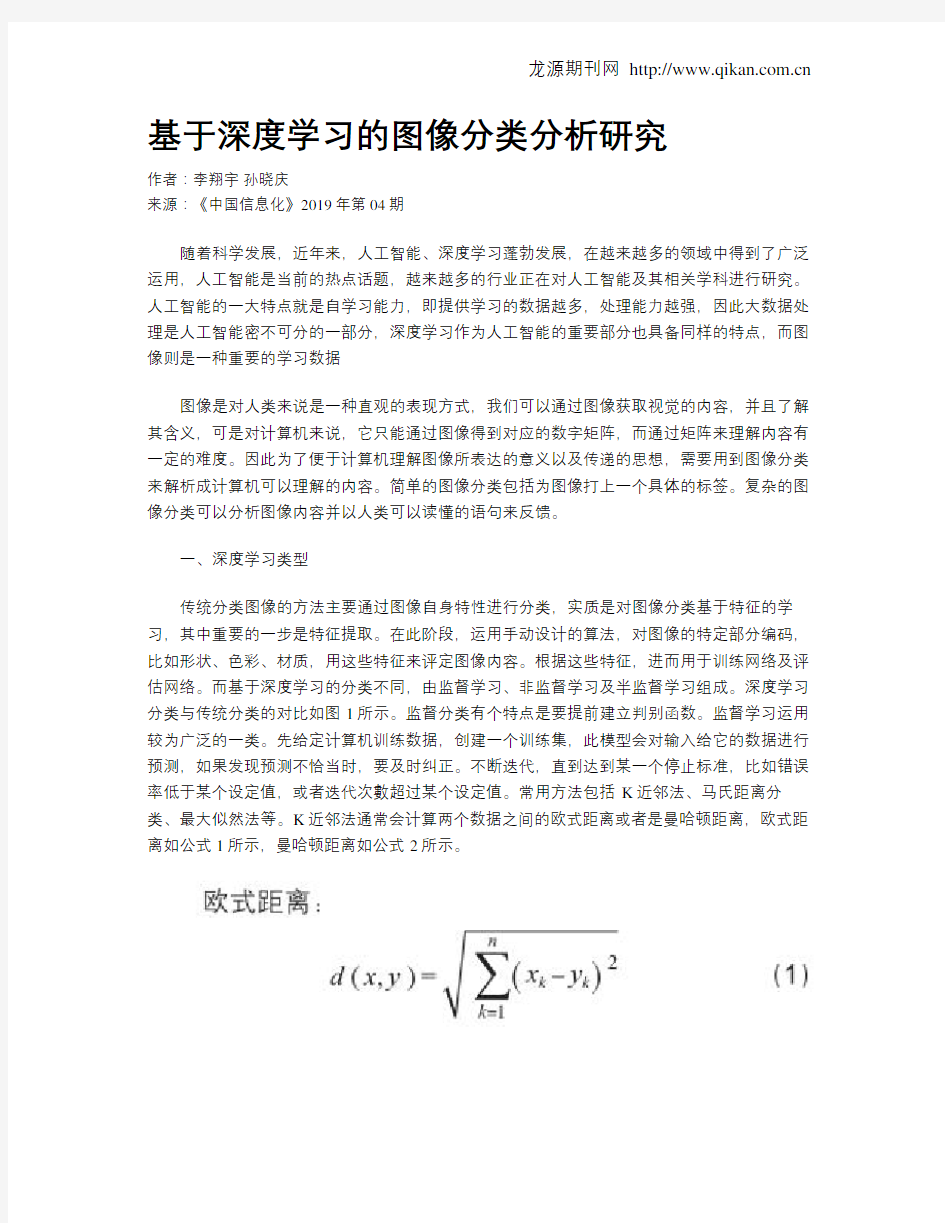

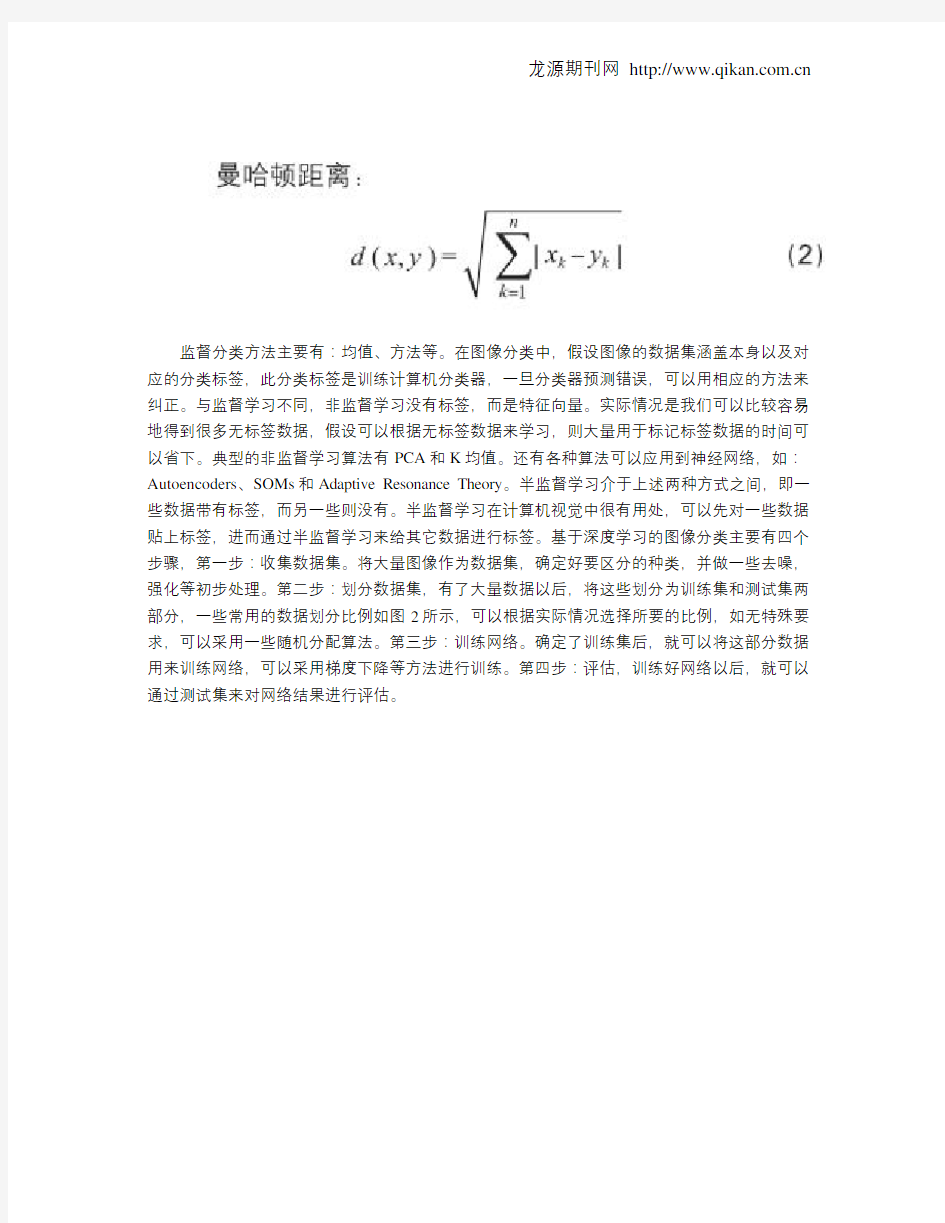

类、最大似然法等。K近邻法通常会计算两个数据之间的欧式距离或者是曼哈顿距离,欧式距离如公式1所示,曼哈顿距离如公式2所示。

本技术公开了一种基于深度图像的实时平面检测及提取的方法。本技术包括如下步骤:步骤1:对深度图像做预处理,并对深度图像提取区块信息;步骤2:对区块的几何参数分布做降维统计;步骤3:对估计的各个平面法向量查找平行平面;步骤4:平面参数优化。本技术根据深度图像的成像原理及平面结构的空间特性,使得计算机可以实时地通过深度图像获取环境中的平面结构信息,使得三维重建结果更加准确。从而准确高效地从深度图像中提取平面结构信息。 技术要求 1.一种基于深度图像的实时平面检测及提取的方法,其特征在于包括如下步骤: 步骤1:对深度图像做预处理,并对深度图像提取区块信息;

步骤2:对区块的几何参数分布做降维统计; 步骤3:对估计的各个平面法向量查找平行平面; 步骤4:平面参数优化。 2.根据权利要求1所述的一种基于深度图像的实时平面检测及提取的方法,其特征在于步骤1具体实现如下: 1-1.使用双边滤波算法对深度图像做滤波处理; 1-2.然后将深度图像划分为多个等大小矩形的区块; 1-3.将矩形区块中的像素反投影到三维空间中得到三维点云,提取区块的切平面信息,包括区块的空间坐标、切平面的法向量、切平面与原点的距离、区块置信度;记第(u,v)区块为patch(u,v)。 3.根据权利要求2所述的一种基于深度图像的实时平面检测及提取的方法,其特征在于步骤2具体实现如下: 2-1.将各个区块的法向量做球极映射从三维空间nx-ny-nz到二维平面Px-Py上; 2-2.对映射到二维平面Px-Py上的法向量点做栅格划分,并以高斯加权的方式对二维平面Px-Py上的法向量点做直方图统计,得到Px-Py直方图; 2-3.对Px-Py直方图查找8-领域极大值,并将对应点Px-Py坐标做球极逆映射得到估计的平面法向量参数。 4.根据权利要求3所述的一种基于深度图像的实时平面检测及提取的方法,其特征在于步骤3具体实现如下: 3-1.将所有区块的空间坐标与估计的平面法向量作内积,即将区块的空间坐标向法向量方向上做投影; 3-2.对投影得到的区块分布做直方图统计,并查找极大值,即得到该法向量上各个平行平面与原点的距离。

池河中学2017-2018学年度第一学期教学设计 年级8年级 科 目信息 技术 任课教师李瑞峰授课时间 1 课题图像的分辨率,图像的颜色深度授课类型新授 课标依据学习应用技能 ,提高信息素养,培养创新能力 《图像的分辨率,图像的颜色深度》属于初中信息技术课程第1章图形图像初步知识中的重要内容,本节课选用的教材是人民教育出版社出版的:《信息技术》八年级上册中的二节。主要是帮助学生掌握一些基本的概念,教会学生理解图像参数的方法。 教学目标知识与 技能 理解和掌握图像的分辨率,图像的颜色深度概念,并能理解二者对图像的影响。 过程与 方法 通过自学和讲解二个参数的特点,理解它们之间的联系与区别。 情感态 度与价 值观 激发并保持利用信息技术不断学习和探索的热情,形成积极主动地学习和使用信息技术、参与信息技术的 活动。 教学重点难点教学 重点 全面掌握图像的分辨率,图像的颜色深度概念。 编号:8.1.2

教学 难点 掌握图像的颜色深度。 教学过程设计 师生活动设计意图回想上节课的内容,我们学习了位图和矢量图, 在学习过程中我们也提到了像素,分辨率等概念, 今天我们要加深这几个概念的了解。 在照像机的参数中。像素是描述的数码相机的 主要参数,引出分辨率的概念。 任务一,阅读自学课本第二课,初步了解像素 和深度概念。 布置探究任务二,按课本要求查看图像素材文 件像素、存储容量、颜色位数。查看过程中理解分 辨率和文件大小及像素等概念。 发放相关知识材料教师对照讲解让学生理解分 辨率和像素的关系。 阶段性小结。图像分辨率则是单位英寸中所包 含的像素点数,辨率是图片清晰程度的标志。 显示分辨率与图像分辨率两个方向来分类 利用电脑的显示属性设置来自主探究“位深度” 的概念。 任务三,动手调整计算机的显示参数 教师提示:右键,分辨率,高级设置 阶段性小结 复习巩固旧 知识,引出 新知识。 以任务为驱 动开展教学 激发学生兴 趣;引导学 生发现问 题,并学会 分析问题。 学生动手进行 操作,在操作 中体会理解概 念

基于深度的图像修复实验报告

————————————————————————————————作者:————————————————————————————————日期: 2

基于深度的图像修复 一.实验目的 1、学会单幅图像的修补 2、学会结合彩色图像和深度图像的图像修补 二.实验原理 1图像修补简介----单幅图像修补 图像中常有缺失或者损坏的部分,即空白区域或者有误的区域。图像修补就是根据这些区域周围的信息完成对空白区域的填充,以实现图像的恢复。 基本方法 图像修补的基本方法示例

示例方法2 选取空白点周围的一片区域,对区域内的参考点进行加权求和,其结果用于对空白点的修补。若所选窗口太小,即窗口中无参考点,则将窗口扩大。 2图像修补简介----利用深度图的图像修补 1图像的前景与背景

实际场景中存在前景与背景的区别,前景会遮挡背景,而且前景与背景往往差距比较大。 2深度图 用于表示3D空间中的点与成像平面距离的灰度图。0~255表示,灰度值越大,表示场景距离成像平面越近,反之,灰度值越小,表示场景距离成像平面越远。 前景的灰度值大,背景的灰度值小。 如下左彩色图,右深度图 3普通的图像修补区分不了图像的前景和背景,简单的加权求和填补空白点的方法会导致前景和背景的混杂。引入深度图之后,可以利用深度图区分图像的前景和背景,在对背景进行修补的时候,可以利用深度图滤除那些前景参考点的影响,从而使背景的空白点只由背景点加权求和得到,前景亦然。

三.实验步骤 1读入一个像素点,判断其是否为空白点。 2若不是空白点,则跳过该点,判断下一个点。 3若该点是空白点,则用前面所述的方法进行加权修补。 4对图像中的每一个点都进行如此处理,直至全图处理完毕,则图像修补完成。 四.实验要求 1独立编码完成实验单幅图像修补利用深度图的图像修补。 2 比较实验结果的差别,并分析原因,完成实验报告。 五.用MATLAB编写实验代码 对于单幅图像以及结合深度图像的修补,其实区别就是是否考虑了深度图像的灰度权重(其实就是0和1),虽然效果图区别很小,但是通过深度图还是可以反映出其立体三维空间的。为了能较好的对比,我把两种方法的比较融合在一条件语句中,在下面的深度图像代码中用红色字体标注。同时深度图像变量用绿色字体标注。

基于深度图像技术的手势识别方法 曹雏清,李瑞峰,赵立军 (哈尔滨工业大学机器人技术与系统国家重点实验室,哈尔滨 150001) 摘 要:针对复杂环境下的手势识别问题,提出一种基于深度图像技术的手势识别方法。利用深度图像信息从复杂环境中提取手势区域,综合手势的表观特征,建立决策树实现手势的识别。对常见的9种手势在复杂背景条件下进行测试,实验结果表明,手势的平均识别率可达到98.4%,速度达到每秒25帧。 关键词:手势识别;深度图像;表观特征;复杂背景;决策树 Hand Posture Recognition Method Based on Depth Image Technoloy CAO Chu-qing, LI Rui-feng, ZHAO Li-jun (State Key Laboratory of Robotics and System, Harbin Institute of Technology, Harbin 150001, China) 【Abstract 】Aiming at the problem of hand posture recognition from complex backgrounds, this paper proposes a hand posture recognition method based on depth image technoloy. The hand posture region is extracted from complex background via depth image. Appearance features are integrated to build the decision tree for hand posture recognition. Nine common postures with complex background are tested. Experimental results demonstrate that recognition rate is 98.4% and speed rate achieves 25 frames per second. 【Key words 】hand posture recognition; depth image; appearance feature; complex background; decision tree DOI: 10.3969/j.issn.1000-3428.2012.08.006 计 算 机 工 程 Computer Engineering 第38卷 第 8期 V ol.38 No.8 2012年4月 April 2012 ·博士论文· 文章编号:1000—3428(2012)08—0016—03文献标识码:A 中图分类号:TP391 1 概述 随着机器人技术的发展,智能服务机器人开始逐步融入人类的生活,人机交互技术的发展是智能服务机器人研究的重要组成部分。人机交互的研究方向主要有表情、声音和手势识别技术。其中,手势是一种自然直观的人机交流模式,在信息表达上比表情更明确、信息量更丰富。 在人机交互中,基于视觉的手势识别是实现新一代人机交互的关键技术。基于视觉的手势识别通过图像信息,让机器人获取人的手势姿态信息,对不同的手势信息进行分类。近年来,学者们对基于视觉的手势识别进行研究,文献[1]提出特征空间匹配法,文献[2]采用提取同类手势的SIFT 特征方法进行手势识别,文献[3]提出手势图解析分类法,文献[4]针对复杂背景采用空间分布特征对手势进行识别。 复杂背景下手势识别的研究[4-5]一般使用肤色模型实现手势区域分割,虽然可以区分肤色和非肤色区域,但是实际应用中图像都包含有肢体和面部肤色区域,它们对手势区域提取有着较大的影响,同时光线也直接影响肤色模型。现有的文献中并没有考虑强光和弱光环境下的手势识别情况,在实际应用中往往伴随光线的变化问题,这些问题都直接影响了人机交互的实际效果。本文提出一种基于深度图像技术的手势识别方法,从深度图像信息中提取手势区域,运用几何方法提取手势表观特征并分类,从而实现复杂环境下基于手势的人机交互。 2 2.1 手势识别系统 基于深度图像信息的手势识别系统框架如图1所示。深度图像的采集采用非接触测量方式,获取的场景中深度信息不受物体自身的颜色、纹理特征以及背景环境光线强弱的影响。本文选用微软公司的Kinect 进行深度图像的采集,获取 深度信息值,转换到灰度值图像,经过手势区域分割、特征提取、手势识别,转换为手势信息,提供人机交互使用。 图1 面向人机交互的手势识别框架 2.2 手势区域分割 2.2.1 深度图像成像原理 深度图像技术在近年来逐步得到广泛的关注,Kinect 采集640×480像素的深度图像速度可以达到30 f/s ,深度的分辨率在5 mm 左右。本文把Kinect 采集到的场景深度值转换到灰度值空间,实际场景的RGB 图像如图2所示。在深度图像中像素点灰度值的大小对应于场景中点的不同深度值,如图3所示,图像中的灰度值越大,表明该区域距离深度摄像头的距离越近。 图2 场景RGB 图像 图3 深度图像 基金项目:国家自然科学基金资助项目(61075081);机器人技术与 系统国家重点实验室课题基金资助项目(SKLRS200802A02) 作者简介:曹雏清(1982-),男,博士研究生,主研方向:模式识 别,人机交互;李瑞峰,教授、博士生导师;赵立军,讲师 收稿日期:2011-07-11 E-mail :caochuqing@https://www.doczj.com/doc/dd12421287.html,

基于深度学习的图像识别 摘要:本文讨论了两种实现图像识别的深度学习(Deep Learning,DL)方法:卷积神经网络(Convolution Neural Network,CNN)与深度信念网络(Deep Belief Network,DBN)。 关键词:深度学习,卷积神经网络,深度信念网络 1前言 在计算机图像处理中,最困难但又最让人兴奋的任务就是让机器可以实现图像分类,从而通过图像识别物体的种类。 这项任务很难实现。在数据库中的图像总是在不同状态下记录的。这意味这光线与角度的多变性。 而可运用的计算能力的限制是一大障碍。我们不可能像让人类识别图像一样让机器识别图像。计算能力的限制导致可供训练与测试的数据有限,而模型的复杂程度也受到限制。 但是,目前这种情况得到极大的改善。综合多CPU/综合多GPU系统(multi-CPU/multi-GPU systems)使得运行高速神经网络成为现实,而费用也可以负担得起。人们对深度学习模型在图像识别与机器学习中的应用兴趣渐浓,而与之对抗的传统模型日渐式微。目前最具意义的研究方向就是运用深度学习模型,处理综合数据库中的图像识别问题。 本文主要关注深度神经网络(DNN)在图像识别在的作用。 深度神经系统主要有多层特征提取单元组成。低层特征提取单元提取了简单特征,之后依照该单元的规模进行学习,并按该单元的权重或参照物将特征反馈给高层特征提取单元。而高层特征提取单元可以提取更复杂的特征。 目前有一些实现深层学习网络的方法。深度信念网络(DBN)一个多层生成模型,而每一层都是一个统计编码器(statistical encoder)。这些统计编码器都是基于附属于它的更低层的结点(unit)。而这种训练主要关注训练数据中的最大化概率。 DBN在众多领域都有成功运用,如手写数据识别与人类手势识别。 另一个深度学习模型是卷积神经网络(CNN),与相似层次尺寸的标准化前向反馈网络不同,这个模型所需的连接与参照物比较少,使其训练也更简单。 层次深,规模大的DNN结构往往可以产生最好的结果。这意味这我们需要数量巨大的基础样本与种类丰富的训练样本,以确保面对状况多变的数据时,我们的训练数据仍代表性。 2 模型介绍 人类的视觉系统可以在多种情况下高效识别物体,而对计算机算法,这个任务并不简单。 深度神经网络便是模拟哺乳动物视觉网络。这已被验证为这项任务的最佳实现方案。目前,有人已运用这种模型,设计出识别准确性可能高于人类的机器图像识别系统。 2.1 卷积神经网络(CNN) 卷积神经网络系统(CNNs)是专注处理图案识别的多层网络系统。它是多层感知器(Multi-Layer Percentrons,MLPs)的变体,灵感来自于生物系统。 CNNs是分层型(hierarchical)神经网络。通过运用卷积计算(convolution)将集成层(pooling layers)交织起来,CNNs可以实现特征信息的自动提取,形成可完成最终分类的一系列全连接的网络层次。 卷积神经网络 结构:输入,卷积,深层取样(sub-sampling)/总集成与分类层(max-pooling and classification layers) 2.1.1 卷积层(Convolution layer) 卷积成通常可由特征图(feature map)的数目,核(kernel)的大小(sizes),与先前层的联系来展现。 每一层都包含了相同维度的特征图M,如 ) , ( y x M M;这些特征图可以通过先前层的一系列卷积运算得到。而在这些运算中,它们之间有相互关

遥感图像分类方法的国内外研究现状与发展趋势

遥感图像分类方法的研究现状与发展趋势 摘要:遥感在中国已经取得了世界级的成果和发展,被广泛应用于国民经济发展的各个方面,如土地资源调查和管理、农作物估产、地质勘查、海洋环境监测、灾害监测、全球变化研究等,形成了适合中国国情的技术发展和应用推广模式。随着遥感数据获取手段的加强,需要处理的遥感信息量急剧增加。在这种情况下,如何满足应用人员对于大区域遥感资料进行快速处理与分析的要求,正成为遥感信息处理面临的一大难题。这里涉及二个方面,一是遥感图像处理本身技术的开发,二是遥感与地理信息系统的结合,归结起来,最迫切需要解决的问题是如何提高遥感图像分类精度,这是解决大区域资源环境遥感快速调查与制图的关键。 关键词:遥感图像、发展、分类、计算机 一、遥感技术的发展现状 遥感技术正在进入一个能够快速准确地提供多种对地观测海量数据及应用研究的新阶段,它在近一二十年内得到了飞速发展,目前又将达到一个新的高潮。这种发展主要表现在以下4个方面: 1. 多分辨率多遥感平台并存。空间分辨率、时间分辨率及光谱分辨率普遍提高目前,国际上已拥有十几种不同用途的地球观测卫星系统,并拥有全色0.8~5m、多光谱3.3~30m的多种空间分辨率。遥感平台和传感器已从过去的单一型向多样化发展,并能在不同平台

上获得不同空间分辨率、时间分辨率和光谱分辨率的遥感影像。民用遥感影像的空间分辨率达到米级,光谱分辨率达到纳米级,波段数已增加到数十甚至数百个,重复周期达到几天甚至十几个小时。例如,美国的商业卫星ORBVIEW可获取lm空间分辨率的图像,通过任意方向旋转可获得同轨和异轨的高分辨率立体图像;美国EOS卫星上的MOiDIS-N传感器具有35个波段;美国NOAA的一颗卫星每天可对地面同一地区进行两次观测。随着遥感应用领域对高分辨率遥感数据需求的增加及高新技术自身不断的发展,各类遥感分辨率的提高成为普遍发展趋势。 2. 微波遥感、高光谱遥感迅速发展微波遥感技术是近十几年发展起来的具有良好应用前景的主动式探测方法。微波具有穿透性强、不受天气影响的特性,可全天时、全天候工作。微波遥感采用多极化、多波段及多工作模式,形成多级分辨率影像序列,以提供从粗到细的对地观测数据源。成像雷达、激光雷达等的发展,越来越引起人们的关注。例如,美国实施的航天飞机雷达地形测绘计划即采用雷达干涉测量技术,在一架航天飞机上安装了两个雷达天线,对同一地区一次获取两幅图像,然后通过影像精匹配、相位差解算、高程计算等步骤得到被观测地区的高程数据。高光谱遥感的出现和发展是遥感技术的一场革命。它使本来在宽波段遥感中不可探测的物质,在高光谱遥感中能被探测。高光谱遥感的发展,从研制第一代航空成像光谱仪算起已有二十多年的历史,并受到世界各国遥感科学家的普遍关注。但长期以来,高光谱遥感一直处在以航空为基础的研究发展阶段,且主要

龙源期刊网 https://www.doczj.com/doc/dd12421287.html, 基于深度图像技术的手势识别方法 作者:付学娜 来源:《电子技术与软件工程》2015年第04期 所谓手势是指人手或手臂同人手结合而产生的动作或姿势,作为人机交互的一项重要技术,手势识别通过在人手安置相关的硬件设备,并通过硬件设备中的计算模块对人手的位置和速度等信息进行获取,对于识别过程中的定位和跟踪均都具有良好的指导和保障作用。本文通过对手势识别系统与深度图像的成像原理进行阐述,进而结合手势区域分割的相关理论,对基于深度图像技术的手势识别方法展开了深入研究。 【关键词】深度图像技术手势识别圆形轨迹像素值变化点 随着科技的不断发展,基于视觉的手势识别已成为新一代人机交互中的核心技术。在借助相关图像信息的基础上,计算机可以对人手的各种姿态信息以及不同的手势信息尽心准确识别,有效提高了识别的速度与质量。本文以基于深度图像技术的手势识别作为研究对象,通过对手势识别系统及深度图像成像原理进行分析,从手势区域分割以及手势特征提取两方面出发,对深度图像技术下手势识别的方法做出了详细分析。 1 手势识别系统与深度图像成像原理 基于深度图像技术的手势识别系统主要包括了手势、深度图像、手势区域分割、手势特征提取以及手势识别和人机交互等,深度图像以非接触测量的方式对场景中的深度信息进行采集,而所采集的深度信息具有较强的稳定性和可靠性,即不受物体(人手)自身颜色、背景环境和纹理特征等因素的影响。本文以微软的Kinect作为图像采集和获取深度信息的工具,进而对手势识别展开分析。 基于Kinect下的深度图像技术下所采集的640×480深度图像信息的速度可达30f/s,且信息的分辨率维持在5mm左右,在应用方面具有较强的合理性。通过在相关场景采集的场景深度值进行转换,使其转移到灰度值空间,并使深度图像中所有的像素点灰度值大小与实际场景中不同的深度值相对应,进而显示成像。值得注意的是品拍摄区域与深度摄像头之间的距离与图像中的灰度值呈现出明显的负相关关系,即灰度值越大,距离越近。 2 基于深度图像技术的手势识别 2.1 手势区域分割 虽然具有相同深度的像素点,其在深度图像中所具有的灰度值也具有较高的一致性,但由于在每次对人手手势进行拍摄时,人手同深度摄像头间的距离存在差异。因此,无法利用单一的固定阈值对手势区域进行分割,故本文以灰度值直方图作为主要研究方法,进而确定出相关背景及手势区域分割的阈值。由于人手做出相关姿势的区域距离深度摄像头较近,且相对于整

第2期,总第64期国 土 资 源 遥 感No.2,2005 2005年6月15日RE MOTE SENSI N G F OR LAND&RES OURCES Jun.,2005 遥感图像分类方法研究综述 李石华1,王金亮1,毕艳1,2,陈姚1,朱妙园1,杨帅3,朱佳1 (1.云南师范大学旅游与地理科学学院,昆明 650092;2.云南省寄生虫病防治所,思茅 665000; 3.云南开远市第一中学,开远 661600) 摘要:综述了遥感图像监督分类和非监督分类中的各种方法,介绍了各种方法的优缺点、适用领域和应用情况,并作了简单评述,最后,展望了遥感图像分类方法研究发展方向和研究热点。 关键词:遥感;图像分类;分类方法 中图分类号:TP751 文献标识码:A 文章编号:1001-070X(2005)02-0001-06 0 引言 随着卫星遥感和航空遥感图像分辨率的不断提 高,人们可以从遥感图像中获得更多有用的数据和 信息。由于不同领域遥感图像的应用对遥感图像处 理提出了不同的要求,所以图像处理中重要的环 节———图像分类也就显得尤为重要,经过多年的努 力,形成了许多分类方法和算法。本文较全面地综 述了这些分类方法和算法,为遥感图像分类提供理 论指导。 1 遥感图像分类研究现状 在目前遥感分类应用中,用得较多的是传统的 模式识别分类方法,诸如最小距离法、平行六面体 法、最大似然法、等混合距离法(I S OM I X)、循环集群 法(I S ODAT A)等监督与非监督分类法。其分类结果 由于遥感图像本身的空间分辨率以及“同物异谱”、 “异物同谱”现象的存在,往往出现较多的错分、漏分 现象,导致分类精度不高[1]。随着遥感应用技术的 发展,傅肃性等对P.V.Balstad(1986)利用神经网络 进行遥感影像分类的研究情况以及章杨清等在利用 分维向量改进神经网络在遥感模式识别中的分类精 度问题作了阐述[2], 孙家对M.A.Friedl(1992)和 C.E.B r odley(1996)研究的大量适用于遥感图像分类的决策树结构作了阐述[3],尤其是近年来针对高光谱数据的广泛应用,各种新理论新方法相继涌现,对传统计算机分类方法提出了新的要求[4,5]。 2 基于统计分析的遥感图像分类方法 2.1 监督分类 监督分类是一种常用的精度较高的统计判决分类,在已知类别的训练场地上提取各类训练样本,通过选择特征变量、确定判别函数或判别规则,从而把图像中的各个像元点划归到各个给定类的分类方法[2,3,6,7]。常用的监督分类方法有:K邻近法(K-Nearest Neighbor)、决策树法(Decisi on Tree Classifi2 er)和贝叶斯分类法(Bayesian Classifier)。主要步骤包括:①选择特征波段;②选择训练区;③选择或构造训练分类器;④对分类精度进行评价。 最大似然分类法(MLC)是遥感分类的主要手段之一。其分类器被认为是一种稳定性、鲁棒性好的分类器[8]。但是,如果图像数据在特征空间中分布比较复杂、离散,或采集的训练样本不够充分、不具代表性,通过直接手段来估计最大似然函数的参数,就有可能造成与实际分布的较大偏差,导致分类结果精度下降。为此,不少学者提出了最大似然分类器和神经网络分类器。改进的最大似然分类器多采用Gauss光谱模型作为条件概率密度函数模型,其中最简单的是各类先验概率相等的分类器(即通常所说的最大似然分类器),复杂的有Ediri w ickre ma等提出的启发式像素分类估计先验概率法。Mclachlang J 收稿日期:2004-11-23;修订日期:2005-03-15 基金项目:国家重点基础研究发展计划(973计划)项目(2003CB41505-11)、国家自然科学基金项目(40361007)和云南省自然科学基金项目(2002D0036M和2003C0030Q)资助。

基于图像的绘制技术综述 摘要: 基于图像的绘制技术(Image-based Rendering,IBR)近年来引起广泛的关注,目前的基于图像的绘制技术(IBR)可以根据他们依赖场景几何信息的程度分为三类:无几何信息的IBR 绘制、部分几何信息的IBR 绘制和全部几何信息的IBR 绘制。通过对三类技术特征及其数学描述的讨论,从中得出结论:在IBR 技术中图像和几何信息的双重应用表明IBR 和传统的基于三维几何的图形学可以统一成一个有机整体。 1 引言 由于基于图像的绘制技术(Image-Based Rendering)在从电影特效(The"Matrix")到大场景虚拟漫游、远程现实等方面的广泛应用,其发展非常迅速,相继出现了一系列高效的技术方法。和传统的基于模型的绘制相比,基于图像的绘制有如下的优点:图形绘制独立于场景复杂性,仅与所要生成画面的分辨率有关;预先存储的图像(或环境映照) 既可以是计算机合成的,也可以是实际拍摄的画面,两者也可以混合使用;算法对计算资源的要求不高,可以在普通工作站和个人计算机上实现复杂场景的实时显示。 本文把IBR 技术分成无几何信息的绘制、基于部分几何信息的绘制和基于完全几何信息的绘制三类[1]。由于各种绘制技术和方法是相互关联的统一体,而不是完全彼此脱离的,所以分类界限并不是十分的严格,如图1 示。从近几年研究的侧重点和成果显示来看,目前越来越多的研究集中于图像和几何信息之间相结合的方法,这样能使绘制效果更加完美逼真。 2 无几何信息的IBR 绘制 无几何信息的IBR 绘制方法都是基于全光函数及其变形的。早期的全光函数(PlenOptic Function)是由Adelson 和Bergen 命名的,简单的讲它描述了构成场景的所有可能的环境映照(Environment map)。若记录光线的照相机的位置为(Vx,Vy,Vz),光线的方向为(θ,Ф),光波波长为λ,光强随时间t 变化,则全光函数可以表示为: P7=P(Vx,Vy,Vz,θ,Ф,λ,t) 在上式中,场景内的所有光线构成了一个全光函数。基于此,IBR 技术可以归结为以离散的样本图。 像重构连续的全光函数的过程,即采样、重建和重采样过程。表1 给出了在各种对视域假定和限制情况下7D 的全光函数被简化为从6D 到2D的各种形式,以及一些文中提到的有代表性表示方法。 2.1 全光模型(PlenOptic Modeling) McMillian 和Bishop 在文献[7]中对全光函数做了简化,假设场景的光波不变,且场景不随时间发生变化,则可以忽略场景的波长λ和时间参数t,全光函数从而简化为5 维函数,即: P5=P(Vx,Vy,Vz,θ,Ф) 这是一个柱面全景图的集合,这种表示在所有五维上都存在大量的冗余,而且方法中没有解决立体对应的问题。有关5D 全光函数其他的应用实例可见文献[2]

图像深度与颜色类型 2011-09-07 17:06:44| 分类:图像处理| 标签:|举报|字号大中小订阅四.图像深度与颜色类型< XMLNAMESPACE PREFIX ="O" /> 图像深度是指位图中记录每个像素点所占的位数,它决定了彩色图像中可出现的最多颜色数,或者灰度图像中的最大灰度等级数。图像的颜色需用三维空间来表示,如RGB颜色空间,而颜色的空间表示法又不是惟一的,所以每个像素点的图像深度的分配还与图像所用的颜色空间有关。以最常用的RGB颜色空间为例,图像深度与颜色的映射关系主要有真彩色、伪彩色和直接色。 (一)真彩色(true-color):真彩色是指图像中的每个像素值都分成R、G、B三个基色分量,每个基色分量直接决定其基色的强度,这样产生的颜色称为真彩色。例如图像深度为24,用R:G:B=8:8:8来表示颜色,则R、G、B各用8位来表示各自基色分量的强度,每个基色分量的强度等级为28=256种。图像可容纳224=16M 种颜色。这样得到的颜色可以反映原图的真实颜色,故称真彩色。 (二)伪彩色(pseudo-color):伪彩色图像的每个像素值实际上是一个索引值或代码,该代码值作为颜色查找表(CLUT,Color Look-Up Table)中某一项的入口地址,根据该地址可查找出包含实际R、G、B的强度值。这种用查找映射的方法产生的颜色称为伪彩色。用这种方式产生的颜色本身是真的,不过它不一定反映原图的颜色。在VGA显示系统中,调色板就相当于颜色查找表。从16色标准VGA调色板的定义可以看出这种伪彩色的工作方式(表06-03-2)。调色板的代码对应RGB颜色的入口地址,颜色即调色板中RGB混合后对应的颜色。 表06-03-216色标准VGA调色板

第8章基于图像的绘制 浙江大学CAD&CG国家重点实验室 秦学英 2004年9月

概述 基于图像的绘制,其优势在于计算的绘制量是与像素成正比,而不是与几何模型的顶点数相关。这样,对复杂场景会很有效 8.1 绘制谱 8.2 算法综述 8.3 布告板技术 8.4 透镜眩光和敷霜效果 8.5 粒子系统 8.6 深度精灵 8.7 层次图像缓存 8.8 全屏布告板技术 8.9 天空体 8.10 固定视点效果 8.11 图像处理 8.12 体绘制技术

绘制谱Rendering Spetrum Survey of IBR: 沈向洋 实时绘制的一个重要原则是,尽量多的预计算。比如辐射度。基于物体表示来说,基于图像的绘制,其基本思想是用图像来代替几帧画面中的物体

8.2 算法综述 精灵(Sprite) :是一个带有透明度的、可在屏幕上任意移动的图像 精灵的连续画面生成的动画 精灵也可用于不同方式生成的billboard 甚至传统的二维应用也开始用三维的精灵于固定视域的游戏

图中,景物的深度排序在一个相当长的时间段中是保持的,因此,赋予每个子图以顺序,由后向前画,便可节省资源。即画家算法。 但是当视点改动或景物移动后,原来的长方形可能映射到一个四边形上,其变形可能越来越严重。这样就要求重新生成图像Sprite。何时映射合重新生成图像是IBR最困难的方面之一。另外,镜面高光和阴影增加了难度。 Talisman architexture [46,752] Sprite Layer

这些层组成的场景,由于texture mapping的便利性,映射和再生成这些层相对来说比绘制这些物体要简单得多。每个层可以独立地管理。具体讨论见[485] 穿插图像需要特别处理[724] 单纯的图像层(image layer)绘制依赖于快速、高画质图像映射、过滤以及合成 其实,IBR也可以与基于多边形绘制相结合 Quick Time VR Lumigraph/Light field rendering[282,490] SkyBoxing: 6个面的全景视图

基于深度学习的图像深度估计及其应用研究场景深度估计是计算机视觉领域的一项重要课题。利用图像的深度信息,可以重构场景的三维结构信息,对机器人自主导航、物体识别与抓取等任务具有重要意义。 传统的视觉深度估计方法多利用场景的多视信息,通过三角几何对应关系从二维图像中恢复场景深度,计算量大且复杂。近年,随着深度学习的发展,利用卷积神经网络重构场景深度成为研究者关注的热点方向。 卷积神经网络可以利用图像数据及其配套的基准深度数据预先训练学习,在测试阶段可以实现端到端的全分辨率图像深度估计。该方法不仅速度快,实现简单,而且可实现场景的尺度恢复,有益于机器人的空间任务执行。 在此背景下,本文在深入研究近年基于卷积神经网络的深度估计方法基础上,提出创新性的端到端深度学习网络,实验证明所提方法可进一步提升算法性能。本文首先提出了一种端到端的学习方案,用于从稀疏深度图和RGB图像中预测尺度化的稠密深度图。 该方案中,首先利用稀疏采样生成稀疏深度图,然后将彩色图像和稀疏深度图作为网络输入,输出全分辨率深度图像。在训练过程中,稀疏深度图作为深度估计网络的监督信号来恢复场景的真实尺度。 为了更精确的估计场景深度,本文引入“correlation”层,人工模拟标准匹配过程来融合稀疏深度信息和彩色图像信息,即使用颜色信息来帮助提高基于稀疏深度图的预测精度。最后,利用精细化模块以全分辨率输出场景深度图像。 在NYU-Depth-V2和KITTI数据集上的实验结果表明,与前沿算法相比,该模型能够以全分辨率恢复尺度化的场景深度,具有更优的性能。本文提出了并行构

建的深度估计网络和相机位姿估计网络。 相机位姿估计网络以单目视频序列为输入,输出六自由度的相机相对位姿。深度估计网络以单目目标视图为输入,生成稠密的场景深度。 最后基于相机模型,生成合成视图,并把它作为监督信号联合训练两个并行的估计网络。与此同时,稀疏采样生成的稀疏深度图作为深度估计网络的另一个监督信号,帮助恢复其全局尺度。 深度估计网络获得的尺度信息又通过合成视图与目标视图的光度误差耦合传递给位姿估计网络。在测试阶段,深度估计器和位姿估计器可以分别独立的使用。 在KITTI数据集上对本文算法进行了实验评估,所提算法在多个指标上优于前沿算法。

遥感图像分类方法综述 刘佳馨 摘要:伴随着科学技术在我们的生活中不断发展,遥感技术便应运而生,而遥感图像因成为遥感技术分析中的不可缺少的依据,变得备受关注。在本文中,以遥感图像分类方法为研究中心,从传统分类方法、近代分类方法两个方面对分类方法进行了介绍,并以此为基础对分类思想及后续处理进行说明,进而展望了遥感图像分类的研究趋势和发展前景。 关键词:遥感图像;图像分类;分类方法 1 引言 遥感,作为采集地球数据及其变化信息的重要技术手段,在世界范围内的各个国家以及我国的许多部门、科研单位和公司等,例如地质、水体、植被、土壤等多个方面,得到广泛的应用,尤其在监视观测天气状况、探测自然灾害、环境污染甚至军事目标等方面有着广泛的应用前景。伴随研究的深入,获取遥感数据的方式逐渐具有可利用方法多、探测范围广、获取速度快、周期短、使用时受限条件少、获取信息量大等特点。遥感图像的分类就是对遥感图像上关于地球表面及其环境的信息进行识别后分类,来识别图像信息中所对应的实际地物,从而进一步达到提取所需地物信息的目的。 2 遥感图像分类基本原理 遥感是一种应用探测仪器,在不与探测目标接触的情况下,从远处把目标的电磁波特性记录下来,并且通过各种方法的分析,揭示出物体的特征性质及其变化的综合性探测技术。图像分类的目的在于将图像中每个像元根据其不同波段的光谱亮度、空间结构特征或其他信息,按照某种规则或算法划分为不同的类别。而遥感图像分类则是利用计算机技术来模拟人类的识别功能,对地球表面及其环境在遥感图像上的信息进行属性的自动判别和分类,以达到提取所需地物信息的目的。 3 遥感图像传统分类方法 遥感图像传统分类方法是目前应用较多,并且发展较为成熟的分类方法。从分类前是否需要获得训练样区类别这一角度进行划分,可将遥感图像传统分类方法分为两大类,即监督分类(supervised classification)和非监督分类(Unsupervised

1. 图像处理的主要方法分几大类? 答:图字图像处理方法分为大两类:空间域处理(空域法)和变换域处理(频域 法)。 空域法:直接对获取的数字图像进行处理。 频域法:对先对获取的数字图像进行正交变换,得到变换系数阵列,然后再进行 处理,最后再逆变换到空间域,得到图像的处理结果 2. 图像处理的主要内容是什么? 答:图形数字化(图像获取):把连续图像用一组数字表示,便于用计算机分析 处理。图像变换:对图像进行正交变换,以便进行处理。图像增强:对图像的某 些特征进行强调或锐化而不增加图像的相关数据。图像复原:去除图像中的噪声 干扰和模糊,恢复图像的客观面目。图像编码:在满足一定的图形质量要求下对 图像进行编码,可以压缩表示图像的数据。图像分析:对图像中感兴趣的目标进 行检测和测量,从而获得所需的客观信息。图像识别:找到图像的特征,以便进 一步处理。图像理解:在图像分析的基础上得出对图像内容含义的理解及解释, 从而指导和规划行为。 3. 名词解释:灰度、像素、图像分辨率、图像深度、图像数据量。 答:灰度:使用黑色调表示物体,即用黑色为基准色,不同的饱和度的黑色来显示 图像.像素:在卫星图像上,由卫星传感器记录下的最小的分立要素(有空间分量 和谱分量两种)。通常,表示图像的二维数组是连续的,将连续参数 x,y ,和 f 取 离散值后,图像被分割成很多小的网格,每个网格即为像素 图像分辨率:指对 原始图像的采样分辨率,即图像水平或垂直方向单位长度上所包含的采样点数。 单位是“像素点/单位长度”图像深度是指存储每个像素所用的位数,也用于量度 图像的色彩分辨率.图像深度确定彩色图像的每个像素可能有的颜色数,或者确 定灰度图像的每个像素可能有的灰度级数.它决定了彩色图像中可出现的最多颜 色数,或灰度图像中的最大灰度等级(图像深度:位图图像中,各像素点的亮度 或色彩信息用二进制数位来表示,这一数据位的位数即为像素深度,也叫图像深 度。图像深度越深,能够表现的颜色数量越多,图像的色彩也越丰富。) 图像数据量:图像数据量是一幅图像的总像素点数目与每个像素点所需字节数的 乘积。 4. 什么是采样与量化? 答:扫描:按照一定的先后顺序对图像进行遍历的过程。采样:将空间上连续的 图像变成离散点的操作。采样过程即可看作将图像平面划分成网格的过程。量化: 将采样得到的灰度值转换为离散的整数值。灰度级:一幅图像中不同灰度值的个 数。一般取0~255,即256个灰度级 5.说明图像函数 的各个参数的具体含义。 答:其中,x 、y 、z 是空间坐标,λ是波长,t 是时间,I 是像素点的强度。它 表示活动的、彩色的、三维的视频图像。对于静止图像,则与时间t 无关;对于 单色图像,则波长λ为常数;对于平面图像,则与坐标z 无关。 6、请解释马赫带效应,马赫带效应和同时对比度反映了什么共同的问题? 答:马赫带效应:基于视觉系统有趋向于过高或过低估计不同亮度区域边界值的 现象。同时对比度现象:此现象表明人眼对某个区域感觉到的亮度不仅仅依赖它 的强度,而与环境亮度有关 共同点: 它们都反映了人类视觉感知的主观亮度并不是物体表面照度的简单函 数。 ) ,,,,(t z y x f I λ=

SVM分类方法在人脸图像分类中的应用 摘要:本文首先简要综述了人脸识别技术中不同的特征提取方法和分类方法;然后介绍了支持向量机(SVM)的原理、核函数类型选择以及核参数选择原则以及其在人脸分类识别中了应用,最后通过在构建的人脸库上的仿真实验观测观测不同的特征提取方法对人脸识别率的影响、不同的学习样本数对人脸识别率的影响、支持向量机选用不同的核函数后对人脸识别率的影响、支持向量机选用不同的核参数后对人脸识别率的影响。 一、人脸识别简介 人脸识别也就是利用计算机分析人脸图象,进而从中提取出有效的识别信息,用来“辨认”身份的一门技术。人脸识别技术应用背景广泛,可用于公安系统的罪犯身份识别、驾驶执照及护照等与实际持证人的核对、银行及海关的监控系统及自动门卫系统等。 常见的人脸识别方法包括基于KL变换的特征脸识别、基于形状和灰度分离的可变形模型识别、基于小波特征的弹性匹配、基于传统的部件建模识别、基于神经网络的识别、基于支持向量机的识别等。其中特征脸方法、神经网络方法、基于支持向量机的方法等是基于整体人脸的识别,而基于提取眼睛等部件特征而形成特征向量的方法就是基于人脸特征的识别。 虽然人类的人脸识别能力很强,能够记住并辨别上千个不同人脸,可是计算机则困难多了。其表现在:人脸表情丰富;人脸随年龄增长而变化;人脸所成图象受光照、成象角度及成象距离等影响;而且从二维图象重建三维人脸是病态过程,目前尚没有很好的描述人脸的三维模型。另外,人脸识别还涉及到图象处理、计算机视觉、模式识别以及神经网络等学科,也和人脑的认识程度紧密相关。这诸多因素使得人脸识别成为一项极富挑战性的课题。 通常人类进行人脸识别依靠的感觉器官包括视觉、听觉、嗅觉与触觉等。一般人脸的识别可以用单个感官完成,也可以是多感官相配合来存储和检索人脸。而计算机的人脸识别所利用的则主要是视觉数据。另外计算机人脸识别的进展还受限于对人类本身识别系统的认识程度。研究表明,人类视觉数据的处理是一个

模式识别及其在图像处理中的应用 摘要:随着计算机和人工智能技术的发展,模式识别在图像处理中的应用日益广泛。综述了模式识别在图像处理中特征提取、主要的识别方法(统计决策法、句法识别、模糊识别、神经网络)及其存在的问题,并且对近年来模式识别的新进展——支持向量机与仿生模式识别做了分析和总结,最后讨论了模式识别亟待解决的问题并对其发展进行了展望。 关键词:模式识别;图像处理;特征提取;识别方法

模式识别诞生于20世纪20年代,随着计算机的出现和人工智能的发展,模式识别在60年代初迅速发展成一门学科。它所研究的理论和方法在很多学科和领域中得到广泛的重视,推动了人工智能系统的发展,扩大了计算机应用的可能性。图像处理就是模式识别方法的一个重要领域,目前广泛应用的文字识别( MNO)就是模式识别在图像处理中的一个典型应用。 1.模式识别的基本框架 模式识别在不同的文献中给出的定义不同。一般认为,模式是通过对具体的事物进行观测所得到的具有时间与空间分布的信息,模式所属的类别或同一类中模式的总体称为模式类,其中个别具体的模式往往称为样本。模式识别就是研究通过计算机自动地(或者人为进行少量干预)将待识别的模式分配到各个模式类中的技术。模式识别的基本框架如图1所示。 根据有无标准样本,模式识别可分为监督识别方法和非监督识别方法。监督识别方法是在已知训练样本所属类别的条件下设计分类器,通过该分类器对待识样本进行识别的方法。如图1,标准样本集中的样本经过预处理、选择与提取特征后设计分类器,分类器的性能与样本集的大小、分布等有关。待检样本经过预处理、选择与提取特征后进入分类器,得到分类结果或识别结果。非监督模式识别方法是在没有样本所属类别信息的情况下直接根据某种规则进行分类决策。应用于图像处理中的模式识别方法大多为有监督模式识别法,例如人脸检测、车牌识别等。无监督的模式识别方法主要用于图像分割、图像压缩、遥感图像的识别等。