CMOS图像传感器芯片OV5017及其应用

1 CMOS图像传感器的一般特征

目前,CCD(电荷耦合器件)是主要的实用化固态图像传感器件,它具有读取噪声低、动态范围大、响应灵敏度高等优点。但CCD技术难以与主流的CMOS技术集成于同一芯片之中。这样,诸如定时产生、驱动放大、自动曝光控制、模数转换及信号处理等支持电路就不能与像素阵列做同一芯片上,以CCD为基础的图像传感器难以实现单片一体化,因而具有体积大、功耗高等缺点。

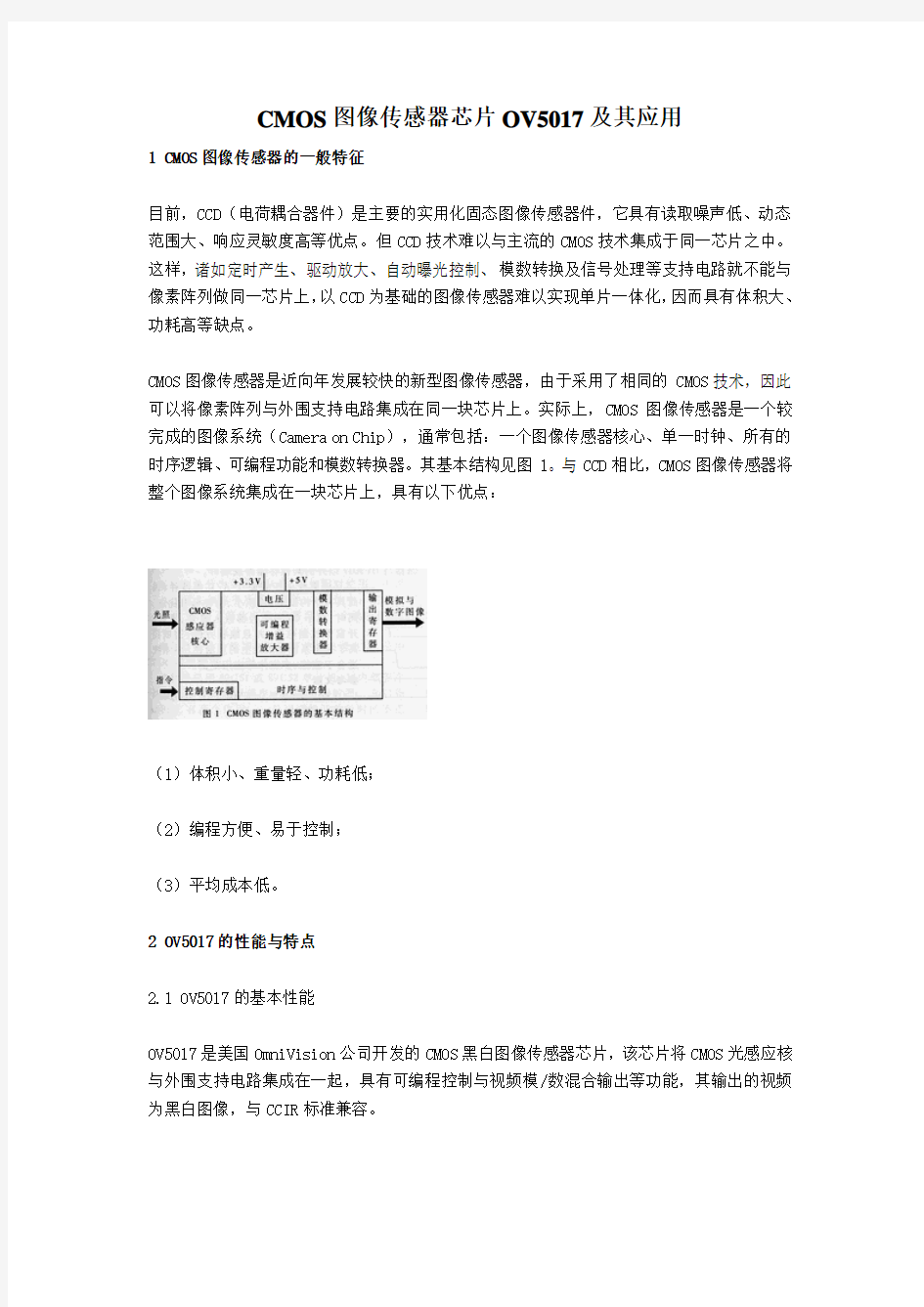

CMOS图像传感器是近向年发展较快的新型图像传感器,由于采用了相同的CMOS技术,因此可以将像素阵列与外围支持电路集成在同一块芯片上。实际上,CMOS图像传感器是一个较完成的图像系统(Camera on Chip),通常包括:一个图像传感器核心、单一时钟、所有的时序逻辑、可编程功能和模数转换器。其基本结构见图1。与CCD相比,CMOS图像传感器将整个图像系统集成在一块芯片上,具有以下优点:

(1)体积小、重量轻、功耗低;

(2)编程方便、易于控制;

(3)平均成本低。

2 OV5017的性能与特点

2.1 OV5017的基本性能

OV5017是美国OmniVision公司开发的CMOS黑白图像传感器芯片,该芯片将CMOS光感应核与外围支持电路集成在一起,具有可编程控制与视频模/数混合输出等功能,其输出的视频为黑白图像,与CCIR标准兼容。

OV5017芯片的基本参数为:

(1)图像尺寸4.2mm×3.2mm,像素尺寸11μm×11μm;

(2)信噪比SNR>42dB;

(3)帧频50时,最小照度为0.5lux@f1.4;

(4)帧频50时,峰值功耗小于100mW。

OV5017输出模拟视频信号,格式为逐行扫描。OV5017内部嵌入了一个8bit的A/D,因而可以同步输出8位的数字视频流D[7…0]。在输出数字视频流的同时,还提供像素时钟PCLK、水平参考信号HREF、垂直同步信号VSYNC,便于外部电路读取图像。

OV5017的像素阵列为384×288,分为16×16的子块,每个子块大小为24×18,可以在整个图像的局部开窗,输出窗口中的图像。

2.2 OV5017的编程功能

OV5017具有丰富的编程控制功能,其图像帧频、曝光时间、增益控制、Gamma校正、图像开窗等均可通过对芯片内部寄存器的读写进行设置,数字视频流的输出也必须通过对寄存器读取才能实现。

芯片内部有11个8位寄存器,通过对地址线A[3..0]的设置来选择寄存器,通过读写数据线[7..0]来读取或设置寄存器。在对寄存器进行读(或写)

时,应使片选CSB与输出使能OEB(或定使能WEB)有效。

地址号10xx的寄存器为视频数据端口,它是只读的,当选中并读取它时,芯片向外输出数

据视频流。

地址号0000的寄存器为状态寄存器,它是只读的,反映芯片的某些状态。

地址号0001的寄存器为帧控制寄存器,它是只写的,用于控制帧与行的同步信号。

地址号0010的寄存器为曝光控制寄存器,它是读写的,可选择自动曝光,也可选择手工曝光。曝光时间控制在1帧至1/100帧之间。

地址号0011的寄存器为增益控制寄存器,它是读写的,当手工曝光时,增益控制在0~18dB 之间。

地址号0100的寄存器为帧频控制寄存器,它是读写的,帧频控制在50~0.5fps之间。

地址号0101的寄存器为杂项控制寄存器,它是读写的,负责设置Gamma校正、图像象、背景光补偿、图像锐化等功能。

地址号0110与0111的寄存器为窗口控制寄存器,它们均是读写的,负责设置窗口的水平尺寸、水平位置、垂直尺寸、垂直位置,以确定图像中的一个窗口。

地址号1110与1111的寄存器保留,用于测试。

2.3 数字图像的输出

OV5017中数字视频流的输出必须通过对芯片内视频数据端口,即地址号为10xx的寄存器的读取来实现。其步骤为:

(1)设置地址总线A[3..0]为10xx;

(2)使能片选CSB与输出使能OEB。

若需输出局部图像则应事先设置窗口控制寄存器。

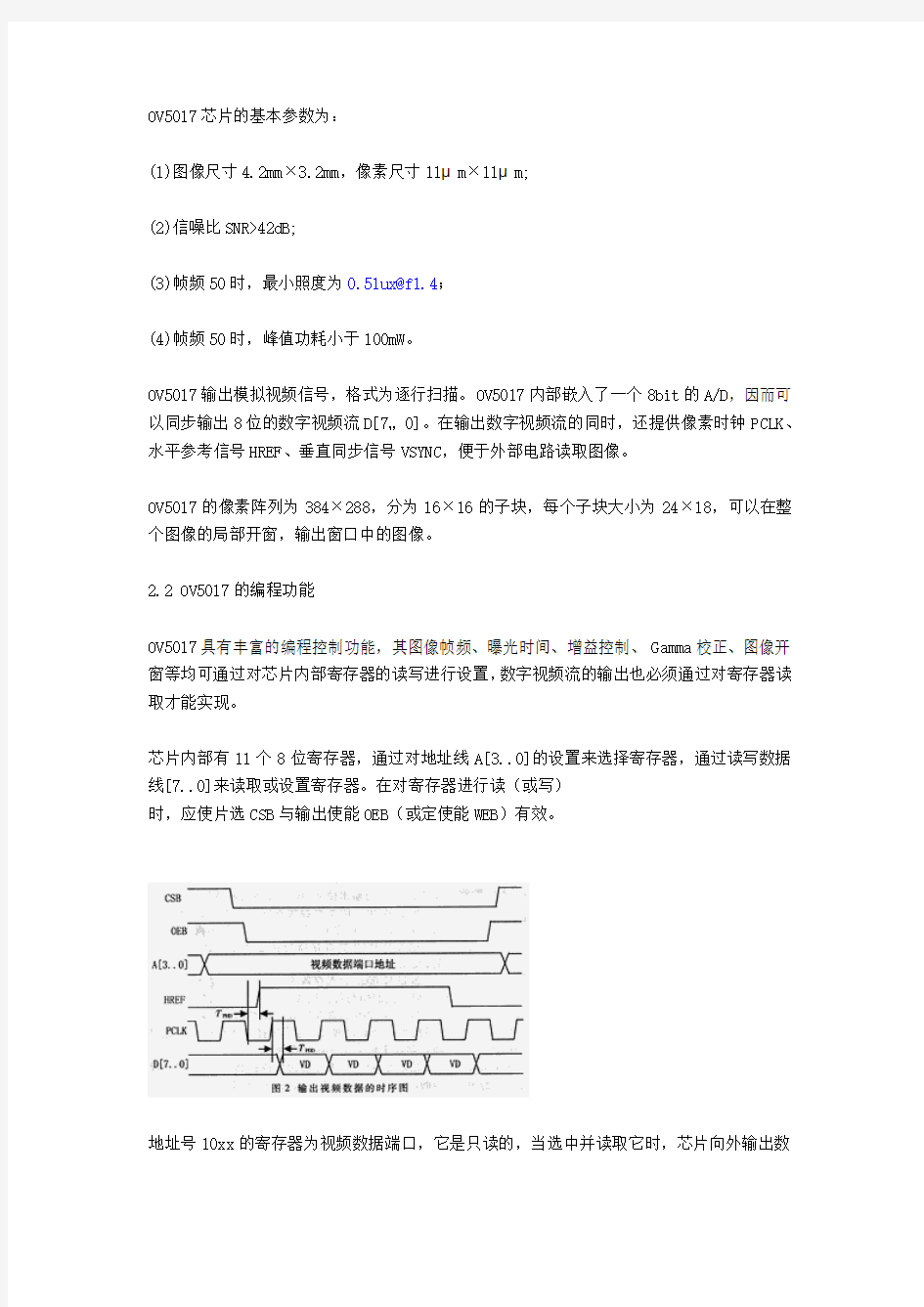

数字视频流输出的时序如图2所示。图中,

TPHD:TCLK下降沿至HREF有效,最大25ns;

TPDD:PCLK上升沿至视频数据有效,最大25ns;

VD:视频数据。

因篇幅所限,这里仅给出图像一行中4个像素输出的时序。根据图2所示时序,外部电路就可以读取芯片输出的图像数据。

3 基于OV5017的图像采集系统

基于OV5017的图像采集系统结构如图3所示。

在本系统中,OV5017作为系统的图像传感器,其内部将获取的图像采集量化,在外部逻辑的控制下输出数字图像,存入图像存储器。这里,OV5017的管脚A[3..0]与D[3..0]复用共同的外部数据线,因此加一个锁存器将它们分开。在读写OV5017的内部寄存器时,需分两个操作进行,即先选择寄存器,再读定该寄存器。同时,为避免总线冲突,TMS320C31的低8位数据线与OV5017的数据之间和TMS320C31的地址线与采集地址之间各加了一个总线隔离。

系统读取图像的过程为:

(1)对译码与时序发生器初始化;

(2)视需要设置OV5017的内部控制寄存器,如曝光控制、增益控制、窗口控制等;

(3)选择OV5017的视频数据端口,即寄存器10xx;

(4)TMS320C31向译码与时序发生器发信号,通知开始采集图像;

(5)译码与时序发生器使能总线隔离,并根据OV5017输出的参考信号,即VSYNC、HREF

与PCLK,生成图像存储器的片选、写及地址信号。这样数字图像即以连续的方式存入图像存储器中;

(6)TMS320C31向译码与时序发生器发信号,通知停止采集图像,OV5017则停止输出数字图像。

在图像采集过程中,TMS320C31可访问除图像存储器与OV5017以外的其他存储器或端口。

该系统由于省略了A/D等器件,因而具有结构简单、体积小、功耗低等优点。同时,由于OV5017内部嵌入曝光、增益、开窗等控制电路,并且编程方便,这就提高了采集系统在功能上的灵活性。本系统适合于监控、多媒体等应用范围。

嵌入式系统中CMOS图像传感器接口技术

背景

目前数字摄像技术,主要采用两种方式:一种是使用CCD(电容耦合器件)图像传感器,另一种是使用CMOS(互补金属氧化物半导体)图像传感器。

CCD图像传感器具有读取噪声低、动态范围大、响应灵敏度高等优点。但CCD技术难以与主流的CMOS技术集成于同一芯片之中。因而CCD图像传感器具有体积大、功耗高等缺点。

CMOS图像传感器是近些年发展较快的新型图像传感器,由于采用了CMOS技术,可以将像素阵列与外围支持电路(如图像传感器核心、单一时钟、所有的时序逻辑、可编程功能和模数转换器)集成在同一块芯片上。因此与CCD相比,CMOS图像传感器将整个图像系统集成在一块芯片上,具有体积小、重量轻、功耗低、编程方便、易于控制等优点。对于手持式设备来说,体积和功耗是进行软硬件设计时重点考虑的问题,因此CMOS图像传感器应用在手持式设备当中将会有广阔的前景。

文中将就嵌入式系统中设计CMOS图像传感器的图像采集设备硬件接口技术和软件驱动进行研究。

系统硬件设计

嵌入式系统硬件平台选择

摩托罗拉MC9328MX1处理器基于ARM920T嵌入式处理器内核,能工作于高达200 MHz的主频。它集成了许多模块,支持接口模块、GPIO(General Purpose I/O)接口模块、时钟产生模块(CGM,Clock Generation Module)等,为各种外设提供了灵活的接口控制功能。摩托罗拉MC9328MX1处理器内置的CSI(CMOSSensor Interface)模块提供了时序控制模块,可以适应不同CMOS图像传感器的要求。

COMS图像传感器的选择

ICM105C是IC Media公司生产的一种单芯片数字彩色图像器件,使用1/4英寸的光学系统。它内置了一个640×480(650×490物理像素)传感器阵列、数模转换器和相关双采样电路。它的控制部分使用I2C总线,只需要一个I2C总线的从设备地址就可以对其内部的控制和状态寄存器进行设置和读取。ICM105C输出的是贝叶尔格式的图像数据,其中的R GB颜色分量可以被数字增益所调整,可以反馈给嵌入式处理器进行色彩处理或压缩。

接口电路的设计

接口电路设计主要应考虑图像传感器的电源驱动控制电路的接口以及数据输出电路的接口。ICM105C使用3V的电源驱动、24MHz的时钟频率,输出8位的数据,控制部分主要使用总线,要保证ICM105C正常工作必须提供这些条件。

(1)电源驱动电路的设计。由于CMOS图像传感器是电源敏感元件,如果电源不稳会给成像效果造成很大影响。ICM105C对于供电电压的要求为3V,最小2.8V,最大3.1V,并且分开了数字电源和模拟电源。但是主处理板只提供了单3V的电源,而且这个电源同时提供给主处理板芯片使用,所以必须采取相应的机制保证电源的稳定和数字电源和模拟电源的隔离,同时本系统的另一个设计目标是小型化和简单化。为了兼顾这两者的要求,电源设计舍弃了使用复杂的稳压芯片的方案,仅使用电容和电感来稳定电压和消除数字电源和模拟电源之间的干扰,其电路图如图1 所示。

图1 电源驱动原理图

VDD 3V是主板提供的电源,VCCD和VCCA分别是提供给ICM105C 的数字电源和模拟电源,其中L1,L4,C1,C3起到隔离数字电源和模拟电源及滤波的作用。数字地和模拟地也用电感消除干扰。

(2)数据输出接口电路设计。摩托罗拉MC9328MX1处理器内置的CSI 模块提供了时序控制模块,这样可以简化电路的设计,只需要将8位数据线和输出时钟还有场频、行频和像素时钟与CSI 模块连接即可保证处理器的正确采集数据。具体的逻辑连接关系如图2 所示。

图2 ICM105C和主处理板的逻辑连接图

其中时钟线是从MC9328MX1输入24MHz的时钟信号,PCLK是CMOS输出的像素时钟,VSYNC是场频,HSYNC是行频,DOUT[0-7]为输出的数据。其时序关系如图3所示。DOUT[7:0]在PCLK时钟上升沿有效,HSYNC和VSYNC处于低电平时有效。为了达到这种时序效果需要对芯片的某些引脚进行正确地初始化设置。ICM105C的引脚37控

制数据的同步模式,用上拉电阻接高电平,这样可以使传感器输出HSYNC 和VSYNC 同步信号。

图3 ICM105C的数据输出时序图

HSYNC和VSYNC的极性也可以进行配置,将引脚46和47接地,这样HSYNC和V SYNC在有效时为低电平。引脚14为时钟选择信号,将其接地表示使用外部时钟,这样内部晶振输入引脚12、13就可以悬空。

(3)控制电路设计。要使传感器正常工作,必须对芯片内部的寄存器进行初始化。初始化的工作必须通过传感器的I2C接口进行。ICM105C提供了一种硬件初始化的方式,如果引脚33在芯片启动时为高电平,那么传感器的I2C接口将首先工作在主设备模式下,并且试图从外部的串行EEPROM中读取初始化数据。然后,传感器又回到正常的从设备工作模式下。为了使接口电路简单化,直接用主处理板的I2C 接口来控制传感器,将此引脚接地,使其工作在从模式,这样EEPROM 部分的电路就可以舍弃。

软件驱动

CMOS图像传感器需要嵌入式系统的软件驱动才能正常工作,并输出正确的图像数据。由于处理端的嵌入式系统采用的是嵌入式Linux 操作系统,I2C接口的驱动程序已经集成在操作系统内部,中断资源可以作为资源来申请,操作系统还提供了调用其它资源的接口函数,这极大地方便了驱动程序的编写。在本次设计中采用了Linux系统下模块形式的字符设备驱动程序的编写方法。整个软件驱动需要完成两个功能模块:接口的初始化模块和接收输出的数据。

初始化

(1) CSI模块的初始化。根据ICM105C芯片的数据手册,CSI 的重置信号需要保持有效直至输入电压保持恒定大于两个时钟周期,图4是时序图。

图4 软重置信号时序图

由于主处理板是一上电就开始工作,而ICM105C的驱动程序必须在处理板上的操作系统启动后才开始工作。尤其是时钟信号只有在驱动加载后才开始提供给ICM105C ,要造成重置信号的时序效果,必须使用一个软件控制的重置信号,在时钟输出到传感器后至少两个时钟周期保持有效,然后拉高电平使之无效。在设计中,采用了摩托罗拉MC9328MX1处理器一个GPIO端口来实现软重置信号。

(2)设置时钟,初始化I2C接口。ICM105C需要24MHz的时钟,摩托罗拉的MC9328 MX1处理板的外频是96MHz ,因此需要四分之一的主频。只需要设置相应的时钟产生模块寄存器的值即可保证输出24MHz。I2C总线的两个信号线SDA,SCL 需要设置相应GP IO的两个引脚,使其用来进行I2C传输。还需要挂载Linux操作系统的I2C驱动,编写I2 C读和写的功能函数。需要注意的是ICM105C的I2C地址值为21H。

(3)初始化CMOS传感器。ICM105C内部控制和状态寄存器通过I2C 总线来初始化C MOS,初始化序列(寄存器的地址、值序列)由IC Media公司提供,初始化完成后,就可以接收到数据和时序信号了。

接收数据

接收数据是驱动程序中最重要的一个部分,它需要协调好中断和DMA 传输,保证数据的正确接收,并且在出错时能够正确地恢复。这一部分的软件流程如图5所示。

图5 接收数据软件流程图

其中在开始阶段申请中断和DMA资源并申请内存空间存放接收的数据。中断的主要任务是在每一帧开始时,开始DMA传输。DMA传输主要将从FIFO中读出数据保存在内存中,并处理可能出现的错误。本例中一旦出现DMA传输错误就丢弃该帧。

数据处理

下面就是数据的处理模块。由于接收到的数据还是原始数据,需要处理才能形成最终的图像数据。

具体的处理过程如下:

(1)线性插值。由于制作工艺的问题,CMOS图像传感器中的感光点只能放置一种滤色片,也就是说它的每个物理像素点只能感应R 或G或B一种颜色,这就是贝叶尔格式的数据(如图6所示)。它必须经过插值运算才能得到每个像素的RGB值。

图6 贝叶尔格式(Bayer pattern)

由上图可以看出,每个像素点都有8个相邻的像素点,而且这8个像素点的颜色分量与此像素点不同。插值算法就是依据相邻的像素点的颜色值的空间相关性原理进行的。其处理方法如下:

a. 只有R颜色分量的像素点,其G颜色分量由周围4个G的平均值计算得出。B颜色分量由周围4个B的平均值计算得出。

b. 只有B颜色分量的像素点,其R颜色分量由周围4个R的平均值计算得出,G颜色分量由周围4个G平均值计算得出。

c. 只有G颜色分量的像素点,其R颜色分量由上下2个R的平均值计算得出,B颜色分量由左右2个B平均值计算得出。经过插值运算,每个像素点的RGB都得出了,这就形成了完整的图像数据。

(2)白平衡。任何物体在不同的光线下具有不同的色温。所谓色温,简而言之,就是定量地以开尔文温度表示色彩。色温越高,物体的蓝色分量就越多;色温越低,物体的红色分量就越多。由于人眼具有自调节性,所以即使物体色温不同,也能正确识别出颜色。但是C MOS图像传感器没有自调节性,所以当在户外日光下拍摄物体时,物体的颜色就会因为色温高而偏蓝。而在室内的荧光灯下拍摄物体时,物体的颜色就会因为色温低而偏红。要得到正确的颜色,必须进行白平衡。白平衡的基本原理是调整颜色的色温,使其保持在一个特定的范围内。在此接口的应用中采用了一个较简单的白平衡方法,其处理过程如下:

a. 首先求出一幅图像的数据每个颜色分量的平均值:

b. 求出最大的平均值:

c. 求出每个颜色数据的白平衡后的校正值:

经过这样的运算就得到了白平衡后的数据。目前白平衡还没有很好的算法来处理一切情况,这只是一个简单的算法。

结论

文中提出的ICM105C图像传感器的接口技术已经成功应用在二维条码识读器当中,为了实际应用的需要,ICM105C的电路模块被设计成只有35mm×35mm大小,通过一个20芯的排线与主处理板连接。正常工作时功耗低于50mW,采集的图像数据良好,而且可以通过软件来控制图像传感器的工作方式,非常适用于手持式设备的应用。

图像传感器与软件图像处理流水线

当今数码照相机基本都是基于电荷耦合器件(CCD)或CMOS传感器技术。这两种技术都能将光信号转换为电信号,但它们的转换方式不同。

在CCD组件中,由数百万光敏像素组成的阵列覆盖在CCD传感器的表面。在传感器曝光后,首先CCD的末端读出覆盖整个CCD像素阵列上的累积电荷,然后经模拟前端(AFE)芯片或CCD处理器数字化。另外一种传感器,CMOS传感器可直接将每个像素单元的曝光程度数字化。

通常,CCD具有最高的图像质量和最低的噪声,但是其功耗较高。CMOS传感器容易制造并且具有低功耗特性,但是其图像质量较低。部分原因是因为位于每个像素的晶体管容易阻挡到达像素的部分光信号。然而,如果在质量竞争过程中与CCD比价格,那么CMOS具有优势,并且目前采用CMOS传感器的中挡数码照相机的数量越来越多。

无论数码照相机内部采用哪种传感器,传感器阵列的所有像素都需对灰度等级灵敏——从全暗(黑)到全亮(白)。对灰度等级敏感程度被称为“比特深度”。因此,8 bit像素可区分28或256个灰度梯度,而12 bit像素可区分4096个灰度梯度。分层的整个像素阵列是一种将每个像素分为几个对颜色敏感的“子像素”的滤色镜。这种安排允许测量每个像素单元不同颜色的成分。因此,每个像素单元的颜色可看作是红色(R)、绿色(G)和蓝色(B)通道光的成分以加法方式叠加的总和。比特深度越高,RGB空间能产生的颜色越丰富。例如,24 bit颜色(R、G和B每通道为8 bit)可产生224或1,670万种离散的颜色。

为了恰当地表示彩色图像,每个像素单元,每个传感器需要3种颜色采样——最通常是R,G和B。然而,为每个数码照相机配备3个单独的传感器并不是经济有效的解决方案(虽然最近这种解决方案变得比较实际)。而且,当传感器的分辨率增加到5百万~1千万像素时,就会需要一些图像压缩格式防止为每个像素单元需要输出3个字节(或更坏情况下,对于更高分辨率的传感器,还会需要输出3个12 bit字)。

不用担忧,因为数码照相机生产厂商已经开发出了减少必要的颜色采样数目的巧妙方法。最常用的方法是采用色彩滤镜阵列(CFA),它仅测量任何给定像素单元的一种颜色。然后,用图像处理器对测量结果进行插值运算以便看起来好像在每个像素单元测量了3种颜色。

当今最流行使用的CFA是Bayer模式,如图1所示。该方案由Kodak创立,它利用这样的原理:人眼对绿色成分的识别灵敏度大于红色或蓝色。因此,在Bayer滤光镜阵列中,通过绿色滤光镜的光强是通过蓝色滤光镜或红色滤光镜的两倍。这便引出一种通常称作的“4:2:2 RGB”的输出格式,即每发送2份红色光和2份蓝色光就对应发送4份绿色光。

图1: Bayer模式图像传感器排列

图像传感器的连接

CMOS传感器通常按照YCbCr或RGB格式输出像素单元的并行数据流,同时伴随水平同步和垂直同步以及像素时钟。有时,它们允许使用外部时钟和同步信号来控制来自传感器的帧

图像输出。

另一方面,CCD传感器通常需要随后连接“模拟前端(AFE)”芯片,例如AD9948,它可处理模拟输出信号、将其数字化并且产生扫描CCD阵列的合适时序。处理器为AFE提供同步信号,它需要这种控制信号来管理CCD阵列。从AFE输出的并行数据流可能为每像素单元提供10 bit或12 bit的分辨率。

最近,低电压差分信号传输(LVDS)技术已经成为取代并行数据总线的重要方法。LVDS 技术是一种低成本、低引脚数和高速串行的连接方法,它比标准并行方案提高了抗噪声性能并且降低了功耗。随着传感器分辨率和色深度增加以及便携式多媒体应用越来越普遍,这种LVD连接方法显得格外重要,

图像流水线

当然,照相过程并不是终止于传感器,相反,传感器仅是处理过程的开始。让我们看一下原始图像在显示器上呈现出精美的图像之前是什么样子。在数码照相机中,这些处理阶段的顺序被称为“图像处理流水线”,或简称为“图像流水线”。请参见图2所示的一个数据流程。这些算法通常由多媒体处理器来完成,例如ADI公司的Blackfin处理器系列。

图2: 软件图像处理流水线流程示例

机械反馈控制

在你平静地释放快门按钮之前,聚焦和曝光系统与照相机的机械部件一起工作,根据场景特性控制镜头的位置。自动曝光算法测量分立景物区域的亮度,通过调节快门速度和(或)光圈以对曝光过度或曝光不足的区域进行补偿。我们的主要目标是维持图像中不同区域之间的相对对比度并且达到所要求的平均亮度。

自动聚焦算法可分为两类。其中主动算法采用红外线或超声波发射器和接收器估计照相机和拍摄对象之间的距离。另一种被动算法是根据照相机所接收的图像进行聚焦。

在这两种子系统中,多媒体处理器通过其输出的脉宽调制(PWM)信号控制各种镜头和快门的电机。自动曝光控制功能还能调节传感器的自动增益控制(AGC)电路。

预处理

正如我们前面所讨论的,传感器的输出需要灰度系数校正以满足最终的显示需求,并且补偿

传感器捕获响应的非线性。

因为传感器通常含有很少的无效或缺陷像素,所以常用的预处理技术可以通过中值滤波消除这些缺陷,它根据这样的原理:当光学处理有些模糊的图像时像素之间的急剧变化是不正常的。

镜头校正(暗影或畸变校正)

这套算法解决了镜头输出的图像与用户看到的实际场景相比产生畸变的物理属性问题。不同的镜头会产生不同的畸变;例如,广角镜头会造成“桶形畸变”效应,而长焦镜头会产生“枕形畸变”效应。镜头的阴影畸变降低了镜头周围区域的图像亮度。色像差会使图像周围出现色彩条纹。因此多媒体处理器需要对图像做数学变换以校正这些畸变。

预处理的另外一方面是图像稳定性补偿或信号交换校正。这里,处理器常借助于涉及到传感器实时运动轮廓的外部传感器器调节所接收图像的平移运动。

预处理的另外一个阶段称为白平衡。当我们看到一幅场景时,无论照明条件如何,我们的眼睛能将观看到的所有场景都转换成标准的自然光条件下的颜色。例如,我们所看到的苹果应是深红色,无论是在室内的荧光灯下还是室外的阳光下。然而,图像传感器对颜色的“感知”很大程度上取决于照明条件,因此它需要将它映射成所要求的图像以使其最终的输出看起来不受照明条件的影响。这种图像映射过程可手动或自动完成。

在手动系统中,在将你的照相机对准你确定是“白色”的对象后,然后将照相机移动到待拍照所有图像的“色温”区以适应这种映射。另外一种自动白平衡(AWB)方法,使用图像传感器的输入和额外的白平衡传感器来确定什么是图像中的“真正白色”。它可调节图像中R、G和B通道的相对增益。当然,AWB比手动方法需要更多的图像处理能力,并且也是供应商提供的知识产权算法。

抗马赛克、像素内插、降噪以及轮廓增强

抗马赛克〔或色彩滤镜阵列插值(Demosaicking)〕可能是图像流水线中最重要并且计算量最大的阶段。通常各数码照相机制造商都有自己的“秘诀”,但通常可将这些方法分成几种主要的算法。

双线性插值或双三次插值等非自适应算法属于最简单易行的方法,它们非常适合处理图像的平滑区域。然而,用这些简单的算法处理边缘或纹理丰富的区域时会遇到问题。自适应算法根据局部图像特点改变算法,从而可以提供较好的效果。

自适应算法的一个例子是基于边缘重构。这种算法分析围绕像素的区域并且确定在哪个方向上完成内插。如果它在像素附近找到了边缘,则将沿着边缘进行插值,而不是越过边缘。另一种自适应算法是假设整个对象是恒定色调,这可以防止在个别对像中颜色梯度的突变。还有许多其它的抗马赛克技术,包括频域分析、贝叶斯判决准则,以及神经网络。

颜色空间变换

在这一阶段,将内插后的RGB图像变换为目标输出颜色空间(如果还不是合适的颜色空间)。为了压缩或在电视机上显示图像,这通常包括RGB YCbCr的矩阵转换,通常还包括另外的灰度系数校正电路以适应目的显示器。在这一阶段按照标准4:2:2格式可能还要对YCbCr 输出进行颜色子采样以便在几乎不影响视觉效果的情况下减少颜色带宽。

后处理

在这一阶段,图像在送到显示器和(或)存储媒体之前通过各种滤波作用完善图像。例如,边缘轮廓增强、像素阈值处理以降低噪声、以及人工颜色删除通常都在这阶段完成。

显示、压缩和存储

如果图像本身准备用于浏览,图像流水线会产生两个不同的方向的分支。第一个分支,后处理图像输出到目的显示器,通常是集成液晶显示(LCD)屏(但是对于某种型号的数码照相机,有时是NTSC或PAL电视监视器)。第二个分支,将图像送到多媒体处理器运行压缩算法软件,在将图像本地存储在存储媒体(通常是非易失闪存卡)之前使用工业标准压缩技术(例如JPEG标准)进行压缩。

TC237B型CCD图像传感器的原理及应用

1 引言

TC237B是TI公司生产的一款1/3英寸的帧转移方式的电荷耦合器件(CCD)图像传感器。它有340000个像素,其中有效像素为658x496,能广泛应用在黑白电视系统、电脑、工业检测等需要低成本和小尺寸的场合。

TC237B的图像感光区由500行像素组成,每行有680个像素,其中每行有22个像素用于提供参考黑电平。它的反模糊特性基于一种先进的横向溢出漏级概念。传感器能在低暗电流下,作为一款658(H)x496(V)的传感器在隔行模式下工作;同时,TC237B的另一个重要特性是它能每帧采集340000个像素。传感器还具有高速图像传输特性,并且能在不损失敏感度和分辨率的情况下进行持续电子曝光控制。感光电荷在一个高性能的,带有复位和参考电平发生器的结构中转换成13μV/e的信号电压。产生的信号进一步通过低噪音的二阶信号源输出放大器进行缓冲,从而提高输出的驱动能力。

TC237B型图像传感器采用了TI公司特有的先进虚拟阶段(A VP)技术。A VP技术能使传感器具有高蓝色响应、低暗电流、高光响应一致性和单相时钟等优点。

2 主要特点和引脚功能

图1示出TC237B型图像传感器采用12引脚双列直插封装的引脚排列,其引脚功能如表l 所列。TC237B的主要特点如下:

●高分辨率,1/3英寸固态传感器;

●每场可达340000个像素;

●帧存储;

●具有658(H)x496(V)有效像素,兼容电子调中;

●有多种读出模式特性:逐行扫描方式、隔行扫描方式、双行同时读出模式、图像区行累加、拖影消减;

●快速单脉冲图像区清除特性;

●能进行1/60"1/50000秒的持续电子曝光控制;

●7.4μmx7.4μm像素;

●先进横向溢出漏级反模糊技术;

●暗电流小;

●感光反应一致性高;

●动态范围大:

●光敏感度高;

●蓝色响应高;

●无图像老化、图像残留、图像失真、图像延迟或颤噪效应等现象。

3 内部结构

TC237B由4个基本功能模块组成:图像感光区、图像存储区、串行寄存器和带有电荷检测

及独立复位的低噪音信号处理放大器模块,其原理框图如图2所示。

3.1 图像感光区和图像存储区

图像感光区和存储区占据了TC237B的大部分面积,分别拥有340000个像素。当光射进图像感光区的硅元件时,将产生电子——空穴对,并聚集在势阱之中。在开始一段新的感光时间前,只需在溢出漏级施加1个1μs以上的脉冲就可以消除图像。图像存储区的像素数和感光区的相同,尺寸比感光区的略小,并且被外壳遮盖以免受到外界光的照射影响,这样,感光完成后一场感光电荷就可以传送到存储区。感光电荷从感光区传送到存储区的过程叫做并行传输。并行传输的时间取决于读出模式是隔行扫描还是逐行扫描。当使用逐行扫描模式时,信号还可以选择单通道读出或双通道快速读出。

在图像感光区的左部,每行有22个像素被金属遮光屏覆盖。这些暗像素可以为图像的后继处理电路提供黑参考电平。除此以外,在图像感光区和图像存储区间有4行像素同样被金属遮光屏覆盖,它们的存在避免了感光区的电荷泄漏到存储区中。

3.2 串行寄存器和信号读出

感光电荷在存储区门和串行门的控制下将一行一行地从存储区传送到1个或2个寄存器。使用1个或2个寄存器取决于采用何种读出模式。当使用2个寄存器时,信号的读出是并行的。

当像素被传送到串行寄存器后,它们将随时钟送出并由一个电荷探测节点所检测。探测节点必须在下一个像素到达之前先复位到一个参考电平。而串行寄存器的读出时序需要符合相关双采样(CDS)的要求。当电荷送到探测节点上时,节点上的电势按比例地转变成相应数量的接收电荷。这种转变由一个MOS晶体管感测。信号在适当缓冲后将提供给图像传感器的输出端。

4 在嵌入式图像采集系统中的应用

嵌入式图像采集系统主要由TC237B图像传感器、驱动电路、模拟前端、CPID、ARM7TDMI

处理器、FIFO组、SDRAM存储器等组成,其原理如图3所示。

在本系统中,CPID是采集系统的控制核心,也是TC237B的信号时钟发生器。采集时,TC237B 在CPLD提供的驱动时钟作用下完成光电转换,并把图像信号串行发送到模拟前端。图像信号经过模拟前端的信号调整和A/D转换后,转化为8-bit的数字量。然后在CPLD的调配下,经过FIFO组的缓冲,由ARM处理器把数字量存放到SDRAM中,从而实现图像的采集。

如上所述.TC237B有多种读出模式,本系统采用的是逐行扫描单通道输出模式。选用这种模式只需要对输出的CCD信号使用1个通道的模/数转换即可,从而使得后继的信号处理变得更为简单,适合于对时间要求不特别高的场合。图4示出TC237B采用逐行扫描单通道输出时采集一帧图像的时序。

采集一帧图像要经过图像清除、感光、并行传输和读出4个阶段。其中,读出阶段需时最长。当需要采集时,ARM处理器发出采集信号,告知CPLD采集开始。在开始新的采集前,TC237B先复位先前所有的状态并清除图像信息。这种清除只需把ODB信号提升至26V并维持lμs以上即可。清除完成后,进入感光期。感光时间也是曝光长度。短时间曝光会使CCD受到较小的光子冲击,形成一幅曝光不足的低照度图像;相反,长时间曝光可形成一幅感光过度的图像。在光线很弱的场所,例如天文摄影,长时间曝光是必要的。设计者应该根据实际情况,配合光学系统,选择适当的曝光时间。

曝光时间完成后意味着光电转换已经完成,将进入并行传输阶段把电荷转移出去。

并行传输是由IAGl、IAG2、SRG、SAG四个信号的一系列时钟脉冲完成的。图像感光区是二相结构的,lAGl门连接感光区的所有奇数行像素,IAG2门则连接了感光区的所有偶数行的像素。因此在并行传输阶段,只要同时给IAGl门和lAG2门发1个脉冲,奇偶行的像素同时下移1个单位,从而实现l行像素下移到存储区。这里lAGl和IAG2脉冲信号必须没有相位差,否则会引起电荷的叠加,使图像失真。由于存储区是单相结构,所以当l行像素下移到存储区后只需往SAG门发送1个脉冲就可以把存储区的所有像素下移1个单位,为接收感光区的下1行像素准备空间。这样,经过500个脉冲后1帧图像就完成了帧存储。

要注意的是,由于在并行传输期间感光区仍在感光,因此如果并行传输的频率太低,像素信号在传送到存储区的同时仍在积累电荷,从而形成带有垂直拖尾的图像。这是在帧间转移CCD中常见的问题。为了避免拖尾效应,并行传输的时间应远小于感光时间。垂直拖尾百分比(rs)可以按下式计算:

其中,txfer是并行传输时间;tint是感光时间;nIA是图像的行数;fxfer是并行传输的频率。

本系统并行传输的频率为2.5MHz,曝光时间选为1/60s,按照式(1)可求出垂直拖尾百分比为0.125%。

采集图像的最后1个阶段就是要把存储区的像素经过串行寄存器发送到输出端。读出期包含行传输和串行读出过程,这2个过程均由SAG和SRG的时钟脉冲完成。首先在行传输期间,SAG信号和SRG信号先后各以1个脉冲把一行像素送到串行寄存器2中。然后,SRG 信号在684个时钟脉冲驱动下把整个串行寄存器的所有像素逐一送出。如此循环500次,一帧图像就从传感器的输出端发送出去。

整个采集时间大约154ms,可以满足各种场合的需要。

TC237B的整个工作时序的软件设计是在MAX+plusⅡ环境中用VHDL语言实现的。根据时序的各个时段进行有限状态机的设计。各个状态的转移如图5所示。

中国CMOS图像传感器行业研究-行业发展概况 (一)行业发展概况 1、集成电路行业 2010年以来,以智能手机、平板电脑为代表的新兴消费电子市场的兴起,以及汽车电子、工业控制、仪器仪表、智能照明、智能家居等物联网市场的快速发展,带动整个半导体行业规模迅速增长。2017年,全球半导体行业整体销售额达到4,122亿美元,同比增长21.63%,增速创七年来新高。 数据来源:全球半导体贸易协会(WSTS)

根据全球半导体贸易协会(WSTS)预测,2018年全球半导体市场规模将达到4,512亿美元,同比增长9.5%。 数据来源:全球半导体贸易协会(WSTS)

2、CMOS图像传感器行业 (1)图像传感器行业概况 图像传感器为物联网感知层众多传感器中最重要的一种核心传感器。图像传感器主要采用感光单元阵列和辅助控制电路获取对象景物的亮度和色彩信号,并通过复杂的信号处理和图像处理技术输出数字化的图像信息。图像传感器中的感光单元一般采用感光二极管(Photodiode)实现光电信号的转换。感光二极管在接受光线照射之后能够产生电流信号,电流的强度与光照的强度成正比例关系。每个感光单元对应图像传感器中的一个像元,像元也被称为像素单元(Pixel)。 图像传感器主要分为CCD图像传感器和CMOS图像传感器两大类。CCD和CMOS 都是利用感光二极管进行光电转换,将图像转换为数字信号,但二者在感光二极管的周边信号处理电路和感光单元产生的电信号的处理方式不同。 CCD和CMOS的感光元件在接受光照之后直接输出的电信号都是模拟信号。在CCD传感器中,每一个感光元件都不对此作进一步的处理,而是将它直接输出到下一个感光元件的存储单元,结合该元件生成的模拟信号后再输出给第三个感光元件,依次类推,直到结合最后一个感光元件的信号才能形成统一的输出。由于感光元件生成的电信号非常微弱,无法直接进行模数转换工作,因此这些输出数据必须做统一的放大处理。由于CCD本身无法将模拟信号直接转换为数字信号,因此还需要一个专门的模数转换芯片进行处理,最终以数字图像矩阵的形式输出给专门的图像处

. net 光学制造 1内蒙古工业大学理学院, 内蒙古呼和浩特 0100512北京师范大学遥感与 GIS 研究中心遥感科学国家重点实验室, 北京 10087! " 5 Li Jijun 1 Du Yungang 1Zhang Lihua 1, 2 Liu Quanlong 1Chen Jianrui 1 1School of Science, Inner Mongolia University of Technology , Hohhot, Inner Mongolia 010051, China, 2State Key Laboratory of Remote Sensing Science, Research Center of Remote Sensing &GIS, Beijing Normal University ,Beijing 100875, China #$$$$$$$$$$$% &’ ’ ’ ’ ’ ’ ’ ’ ’ ’ ’ ( 摘要 20世纪 90年代以来, 随着超大规模集成 (VLSI 技术的发展, CMOS 图像传感器显示出强劲的发展势头。简要介绍了 CMOS 图像传感器的结构及工作原理, 详细比较了 CMOS 图像传感器与 CCD 的性能特点, 讨论了 CMOS 图像传感器的关键技术问题,并给出了相应的解决途径,综述了 CMOS 图像传感器的国内外研 究现状, 最后对 CMOS 图像传感器的发展趋势进行了展望。 关键词光电子学; 传感器; CMOS 图像传感器; CCD ; 关键技术问题 Abstract

Since the 1990s, with the development of very large scale integration (VLSI,CMOS image sensors have been developed rapidly. The structure and working principle of CMOS image sensors are introduced. The performances between CMOS image sensor and CCD are compared in detail. The key technical problems of CMOS image sensors are discussed, and the related solving ways are given. The development situation of CMOS image sensors at home and abroad is reviewed, and the development trends of CMOS image sensors are prospected. Key words optoelectronics; sensor; CMOS image sensor; CCD; key technical problem 中图分类号 O436 doi :10.3788/LOP20094604.0045 1引言 CMOS 图像传感器的研究始于 20世纪 60年代末, 受当时工艺技术的限制, 发展和应用有限。直到 20世纪 90年代初,随着大规模集成电路设计技术和信号处理技术的提高, CMOS 图像传感器才日益受到重视 [1~3], 成为固体图像传感器的研发热点。近几年来, 随着集成电路设计技术和工艺水平的长足进步 , CMOS 图像传感器的一些性能指标已接近甚至超过CCD 图像传感器 [4~6]。 本文简要介绍了 CMOS 图像传感器的结构及工作原理,详细比较了 CMOS 图像传感器与 CCD 的性 能特点,讨论了 CMOS 图像传感器的关键技术问题, 并给出了相应的解决途径, 综述了 CMOS 图像传感器的国内外研究现状, 最后对 CMOS 图像传感器的发展趋势进行了展望。 2结构及工作原理 CMOS 图像传感器的总体结构如图 1所示

CMOS图像传感器的基本原理及设计考虑 摘要:介绍CMOS图像传感器的基本原理、潜在优点、设计方法以及设计考虑。 关键词:互补型金属-氧化物-半导体图像传感器;无源像素传感器;有源像素传感器 1引言 20世纪70年代,CCD图像传感器和CMOS图像传感器同时起步。CCD图像传感器由于灵敏度高、噪声低,逐步成为图像传感器的主流。但由于工艺上的原因,敏感元件和信号处理电路不能集成在同一芯片上,造成由CCD图像传感器组装的摄像机体积大、功耗大。CMOS图像传感器以其体积小、功耗低在图像传感器市场上独树一帜。但最初市场上的CMOS图像传感器,一直没有摆脱光照灵敏度低和图像分辨率低的缺点,图像质量还无法与CCD图像传感器相比。 如果把CMOS图像传感器的光照灵敏度再提高5倍~10倍,把噪声进一步降低,CMOS 图像传感器的图像质量就可以达到或略微超过CCD图像传感器的水平,同时能保持体积小、重量轻、功耗低、集成度高、价位低等优点,如此,CMOS图像传感器取代CCD图像传感器就会成为事实。 由于CMOS图像传感器的应用,新一代图像系统的开发研制得到了极大的发展,并且随着经济规模的形成,其生产成本也得到降低。现在,CMOS图像传感器的画面质量也能与CCD图像传感器相媲美,这主要归功于图像传感器芯片设计的改进,以及亚微米和深亚微米级设计增加了像素内部的新功能。 实际上,更确切地说,CMOS图像传感器应当是一个图像系统。一个典型的CMOS图像传感器通常包含:一个图像传感器核心(是将离散信号电平多路传输到一个单一的输出,这与CCD图像传感器很相似),所有的时序逻辑、单一时钟及芯片内的可编程功能,比如增益调节、积分时间、窗口和模数转换器。事实上,当一位设计者购买了CMOS图像传感器后,他得到的是一个包括图像阵列逻辑寄存器、存储器、定时脉冲发生器和转换器在内的全部系统。与传统的CCD图像系统相比,把整个图像系统集成在一块芯片上不仅降低了功耗,而且具有重量较轻,占用空间减少以及总体价格更低的优点。 2基本原理 从某一方面来说,CMOS图像传感器在每个像素位置内都有一个放大器,这就使其

CMOS图像传感器的性能 2.2.1光电转换的原理和性能 当光子入射到半导体材料中,光子被吸收而激发产生电子–空穴对,称为光生载流子,如图2.3(a)所示。量子效率(Quantum Efficiency,QE)被定义为产生光生载流子的光子数占总入射光子数的百分比;或者被定义为η,即每个入射光子激发出来的光生载流子数。 式中,N e为被激发出来的电子数;N v为入射的光子数。不同的半导体材料对入射光的响应随其波长而变化,对于硅材料而言波长覆盖整个可见光范围,截止在 约1.12μm的近红外波长,如图2.3(b)所示。 (a)(b) 图2.3硅半导体材料的光照响应 光电信号的噪声水平决定了能检测到的最小光功率,即光电转换的灵敏度。硅光电传感器的噪声构成包括: ●来源于信号和背景的散粒噪声(shot noise);

●闪烁噪声(flicker noise),即1/f噪声; ●来源于电荷载流子热扰动的热噪声(thermal noise)。 噪声特性用噪声等效功率NEP(Noise Equivalent Power)表达,信号功 率和噪声等效功率的比值,被称为信噪比(Signal Noise Ratio,SNR),是描述传感器性能的重要参数之一。 当入射光子照射在半导体材料的PN结上,如图2.4(a)所示,如果在PN 结上施加电压使光生载流子形成电流,产生如图2.4(b)所示的I-V特性曲线。曲线上V>0的正向偏置一段被称为太阳能电池模式;PN结反向偏置V<0的平直一段曲线,被称为光电二极管模式;I-V特性的反向击穿段被称为雪崩模式。通常在图像传感器中,光电转换元件工作在光电二极管模式,如图2.3(c)所 示。图2.3中PN结的反向电流I leak为 I leak=I ph+I diff (a)(b) 图2.4PN结光电二极管示意图

CMOS图像传感器的工作原理及研究 摘要:介绍了CMOS图像传感器的工作原理,比较了CCD图像传感器与CMOS图像传感器的优缺点,指出了CMOS图像传感器的技术问题和解决途径,综述了CMOS图像传感器的现状和发展趋势。 1 引言 自从上世纪60年代末期,美国贝尔实验室提出固态成像器件概念后,固体图像传感器便得到了迅速发展,成为传感技术中的一个重要分支,它是PC机多媒体不可缺少的外设,也是监控中的核心器件。互补金属氧化物半导体(CMOS)图像传感器与电荷耦合器件(CCD)图像传感器的研究几乎是同时起步,但由于受当时工艺水平的限制,CMOS图像传感器图像质量差、分辨率低、噪声降不下来和光照灵敏度不够,因而没有得到重视和发展。而CCD 器件因为有光照灵敏度高、噪音低、像素少等优点一直主宰着图像传感器市场。由于集成电路设计技术和工艺水平的提高,CMOS图像传感器过去存在的缺点,现在都可以找到办法克服,而且它固有的优点更是CCD器件所无法比拟的,因而它再次成为研究的热点。 70年代初CMOS传感器在NASA的Jet Pro pul sion Laboratory(JPL)制造成功,80年代末,英国爱丁堡大学成功试制出了世界第一块单片CMOS型图像传感器件,1995年像元数为(128×128)的高性能CMOS有源像素图像传感器由喷气推进实验室首先研制成功[1],1997年英国爱丁堡VLSI Ver sion公司首次实现了CMOS图像传感器的商品化,就在这一年,实用CMOS技术的特征尺寸已达到0.35mm,东芝研制成功了光敏二极管型APS,其像元尺寸为5.6mm×5.6mm,具有彩色滤色膜和微透镜阵列,2000年日本东芝公司和美国斯坦福大学采用0.35mm技术开发的CMOS-APS已成为开发超微型CMOS摄像机的主流产品。 2 技术原理 CCD型和CMOS型固态图像传感器在光检测方面都利用了硅的光电效应原理,不同点在于像素光生电荷的读出方式。CMOS图像传感器芯片的结构 [2]如图1所示。典型的CMOS像素阵列[3],是一个二维可编址传感器阵列。传感器的每一列与一个位线相连,行允许线允许所选择的行内每一个敏感单元输出信号送入它所对应的位线上(图2),位线末端是多路选择器,按照各列独立的列编址进行选择。根据像素的不同结构[4],CMOS图像传感器可以分为无源像素被动式传感器(PPS)和有源像素主动式传感器(APS)。根据光生电荷的不同产生方式APS又分为光敏二极管型、光栅型和对数响应型,现在又提出了DPS(digital pixel sensor)概念。

CMOS图像传感器的基本原理及设计考虑 1、引言 20世纪70年代,CCD图像传感器和CMOS图像传感器同时起步。CCD图像传感器由于灵敏度高、噪声低,逐步成为图像传感器的主流。但由于工艺上的原因,敏感元件和信号处理电路不能集成在同一芯片上,造成由CCD图像传感器组装的摄像机体积大、功耗大。CMOS图像传感器以其体积小、功耗低在图像传感器市场上独树一帜。但最初市场上的CMOS图像传感器,一直没有摆脱光照灵敏度低和图像分辨率低的缺点,图像质量还无法与CCD图像传感器相比。 如果把CMOS图像传感器的光照灵敏度再提高5倍~10倍,把噪声进一步降低,CMOS图像传感器的图像质量就可以达到或略微超过C CD图像传感器的水平,同时能保持体积小、重量轻、功耗低、集成度高、价位低等优点,如此,CMOS图像传感器取代CCD图像传感器就会成为事实。 由于CMOS图像传感器的应用,新一代图像系统的开发研制得到了极大的发展,并且随着经济规模的形成,其生产成本也得到降低。现在,CMOS图像传感器的画面质量也能与CCD图像传感器相媲美,这

主要归功于图像传感器芯片设计的改进,以及亚微米和深亚微米级设计增加了像素内部的新功能。 实际上,更确切地说,CMOS图像传感器应当是一个图像系统。一个典型的CMOS图像传感器通常包含:一个图像传感器核心(是将离散信号电平多路传输到一个单一的输出,这与CCD图像传感器很相似),所有的时序逻辑、单一时钟及芯片内的可编程功能,比如增益调节、积分时间、窗口和模数转换器。事实上,当一位设计者购买了CM OS图像传感器后,他得到的是一个包括图像阵列逻辑寄存器、存储器、定时脉冲发生器和转换器在内的全部系统。与传统的CCD图像系统相比,把整个图像系统集成在一块芯片上不仅降低了功耗,而且具有重量较轻,占用空间减少以及总体价格更低的优点。 2、基本原理 从某一方面来说,CMOS图像传感器在每个像素位置内都有一个放大器,这就使其能在很低的带宽情况下把离散的电荷信号包转换成电压输出,而且也仅需要在帧速率下进行重置。CMOS图像传感器的优点之一就是它具有低的带宽,并增加了信噪比。由于制造工艺的限制,早先的CMOS图像传感器无法将放大器放在像素位置以内。这种被称为PPS的技术,噪声性能很不理想,而且还引来对CMOS图像传感器的种种干扰。

CMOS图像传感器的工作原理 1引言 图像传感器是将光信号转换为电信号的装置,在数字电视、可视通信市场中有着广泛的应用。60年代末期,美国贝尔实脸室发现电荷通过半导体势阱发生转移的现象,提出了固态成像这一新概念和一维CCD(Charge-Coupled Device 电荷耦合器件)模型器件。到90年代初,CCD技术已比较成热,得到非常广泛的应用。但是随着CCD应用范围的扩大,其缺点逐渐暴露出来。首先,CCD技术芯片技术工艺复杂,不能与标准工艺兼容。其次,CCD技术芯片需要的电压功耗大,因此CCD技术芯片价格昂贵且使用不便。目前,最引人注目,最有发展潜力的是采用标准的CMOS(Complementary Metal Oxide Semiconductor 互补金属氧化物场效应管)技术来生产图像传感器,即CMOS图像传感器。CMOS图像传感器芯片采用了CMOS工艺,可将图像采集单元和信号处理单元集成到同一块芯片上。由于具有上述特点,它适合大规模批量生产,适用于要求小尺寸、低价格、摄像质量无过高要求的应用,如保安用小型、微型相机、手机、计算机网络视频会议系统、无线手持式视频会议系统、条形码扫描器、传真机、玩具、生物显微计数、某些车用摄像系统等大量商用领域。20世纪80年代,英国爱丁堡大学成功地制造出了世界上第一块单片CMOS图像传感器件。目前,CMOS图像传感器正在得到广泛的应用,具有很强地市场竞争力和广阔地发展前景。 2 CMOS图像传感器基本工作原理

右图为CMOS图像传感器的功能框图。 首先,外界光照射像素阵列,发生光电效应,在像素单元内产生相应的电荷。行选择逻辑单元根据需要,选通相应的行像素单元。行像素单元内的图像信号通过各自所在列的信号总线传输到对应的模拟信号处理单元以及A/D转换器,转换成数字图像信号输出。其中的行选择逻辑单元可以对像素阵列逐行扫描也可隔行扫描。行选择逻辑单元与列选择逻辑单元配合使用可以实现图像的窗口提取功能。模拟信号处理单元的主要功能是对信号进行放大处理,并且提高信噪比。另外,为了获得质量合格的实用摄像头,芯片中必须包含各种控制电路,如曝光时间控制、自动增益控制等。为了使芯片中各部分电路按规定的节拍动作,必须使用多个时序控制信号。为了便于摄像头的应用,还要求该芯片能输出一些时序信号,如同步信号、行起始信号、场起始信号等。 3象素阵列工作原理 图像传感器一个直观的性能指标就是对图像的复现的能力。而象素阵列就是直接关系到这一指标的关键的功能模块。按照像素阵列单元结构的不同,可以将

有源像素CMOS 图像传感器 图1示出了有源像素CMO 图像传感器(Active Sensor , APS)的功能结构图 其中成像部分为光极管阵列(Photo Diode Array) 图l 肓澤曜CMOE 弗車锋暮E 慚功能结码團 四场效应管(4T)有源像素CMO 图像传感器的每个像素由光敏二极管、复位管 T 。、转移管T1、源跟随器T 。和行选通开关管T 。组成,如图2所示[9]。 转移管T1,被用来将光敏二极管连接至源跟随器 T3。,并通过复位管T2与 VDD 相连.T3的栅极与T1和T2之间的N+扩散区相连。与3T 结构的APS 相比,减 少了与T3的栅极相关的漏电流效应。源跟随器 T3的作用是实现对信号的放大和缓 冲,改善APS 的噪声问题。T4是用来将信号与列总线相连。其工作过程是:首先进 入“复位状态”,T2打开,对光敏二极管复位;然后进入“取样状态”,T2关闭, 光照射到光敏二极管上产生光生载流子,并通过源跟随器 T3放大输出;最后进入 “读出状态”,这时行选通管 T4打开,信号通过列 总线输出。 CIS 图像传感器 IMAM LIMF 」 iryht r TT READOUT SlUUCTUftf TT. |fOL( MKAJKi /T± PHQ-TVUIUW KEfPfR , AK.A'*?. 匚AM 和 COKFROl JNRHpAfE I CXI, 一 rnMFM^r FAME , puftr Wi 」代Met T1MIMG R?X1 巾 UVlJMJtf 接触式图像传感器( CIS(Contact Image Sensor) 是90 年代新型图像传感 器。与电荷耦合器件(CCD相比.CIS的优点主要有a无须外加光源、光学透镜等辅助机构b具有尺寸小、重量轻、结构紧凑及便于安装c采用R a 3光源.系统功耗低d采用陶瓷基底.有良好的温度特性。 目前.已有部分传真机及多功能打印机(MFP采用了CIS。世界著名的扫描仪制造商Microtek 公司于1998年底推出了世界上第1台超 薄型平台扫描仪Simscan C3 ,.首次使用CIS。近年来美军及北约的军用传真机及MFP中,相当一部分采用了CIS,近些年来.国外有数家公司致力CIS的研制、生产或相关技术的研究工作。然而.目前CIS技术还不如CCD成熟.CIS的分辨率还不很高. 应用情况还不够理想,但可以预见. 随着CIS 技术的发展.CIS 必将有广阔的应用前景。 CIS的结构组成与原理 图1中给出了CIS头截面剖视图2如图所示.CIS头由LED光源阵列、微自聚焦棒状透镜阵列、光电传感器的阵列、保护玻璃、铝质壳体及聚光棱镜等组成。CIS头的内部组成框图如图2所示.该CIS头物理分辨率为203DPI(8 point/mm),有效扫描宽度为216mm其传感器单元及棒状聚焦透镜一一对应地排成线阵,共有1728个传感单元,可分别检测1728个像素点,VLED和GLEE为内LED阵列的电源和地。SCLK为CIS的扫描控制时钟;SI为启动扫描控制信号,A0为CIS的模拟输出端,工作时CIS 头与扫描文稿直接接触,来自CIS头内LED 阵列的光源经聚光棱镜后照射在扫描文稿上,其反射光经棒状聚焦透镜后照射在CIS头内的光电检测单元上。反射光线的强弱随扫描文稿上被扫描处的黑/白程度 变化。 CMOS图像传感器的基本结构 2.1.1CMOS图像传感器的框图 一个典型的CMOS图像传感器结构如图2.1所示。这个结构包括由有源像素传感器(APS)构成的像素阵列、垂直扫描电路、每一列像素共享的列读出 通道和列选择开关、模拟图像信号放大器、模数转换器和图像数据输出等。控制器控制各个图像信息获取部件,进行所需要的曝光-读出同步操作。控制数据由外部通过串行数据输入端口输入,并存储在控制数据存储器中。 图2.1CMOS图像传感器结构框图 CMOS图像传感器的像素为有源像素传感器APS,每个像素中有一个光电二极管作为基本的光电转换元件,如图2.1左上角的方框所示。在每个像素中还包括由若干个MOS晶体管有源器件组成的电路,把光子在光电二极管PN结 上激发的载流子电荷信号转换成电压信号,并由模拟开关控制光电二极管的曝光操作和信号输出。在大多数阵列设计中,像素几何形状采取正方形,像素在阵列 中正交排列。像素阵列示意在图 2.1框图的中央,水平排列的像素构成行 (Row),每行由M个像素组成,垂直方向的像素构成列(Column),整个阵列由M列和N行像素构成,阵列的总像素数为M×N。 像素阵列的主要操作就是曝光和读出,因为阵列中一般的曝光和读出是按行进行的,所以垂直扫描实际上就是实现按行操作阵列的曝光和读出。水平扫描操作实际上是当某一行执行读出时,顺序扫描读出这一行中的每个像素的信号,水平扫描是由列模拟开关依次开启来执行的。垂直和水平扫描系统就是用于按行和列顺序,控制和操作整个阵列的曝光和读出。 阵列中每一列的像素共享一个列读出通道,在有M列像素的阵列中有M个 完全相同的通道电路,对信号进行放大和模拟处理,以获取和改善一列像素的图像信号。经过列选择的图像信号通过可变增益的宽带模拟放大器,然后输入到高速模拟数字转换电路。模拟图像信号在模数转换电路上变换成数字图像数据,以串行或并行格式输出到集成电路芯片的引脚上。 整个像素阵列的曝光和读出过程,由一个控制器按事先设计的时序和输入的指令同步操作,操作时序由像素阵列的曝光和读出的方式和速率所决定。为了减 少芯片引脚的数量,操作指令和数据通常以串行方式如I2C格式输入,并存储在控制数据存储器中,作为每次曝光读出操作的依据。操作指令通过译码产生操作的控制信号,控制扫描电路和各个模拟开关的同步操作。 2.1.2CMOS图像传感器芯片的封装 CMOS图像传感器一般采用标准的集成电路芯片封装,只是在外壳的传感 器阵列上方,制作一个光学玻璃窗口,使被摄物体的光学图像经过透镜聚焦,成像在芯片的像素阵列平面上。在这里,透镜系统的光学中轴线,必须对准传感器 阵列平面的几何中心,并与成像平面精密垂直。图2.2的左边示意封装的剖面,封装外壳和玻璃窗口共同实现芯片的密封,芯片的焊盘由引线焊接到封装引脚实现电连接。图2.2右边是CMOS图像传感器集成电路芯片的俯视图,硅片安装 在封装外壳中,硅片上较亮的矩形面积是像素阵列,深色区域是由遮光材料覆盖的模拟和数字电路部分,周边是引脚焊盘。在数码照相机或电视视频摄像机中,CMOS图像传感器芯片被安装在透镜光学系统的后面,从窗口输入光学图像,从芯片引脚上输出图像数据信号。芯片与图像存储、处理和有关的控制电路一起安装在印制电路板上,形成可以独立操作和完成独立功能的整机。 CMOS图像传感器简介 ——机制班张波摘要:本文介绍了CMOS图像传感器的工作原理和性能指标,指出了CMOS图像传感器的技术问题和解决途径,综述了CMOS图像传感器的现状和发展趋势。 1.引言 CMOS(Complementary Metal Oxide Semiconductor,互补金属氧化物半导体)图像传感器是利用CMOS工艺制造的图像传感器,主要利用了半导体的光电效应,和电荷耦合器件(CCD)图像传感器的原理相同。 自从上世纪60年代末期,CMOS图像传感器与CCD图像传感器的研究几乎同时起步,但由于受当时工艺水平的限制,CMOS图像传感器图像质量差、分辨率低、噪声降不下来和光照灵敏度不够[1],因而没有得到重视和发展。而CCD器件因为有光照灵敏度高、噪音低、像素少等优点一直主宰着图像传感器市场[2]。由于集成电路设计技术和工艺水平的提高,CMOS图像传感器过去存在的缺点,现在都可以找到办法克服,而且它固有的优点更是CCD器件所无法比拟的,因而它再次成为研究的热点。 2.基本原理 CMOS型和CCD型固态图像传感器在光检测方面都利用了硅的光电效应原理,不同点在于像素光生电荷的读出方式。CMOS图像传感器工作原理如图1所示[3]。根据像素的不同结构,CMOS图像传感器可以分为无源像素被动式传感器(PPS)和有源像素主动式传感器(APS)。根据光生电荷的不同产生方式APS 又分为光敏二极管型、光栅型和对数响应型,现在又提出了DPS(digital pixel sensor)概念。 图1 CMOS图像传感器工作原理 (1)无源像素被动式传感器(PPS) PPS的像素结构包含一个光电二极管和一个场效应管开关V,其像素结构如图2所示,图3为信号时序图。当V选通时,光电二极管中由于光照产生的电荷传送到了列选择线,然后列选择线下端的积分放大器将该信号转化为电压输出,光电二极管中产生的电荷与光信号成一定的比例关系。无源像素具有单元结构简单、寻址简单、填充系数高、量子效率高等优点,但它灵敏度低、读出噪声大。因此PPS不利于向大型阵列发展,所以限制了应用,很快被APS代替。 图2 PPS像素结构图3 图像信号时序 (2)有源像素主动式传感器(APS) APS像素结构的基本电路如图4所示。从图上可以看出,场效应管V1构成光电二极管的负载,它的栅极接在复位信号线上,当复位脉冲出现时,V1导通,光电二极管被瞬时复位;而当复位脉冲消失后,V1截止,光电二极管开始积分光信号。图5为上述过程的时序图,其中,复位脉冲首先来到,V1导通,光电二极管复位;复位脉冲消失后,光电二极管进行积分;积分结束后,V3管导通,信号输出。 图4 APS像素结构图5 图像信号时序 (3)数字像素图像传感器(DPS) 上面提到的无源像素传感器和器和有源像素传感器的像素读出均为模拟信号,于是它们又通称为模拟像素传感器。近年来,美国斯坦福大学提出了一种新的CMOS图像传感器结构一数字像素传感器(DPS),在像素单元里集成了ADC (Analog-to-Digital Convertor)和存储单元[4]。由于这种结构的像素单元读出为 CMOS图像传感器原理与应用简介 摘要:本文介绍了CMOS图像传感器器件的原理、性能、优点、问题及应对措施,以及CMOS图像传感器的市场状况和一些应用领域。 Brief introduction of principle and applications of CMOS image sensor Abstract: This paper introduces the principle, performance, advantages also with the problems and solutions of CMOS image sensor. The market status and applications are also given in this essay. 北京航空航天大学李育琦1引言 图像传感器是将光信号转换为电信号的装置,在数字电视、可视通信市场中有着广泛的应用。60年代末期,美国贝尔实脸室发现电荷通过半导体势阱发生转移的现象,提出了固态成像这一新概念和一维CCD(Charge-Coupled Device电荷耦合器件)模型器件。到90年代初,CCD技术已比较成热,得到非常广泛的应用。但是随着CCD应用范围的扩大,其缺点逐渐暴露出来。首先,CCD技术芯片技术工艺复杂,不能与标准工艺兼容。其次,CCD技术芯片需要的电压功耗大,因此CCD技术芯片价格昂贵且使用不便。目前,最引人注目,最有发展潜力的是采用标准的CMOS(Complementary Metal Oxide Semiconductor 互补金属氧化物场效应管)技术来生产图像传感器,即CMOS图像传感器。CMOS图像传感器芯片采用了CMOS工艺,可将图像采集单元和信号处理单元集成到同一块芯片上。由于具有上述特点,它适合大规模批量生产,适用于要求小尺寸、低价格、摄像质量无过高要求的应用,如保安用小型、微型相机、手机、计算机网络视频会议系统、无线手持式视频会议系统、条形码扫描器、传真机、玩具、生物显微计数、某些车用摄像系统等大量商用领域。20世纪80年代,英国爱丁堡大学成功地制造出了世界上第一块单片CMOS图像传感器件。目前,CMOS图像传感器正在得到广泛的应用,具有很强地市场竞争力和广阔地发展前景。 2 CMOS图像传感器基本工作原理 CMOS图像传感器及噪声研究综述 宗宗 摘要 目前,图像传感器市场主要有CMOS图像传感器和CCD图像传感器。CCD图像传感器由于其较高的填充因子FF(Fill Factor)和较低的固定模式躁声FPN(Fix Pattern Noise)已经得到广泛的应用,但因其存在着多电压,高功耗,低速度,难与CMOS集成等缺点,限制了它的应用,特别是在要求低电压低功耗的移动设备中应用。CMOS图像传感器上世纪60年代就已经出现,但因工艺和技术原因,存在严重的噪声问题,性能不够完善严重影响图像质量还被废弃。但自20世纪90年代以来进人世纪年代,由于对小型化、低功耗和低成本成像系统消费需要的增加, 芯片制造技术和信号处理技术的发展,为新一代低噪声、优质图像和高彩色还原度的CMOS传感器的开发铺平了道路, CMOS传感器的性能因此大大提高, CMOS图像传感器成为固体图像传感器的研究开发热点。 但在光线较暗条件下,CMOS图像传感器的噪声问题比较突出,这与器件和工艺本身关系较大。对于CMOS图像传感器噪声的研究有助于解决其不足,以保证其优势可以发挥,无论是对噪声的抑制,还是对器件工艺改进的引导都有较大意义。图像传感器市场比较大,对于兴起的CMOS图像传感器研发也是具有实际意义的。 本综述首先对目前CMOS图像传感器所用的技术和原理进行了研究介绍,然 后分别从CMOS本身晶体管和光电二极管噪声研究和当前技术结构所拥有的噪声进行了研究介绍,最后自己分析了减小噪声的大致方向。 一CMOS图像传感器主流结构 CMOS图像传感器的概念最早出现在20世纪60年代,但当时由于大规模集成电路工艺的限制未能进行研究。普遍意义上的CMOS图像传感器的研究是从80年代早期开始,而从实验室走向产品化则是在90年代早期。CMOS图像传感器的研发大致经历了3个阶段:CMOS无源像素传感器(CMOS—PPS。Passive Pixel Sensor)阶段、CMOS有源像素传感器(CMOS—APS,Active Pixel Sensor)阶段和CMOS数字 像素传感器(CMOS—DPS,Digital Pixel Sensor)阶段。 图1 CMOS图像传感器像素结构 1.1 无源像素传感器 PPS像元结构简单、面积很小。所以在给定的单元尺寸下,可设计出最高的填充系数(FiFactor.FF 又称“孔径系数”,即像元中有效光敏单元面积与像元总面积之比);在给定的设计填充系数下,单元尺寸可设计的最小。并且,由于填充系数高和没有类似许多CCD中的多晶硅层叠,无源像素结构可获得较高的“量子效率”(即光生电子与入射光子数量之比),从而有利于提高器件的灵敏度。 但是这种结构存在着2个方面的不足:其一,各像元中开关管的导通阈值难以完全匹配,所以即使器件所接受的入射光线完全均匀一致,其输出信号仍会形 摄像头问题及解决办法汇总 一、名词解释 1.白平衡 白平衡指的是传感器对在光线不断变化环境下的色彩准确重现的能力表示。大多数拍照系统具有自动白平衡的功能,从而能在光线条件变化下自动改变白平衡值。设计工程师寻找的图像传感器应该配备了一个很好的自动白平衡(AWB)控制,从而提供正确的色彩重现。 2.动态范围 动态范围测量了图像传感器在同一张照片中同时捕获光明和黑暗物体的能力,通常定义为最亮信号与最暗信号(噪声门槛级别)比值的对数,通常用54dB来作为商业图像传感器的通用指标。具有较宽动态范围的图像传感器可以在明光环境下提供更好的性能(例如,使用较窄动态范围传感器在明光环境下拍出的照片会出现“水洗”或模糊的现象。) 3.工频干扰(Banding) Sensor在日光灯作为光源下获取图像数据时会产生flicker,其根本原因是照在不同pixel 上光能量不同产生的,所接受的光能量的不同也就是图像的亮度的不同。 由于CMOS sensor的曝光方式是一行一行的方式进行的,任何一个pixel的曝光时间是一样的,也就是同一行上的每个pixel的曝光开始点和曝光的时间都是一模一样的,所以同一行的所有点所接收到的能量是一样的,而在不同行之间虽然曝光时间都是一样的,但是曝光的开始点是不同的,所以不同行之间所接受到的能量是不一定相同的。 为了使不同行之间所接受的能量相同,就必须找一个特定的条件,使得每一行即使曝光开始点不同,但是所接受的光能量是相同的,这样就避开了flicker,这个特定的条件就是曝光时间必须是光能量周期的整数倍时间。 Banding由工频干扰引起,交流电光源都有光强的波动,在中国交流电频率是50Hz,光强的波动就是100Hz,周期10ms。如果camera曝光时间不是10ms的整数倍,那么在不同的感光面接收到的光能量一定不一样,体现在图像上就是有明暗条纹。 消除banding就得想办让曝光时间是10ms的整数倍!60Hz的交流电需要控制曝光时间为8.33ms的整数倍。 以50Hz为例说明,实现这个有两种办法: 1、设置曝光控制,强制为10ms整数倍变化,但是这样会浪费一部分曝光时间,导致曝光无法用满,在室内自然就会损失性能。 2、修改桢率,使每桢图像分到的时间是10ms的整数倍,则可以用满每桢曝光时间在,室内效果更好。修改桢率可以插入Dummy Line或者Dummy Pixel。这需要一点点计算,具体计算需要看sensor输出Timing。 例如把桢率设置为7.14fps,则每桢曝光时间是140ms。如果是15fps,则每桢曝光时间是66.66ms,如果强制曝光为10ms整数倍,最大即60ms,则有6.66ms无法参与曝光,损失性能。 具体调整桢率方法得和sensor的FAE沟通,每个sensor都可能不一样,不能一概而论。调整桢率还有个原则要注意,预览一般不能低于10fps,再低就很卡,常用14.3fps和12.5fps;抓拍不能低于5fps,否则用手就很难拍出清晰的照片,常用7.14fps。桢率是一个权衡折中CMOS图像传感器的基本结构

CMOS图像传感器简介

CMOS图像传感器基本原理与应用简介

CMOS图像传感器噪声综述

CMOS图像传感器调试问题汇总