实验二:决策树

要求:实现决策树分类算法,在两种不同的数据集上(iris.txt 和wine.txt)比较算法的性能。有趣的故事介绍一下决策树。[白话决策树模

型](https://www.doczj.com/doc/485812498.html,/shujuwajue/2441.html)

首先第一个数据集iris.txt。

iris数据集记录的是鸢尾植物。Scikit-learn自带了iris数据集。

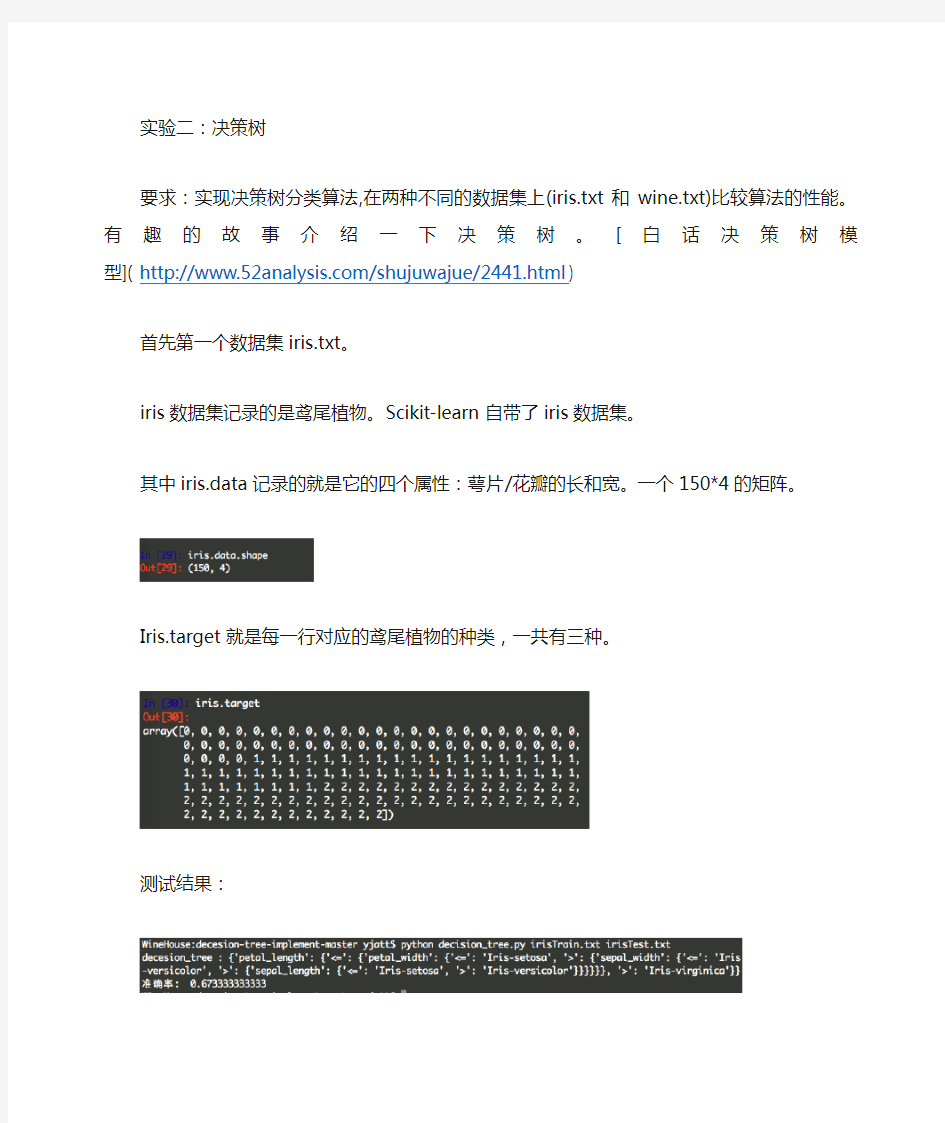

其中iris.data记录的就是它的四个属性:萼片/花瓣的长和宽。一个150*4的矩阵。

Iris.target就是每一行对应的鸢尾植物的种类,一共有三种。

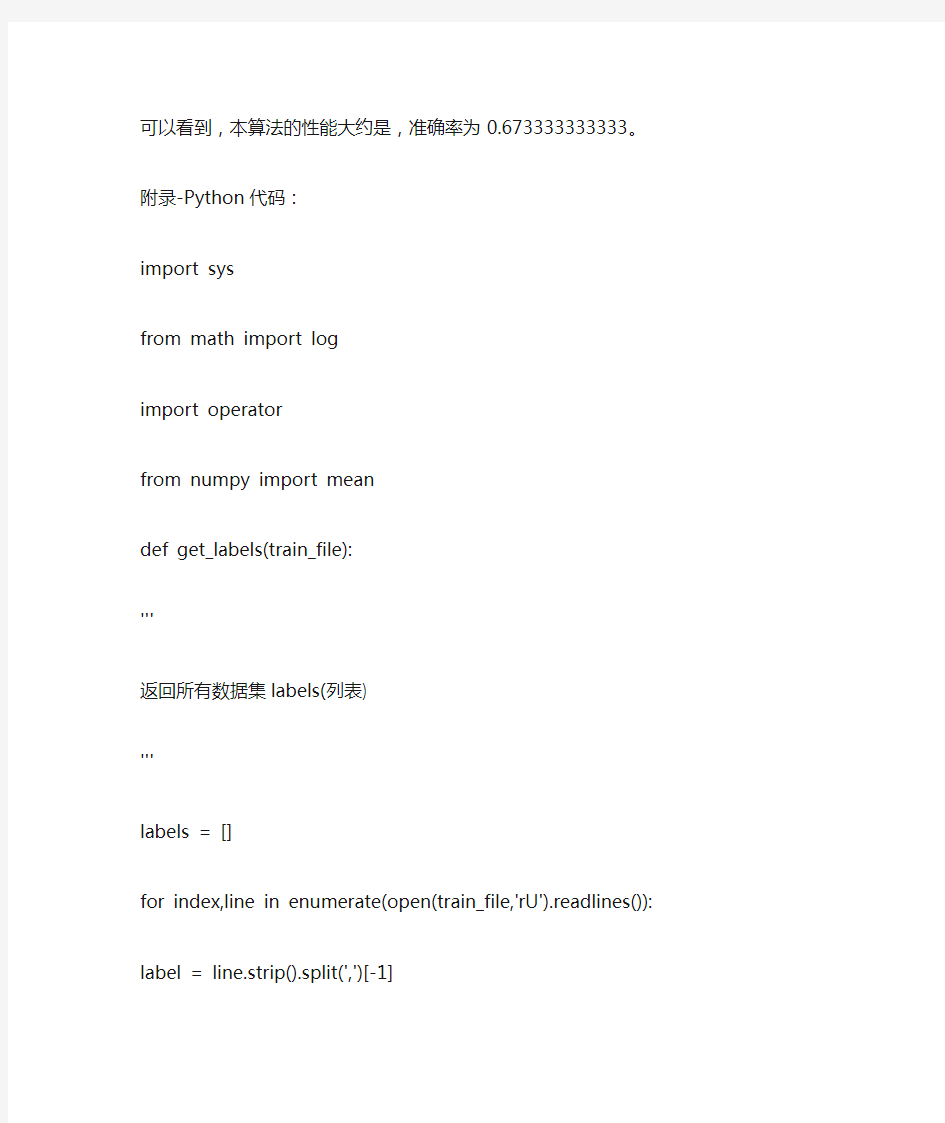

测试结果:

可以看到,本算法的性能大约是,准确率为0.673333333333。

附录-Python代码:

import sys

from math import log

import operator

from numpy import mean

def get_labels(train_file):

'''

返回所有数据集labels(列表)

'''

labels = []

for index,line in enumerate(open(train_file,'rU').readlines()):

label = line.strip().split(',')[-1]

labels.append(label)

return labels

def format_data(dataset_file):

'''

返回dataset(列表集合)和features(列表)

'''

dataset = []

for index,line in enumerate(open(dataset_file,'rU').readlines()):

line = line.strip()

fea_and_label = line.split(',')

dataset.append([float(fea_and_label[i]) for i in range(len(fea_and_label)-1)]+[fea_and_label[len(fea_and_label)-1]])

#features = [dataset[0][i] for i in range(len(dataset[0])-1)]

#sepal length(花萼长度)、sepal width(花萼宽度)、petal length(花瓣长度)、petal width(花瓣宽度)

features = ['sepal_length','sepal_width','petal_length','petal_width']

return dataset,features

def split_dataset(dataset,feature_index,labels):

'''

按指定feature划分数据集,返回四个列表:

@dataset_less:指定特征项的属性值<=该特征项平均值的子数据集

@dataset_greater:指定特征项的属性值>该特征项平均值的子数据集

@label_less:按指定特征项的属性值<=该特征项平均值切割后子标签集

@label_greater:按指定特征项的属性值>该特征项平均值切割后子标签集

'''

dataset_less = []

dataset_greater = []

label_less = []

label_greater = []

datasets = []

for data in dataset:

datasets.append(data[0:4])

mean_value = mean(datasets,axis = 0)[feature_index] #数据集在该特征项的所有取值的平均值

for data in dataset:

if data[feature_index] > mean_value:

dataset_greater.append(data)

label_greater.append(data[-1])

else:

dataset_less.append(data)

label_less.append(data[-1])

return dataset_less,dataset_greater,label_less,label_greater

def cal_entropy(dataset):

'''

计算数据集的熵大小

'''

n = len(dataset)

label_count = {}

for data in dataset:

label = data[-1]

if label_count.has_key(label):

label_count[label] += 1

else:

label_count[label] = 1

entropy = 0

for label in label_count:

prob = float(label_count[label])/n

entropy -= prob*log(prob,2)

#print 'entropy:',entropy

return entropy

def cal_info_gain(dataset,feature_index,base_entropy):

'''

计算指定特征对数据集的信息增益值

g(D,F) = H(D)-H(D/F) = entropy(dataset) -

sum{1,k}(len(sub_dataset)/len(dataset))*entropy(sub_dataset)

@base_entropy = H(D)

'''

datasets = []

for data in dataset:

datasets.append(data[0:4])

#print datasets

mean_value = mean(datasets,axis = 0)[feature_index] #计算指定特征的所有数据集值的平均值

#print mean_value

dataset_less = []

dataset_greater = []

for data in dataset:

if data[feature_index] > mean_value:

dataset_greater.append(data)

else:

dataset_less.append(data)

#条件熵 H(D/F)

condition_entropy = float(len(dataset_less))/len(dataset)*cal_entropy(dataset_less) + float(len(dataset_greater))/len(dataset)*cal_entropy(dataset_greater)

#print 'info_gain:',base_entropy - condition_entropy

return base_entropy - condition_entropy

def cal_info_gain_ratio(dataset,feature_index):

'''

计算信息增益比 gr(D,F) = g(D,F)/H(D)

'''

base_entropy = cal_entropy(dataset)

'''

if base_entropy == 0:

return 1

'''

info_gain = cal_info_gain(dataset,feature_index,base_entropy)

info_gain_ratio = info_gain/base_entropy

return info_gain_ratio

def choose_best_fea_to_split(dataset,features):

'''

根据每个特征的信息增益比大小,返回最佳划分数据集的特征索引'''

#base_entropy = cal_entropy(dataset)

split_fea_index = -1

max_info_gain_ratio = 0.0

for i in range(len(features)):

#info_gain = cal_info_gain(dataset,i,base_entropy)

#info_gain_ratio = info_gain/base_entropy

info_gain_ratio = cal_info_gain_ratio(dataset,i)

if info_gain_ratio > max_info_gain_ratio:

max_info_gain_ratio = info_gain_ratio

split_fea_index = i

return split_fea_index

def most_occur_label(labels):

'''

返回数据集中出现次数最多的label

'''

label_count = {}

for label in labels:

if label not in label_count.keys():

label_count[label] = 1

else:

label_count[label] += 1

sorted_label_count = sorted(label_count.iteritems(),key = operator.itemgetter(1),reverse = True)

return sorted_label_count[0][0]

def build_tree(dataset,labels,features):

'''

创建决策树

@dataset:训练数据集

@labels:数据集中包含的所有label(可重复)

@features:可进行划分的特征集

'''

#若数据集为空,返回NULL

if len(labels) == 0:

return 'NULL'

#若数据集中只有一种label,返回该label

if len(labels) == len(labels[0]):

return labels[0]

#若没有可划分的特征集,则返回数据集中出现次数最多的label

if len(features) == 0:

return most_occur_label(labels)

#若数据集趋于稳定,则返回数据集中出现次数最多的label

if cal_entropy(dataset) == 0:

return most_occur_label(labels)

split_feature_index = choose_best_fea_to_split(dataset,features)

split_feature = features[split_feature_index]

decesion_tree = {split_feature:{}}

#若划分特征的信息增益比小于阈值,则返回数据集中出现次数最多的label

if cal_info_gain_ratio(dataset,split_feature_index) < 0.3:

return most_occur_label(labels)

del(features[split_feature_index])

dataset_less,dataset_greater,labels_less,labels_greater =

split_dataset(dataset,split_feature_index,labels)

decesion_tree[split_feature]['<='] = build_tree(dataset_less,labels_less,features)

decesion_tree[split_feature]['>'] =

build_tree(dataset_greater,labels_greater,features)

return decesion_tree

def store_tree(decesion_tree,filename):

'''

把决策树以二进制格式写入文件

'''

import pickle

writer = open(filename,'w')

pickle.dump(decesion_tree,writer)

writer.close()

def read_tree(filename):

'''

从文件中读取决策树,返回决策树

'''

import pickle

reader = open(filename,'rU')

return pickle.load(reader)

def classify(decesion_tree,features,test_data,mean_values):

'''

对测试数据进行分类, decesion_tree : {'petal_length': {'<=': {'petal_width': {'<=':

'Iris-setosa', '>': {'sepal_width': {'<=': 'Iris-versicolor', '>': {'sepal_length': {'<=': 'Iris-setosa', '>': 'Iris-versicolor'}}}}}}, '>': 'Iris-virginica'}}

'''

first_fea = decesion_tree.keys()[0]

fea_index = features.index(first_fea)

if test_data[fea_index] <= mean_values[fea_index]:

sub_tree = decesion_tree[first_fea]['<=']

if type(sub_tree) == dict:

return classify(sub_tree,features,test_data,mean_values)

else:

return sub_tree

else:

sub_tree = decesion_tree[first_fea]['>']

if type(sub_tree) == dict:

return classify(sub_tree,features,test_data,mean_values)

else:

return sub_tree

def get_means(train_dataset):

'''

获取训练数据集各个属性的数据平均值

'''

dataset = []

for data in train_dataset:

dataset.append(data[0:4])

mean_values = mean(dataset,axis = 0) #数据集在该特征项的所有取值的平均值return mean_values

def run(train_file,test_file):

'''

主函数

'''

labels = get_labels(train_file)

train_dataset,train_features = format_data(train_file)

decesion_tree = build_tree(train_dataset,labels,train_features)

print 'decesion_tree :',decesion_tree

store_tree(decesion_tree,'decesion_tree')

mean_values = get_means(train_dataset)

test_dataset,test_features = format_data(test_file)

n = len(test_dataset)

correct = 0

for test_data in test_dataset:

label = classify(decesion_tree,test_features,test_data,mean_values)

#print 'classify_label correct_label:',label,test_data[-1]

if label == test_data[-1]:

correct += 1

print "准确率: ",correct/float(n)

#############################################################

if __name__ == '__main__':

if len(sys.argv) != 3:

print "please use: python decision.py train_file test_file"

sys.exit()

train_file = sys.argv[1]

test_file = sys.argv[2]

run(train_file,test_file)

《数据挖掘》Weka实验报告 姓名_学号_ 指导教师 开课学期2015 至2016 学年 2 学期完成日期2015年6月12日

1.实验目的 基于https://www.doczj.com/doc/485812498.html,/ml/datasets/Breast+Cancer+WiscOnsin+%28Ori- ginal%29的数据,使用数据挖掘中的分类算法,运用Weka平台的基本功能对数据集进行分类,对算法结果进行性能比较,画出性能比较图,另外针对不同数量的训练集进行对比实验,并画出性能比较图训练并测试。 2.实验环境 实验采用Weka平台,数据使用来自https://www.doczj.com/doc/485812498.html,/ml/Datasets/Br- east+Cancer+WiscOnsin+%28Original%29,主要使用其中的Breast Cancer Wisc- onsin (Original) Data Set数据。Weka是怀卡托智能分析系统的缩写,该系统由新西兰怀卡托大学开发。Weka使用Java写成的,并且限制在GNU通用公共证书的条件下发布。它可以运行于几乎所有操作平台,是一款免费的,非商业化的机器学习以及数据挖掘软件。Weka提供了一个统一界面,可结合预处理以及后处理方法,将许多不同的学习算法应用于任何所给的数据集,并评估由不同的学习方案所得出的结果。 3.实验步骤 3.1数据预处理 本实验是针对威斯康辛州(原始)的乳腺癌数据集进行分类,该表含有Sample code number(样本代码),Clump Thickness(丛厚度),Uniformity of Cell Size (均匀的细胞大小),Uniformity of Cell Shape (均匀的细胞形状),Marginal Adhesion(边际粘连),Single Epithelial Cell Size(单一的上皮细胞大小),Bare Nuclei(裸核),Bland Chromatin(平淡的染色质),Normal Nucleoli(正常的核仁),Mitoses(有丝分裂),Class(分类),其中第二项到第十项取值均为1-10,分类中2代表良性,4代表恶性。通过实验,希望能找出患乳腺癌客户各指标的分布情况。 该数据的数据属性如下: 1. Sample code number(numeric),样本代码; 2. Clump Thickness(numeric),丛厚度;

实验三:基于Weka 进行关联规则挖掘 实验步骤 1.利用Weka对数据集contact-lenses.arff进行Apriori关联规则挖掘。要求: 描述数据集;解释Apriori 算法及流程;解释Weka 中有关Apriori 的参数;解释输出结果 Apriori 算法: 1、发现频繁项集,过程为 (1)扫描 (2)计数 (3)比较 (4)产生频繁项集 (5)连接、剪枝,产生候选项集 (6)重复步骤(1)~(5)直到不能发现更大的频集 2、产生关联规则 (1)对于每个频繁项集L,产生L的所有非空子集; (2)对于L的每个非空子集S,如果 P(L)/P(S)≧min_conf(最小置信度阈值) 则输出规则“S=>L-S” Weka 中有关Apriori 的参数:

1. car 如果设为真,则会挖掘类关联规则而不是全局关联规则。 2. classindex 类属性索引。如果设置为-1,最后的属性被当做类属性。 3.delta 以此数值为迭代递减单位。不断减小支持度直至达到最小支持度或产生了满足数量要求的规则。 4. lowerBoundMinSupport 最小支持度下界。 5. metricType 度量类型。设置对规则进行排序的度量依据。可以是:置信度(类关联规则只能用置信度挖掘),提升度(lift),杠杆率(leverage),确信度(conviction)。 在Weka中设置了几个类似置信度(confidence)的度量来衡量规则的关联程度,它们分别是: a)Lift :P(A,B)/(P(A)P(B)) Lift=1时表示A和B独立。这个数越大(>1),越表明A和B存在于一个购物篮中不是偶然现象,有较强的关联度. b)Leverage :P(A,B)-P(A)P(B) Leverage=0时A和B独立,Leverage越大A和B的关系越密切

数据挖掘实验报告(一) 数据预处理 姓名:李圣杰 班级:计算机1304 学号:1311610602

一、实验目的 1.学习均值平滑,中值平滑,边界值平滑的基本原理 2.掌握链表的使用方法 3.掌握文件读取的方法 二、实验设备 PC一台,dev-c++5.11 三、实验内容 数据平滑 假定用于分析的数据包含属性age。数据元组中age的值如下(按递增序):13, 15, 16, 16, 19, 20, 20, 21, 22, 22, 25, 25, 25, 25, 30, 33, 33, 35, 35, 35, 35, 36, 40, 45, 46, 52, 70。使用你所熟悉的程序设计语言进行编程,实现如下功能(要求程序具有通用性): (a) 使用按箱平均值平滑法对以上数据进行平滑,箱的深度为3。 (b) 使用按箱中值平滑法对以上数据进行平滑,箱的深度为3。 (c) 使用按箱边界值平滑法对以上数据进行平滑,箱的深度为3。 四、实验原理 使用c语言,对数据文件进行读取,存入带头节点的指针链表中,同时计数,均值求三个数的平均值,中值求中间的一个数的值,边界值将中间的数转换为离边界较近的边界值 五、实验步骤 代码 #include

前言 “啤酒与尿布”的故事是营销届的神话,“啤酒”和“尿布”两个看上去没有关系的商品摆放在一起进行销售、并获得了很好的销售收益,这种现象就是卖场中商品之间的关联性,研究“啤酒与尿布”关联的方法就是购物篮分析,购物篮分析曾经是沃尔玛秘而不宣的独门武器,购物篮分析可以帮助我们在门店的销售过程中找到具有关联关系的商品,并以此获得销售收益的增长! 商品相关性分析是购物篮分析中最重要的部分,购物篮分析英文名为market basket analysis(简称MBA,当然这可不是那个可以用来吓人的学位名称)。在数据分析行业,将购物篮的商品相关性分析称为“数据挖掘算法之王”,可见购物篮商品相关性算法吸引人的地方,这也正是我们小组乐此不疲的围绕着购物篮分析进行着研究和探索的根本原因。 购物篮分析的算法很多,比较常用的有A prior/ ?’ p r i ?/算法、FP-tree结构和相应的FP-growth算法等等,上次课我们组的邓斌同学已经详细的演示了购物篮分析的操作流程,因此在这里我不介绍具体的购物篮分析算法,而是在已经获得的结果的基础上剖析一下数据身后潜藏的商业信息。目前购物篮分析的计算方法都很成熟,在进入20世纪90年代后,很多分析软件均将一些成熟的购物篮分析算法打包在自己的软件产品中,成为了软件产品的组成部分,客户购买了这些软件产品后就等于有了购物篮分析的工具,比如我们正在使用的Clementine。 缘起 “啤酒与尿布”的故事可以说是营销界的经典段子,在打开Google搜索一下,你会发现很多人都在津津乐道于“啤酒与尿布”,可以说100个人就有100个版本的“啤酒与尿布”的故事。故事的时间跨度从上个世纪80年代到本世纪初,甚至连故事的主角和地点都会发生变化——从美国跨越到欧洲。认真地查了一下资料,我们发现沃尔玛的“啤酒与尿布”案例是正式刊登在1998年的《哈佛商业评论》上面的,这应该算是目前发现的最权威报道。 “啤酒与尿布”的故事产生于20世纪90年代的美国沃尔玛超市中,沃尔玛的超市管理人员分析销售数据时发现了一个令人难于理解的现象:在某些特定的情况下,“啤酒”与“尿布”两件看上去毫无关系的商品会经常出现在同一个购物篮中,这种独特的销售现象引起了管理人员的注意,经过后续调查发现,这种现象出现在年轻的父亲身上。 在美国有婴儿的家庭中,一般是母亲在家中照看婴儿,年轻的父亲前去超市购买尿布。父亲在购买尿布的同时,往往会顺便为自己购买啤酒,这样就会出现啤酒与尿布这两件看上去不相干的商品经常会出现在同一个购物篮的现象。如果这个年轻的父亲在卖场只能买到两件商品之一,则他很有可能会放弃购物而到另一家商店,直到可以一次同时买到啤酒与尿布为止。沃尔玛发现了这一独特的现象,开始在卖场尝试将啤酒与尿布摆放在相同的区域,让年轻的父亲可以同时找到这两件商品,并很快地完成购物;而沃尔玛超市也可以让这些客户一次购买两件商品、而不是一件,从而获得了很好的商品销售收入,这就是“啤酒与尿布”故事的由来。 当然“啤酒与尿布”的故事必须具有技术方面的支持。1993年美国学者Agrawal (个人翻译--艾格拉沃)提出通过分析购物篮中的商品集合,从而找出商品之间关联关系的关联算法,并根据商品之间的关系,找出客户的购买行为。艾格拉沃从数学及计算机算法角度提出了商品关联关系的计算方法——A prior算法。沃尔玛从上个世纪90年代尝试将A prior算法引入到POS机数据分析中,并获得了成功,于是产生了“啤酒与尿布”的故事。 “啤酒和尿布”的故事为什么产生于沃尔玛超市的卖场中

大数据理论与技术读书报告 -----K最近邻分类算法 指导老师: 陈莉 学生姓名: 李阳帆 学号: 201531467 专业: 计算机技术 日期 :2016年8月31日

摘要 数据挖掘是机器学习领域内广泛研究的知识领域,是将人工智能技术和数据库技术紧密结合,让计算机帮助人们从庞大的数据中智能地、自动地提取出有价值的知识模式,以满足人们不同应用的需要。K 近邻算法(KNN)是基于统计的分类方法,是大数据理论与分析的分类算法中比较常用的一种方法。该算法具有直观、无需先验统计知识、无师学习等特点,目前已经成为数据挖掘技术的理论和应用研究方法之一。本文主要研究了K 近邻分类算法,首先简要地介绍了数据挖掘中的各种分类算法,详细地阐述了K 近邻算法的基本原理和应用领域,最后在matlab环境里仿真实现,并对实验结果进行分析,提出了改进的方法。 关键词:K 近邻,聚类算法,权重,复杂度,准确度

1.引言 (1) 2.研究目的与意义 (1) 3.算法思想 (2) 4.算法实现 (2) 4.1 参数设置 (2) 4.2数据集 (2) 4.3实验步骤 (3) 4.4实验结果与分析 (3) 5.总结与反思 (4) 附件1 (6)

1.引言 随着数据库技术的飞速发展,人工智能领域的一个分支—— 机器学习的研究自 20 世纪 50 年代开始以来也取得了很大进展。用数据库管理系统来存储数据,用机器学习的方法来分析数据,挖掘大量数据背后的知识,这两者的结合促成了数据库中的知识发现(Knowledge Discovery in Databases,简记 KDD)的产生,也称作数据挖掘(Data Ming,简记 DM)。 数据挖掘是信息技术自然演化的结果。信息技术的发展大致可以描述为如下的过程:初期的是简单的数据收集和数据库的构造;后来发展到对数据的管理,包括:数据存储、检索以及数据库事务处理;再后来发展到对数据的分析和理解, 这时候出现了数据仓库技术和数据挖掘技术。数据挖掘是涉及数据库和人工智能等学科的一门当前相当活跃的研究领域。 数据挖掘是机器学习领域内广泛研究的知识领域,是将人工智能技术和数据库技术紧密结合,让计算机帮助人们从庞大的数据中智能地、自动地抽取出有价值的知识模式,以满足人们不同应用的需要[1]。目前,数据挖掘已经成为一个具有迫切实现需要的很有前途的热点研究课题。 2.研究目的与意义 近邻方法是在一组历史数据记录中寻找一个或者若干个与当前记录最相似的历史纪录的已知特征值来预测当前记录的未知或遗失特征值[14]。近邻方法是数据挖掘分类算法中比较常用的一种方法。K 近邻算法(简称 KNN)是基于统计的分类方法[15]。KNN 分类算法根据待识样本在特征空间中 K 个最近邻样本中的多数样本的类别来进行分类,因此具有直观、无需先验统计知识、无师学习等特点,从而成为非参数分类的一种重要方法。 大多数分类方法是基于向量空间模型的。当前在分类方法中,对任意两个向量: x= ) ,..., , ( 2 1x x x n和) ,..., , (' ' 2 ' 1 'x x x x n 存在 3 种最通用的距离度量:欧氏距离、余弦距 离[16]和内积[17]。有两种常用的分类策略:一种是计算待分类向量到所有训练集中的向量间的距离:如 K 近邻选择K个距离最小的向量然后进行综合,以决定其类别。另一种是用训练集中的向量构成类别向量,仅计算待分类向量到所有类别向量的距离,选择一个距离最小的类别向量决定类别的归属。很明显,距离计算在分类中起关键作用。由于以上 3 种距离度量不涉及向量的特征之间的关系,这使得距离的计算不精确,从而影响分类的效果。

SAS 8.2 Enterprise Miner数据挖掘实例 目录 1.SAS 8.2 Enterprise Miner简介 (2) 2.EM工具具体使用说明 (2) 3.定义商业问题 (3) 4.创建一个工程 (4) 4.1调用EM (4) 4.2新建一个工程 (5) 4.3应用工作空间中的节点 (6) 5.数据挖掘工作流程 (6) 5.1定义数据源 (6) 5.2探索数据 (8) 5.2.1设置Insight节点 (8) 5.2.2察看Insight节点输出结果 (9) 5.3准备建模数据 (11) 5.3.1建立目标变量 (11) 5.3.2设置目标变量 (13) 5.3.3数据分割 (21) 5.3.4替换缺失值 (22) 5.4建模 (23) 5.4.1回归模型 (23) 5.4.2决策树模型 (25) 5.5评估模型 (28) 5.6应用模型 (30) 5.6.1抽取打分程序 (30) 5.6.2引入原始数据源 (31) 5.6.3查看结果 (32) 6.参考文献: (34)

1.SAS 8.2 Enterprise Miner简介 数据挖掘就是对观测到的庞大数据集进行分析,目的是发现未知的关系和以数据拥有者可以理解并对其有价值的新颖方式来总结数据。[1] 一个数据挖掘工程需要足够的软件来完成分析工作,为了计划、实现和成功建立一个数据挖掘工程,需要一个集成了所有分析阶段的软件解决方案,包括从数据抽样到分析和建模,最后公布结果信息。大部分专业统计数据分析软件只实现特定的数据挖掘技术,而SAS 8.2 Enterprise Miner是一个集成的数据挖掘系统,允许使用和比较不同的技术,同时还集成了复杂的数据库管理软件。SAS 8.2 Enterprise Miner把统计分析系统和图形用户界面(GUI)集成在一起,并与SAS协会定义的数据挖掘方法——SEMMA方法,即抽样(Sample)、探索(Explore)、修改(Modify)建模(Model)、评价(Assess)紧密结合,对用户友好、直观、灵活、适用方便,使对统计学无经验的用户也可以理解和使用。 Enterprise Miner简称EM,它的运行方式是通过在一个工作空间(workspace)中按照一定的顺序添加各种可以实现不同功能的节点,然后对不同节点进行相应的设置,最后运行整个工作流程(workflow),便可以得到相应的结果。 2.EM工具具体使用说明 EM中工具分为七类: ?Sample类包含Input Data Source、Sampling、Data Partition ?Explore类包含Distribution Explorer、Multiplot、Insight、 Association、Variable Selection、Link Analysis (Exp.) ?Modify类包含Data Set Attribute、Transform Variable、Filter Outliers、Replacement、Clustering、SOM/Kohonen、 Time Series(Exp.) ?Medel类包括Regression、Tree、Neural Network、 Princomp/Dmneural、User Defined Model、Ensemble、 Memory-Based Reasoning、Two Stage Model ?Assess类包括Assessment、Reporter

《商务数据分析》实验指导书(适用于国际经济与贸易专业) 江西财经大学国际经贸学院 编写人:戴爱明

目录 前言 (1) 实验一、SPSS Clementine 软件功能演练 (5) 实验二、SPSS Clementine 数据可视化 (9) 实验三、决策树C5.0 建模 (17) 实验四、关联规则挖掘 (30) 实验五、聚类分析(异常值检测) (38)

前言 一、课程简介 商务数据分析充分利用数据挖掘技术从大量商务数据中获取有效的、新颖的、潜在有用的、最终可理解的模式的非平凡过程。数据挖掘的广义观点:数据挖掘就是从存放在数据库,数据仓库或其他信息库中的大量的数据中“挖掘”有趣知识的过程。数据挖掘,又称为数据库中知识发现(Knowledge Discovery in Database, KDD),因此,数据挖掘和数据仓库的协同工作,一方面,可以迎合和简化数据挖掘过程中的重要步骤,提高数据挖掘的效率和能力,确保数据挖掘中数据来源的广泛性和完整性。另一方面,数据挖掘技术已经成为数据仓库应用中极为重要和相对独立的方面和工具。 数据挖掘有机结合了来自多学科技术,其中包括:数据库、数理统计、机器学习、高性能计算、模式识别、神经网络、数据可视化、信息检索、图像与信号处理、空间数据分析等,这里我们强调商务数据分析所处理的是大规模数据,且其算法应是高效的和可扩展的。通过数据分析,可从数据库中挖掘出有意义的知识、规律,或更高层次的信息,并可以从多个角度对其进行浏览察看。所挖掘出的知识可以帮助进行商务决策支持。当前商务数据分析应用主要集中在电信、零售、农业、网络日志、银行等方面。

昆明理工大学信息工程与自动化学院学生实验报告 (2012 —2013 学年第 1 学期) 课程名称:数据库仓库与数据挖掘开课实验室: 2012 年10月 30日 一、上机目的 1.理解数据库与数据仓库之间的区别与联系; 2.掌握典型的关系型数据库及其数据仓库系统的工作原理以及应用方法; 3.掌握数据仓库建立的基本方法及其相关工具的使用。 二、上机内容 内容:以SQL Server为系统平台,设计、建立数据库,并以此为基础创建数据仓库。 要求:利用实验室和指导教师提供的实验软件,认真完成规定的实验项目,真实地记录实验中遇到的各种问题和解决的方法与过程,并绘出模拟实验案例的数据仓库模型。实验完成后,应根据实验情况写出实验报告。 三、所用仪器、材料(设备名称、型号、规格等或使用软件) 1台PC及SQL 2008软件 四、实验方法、步骤和截图(或:程序代码或操作过程) 采用SQL语句创建数据库,数据库命名为:DW。如图所示:

DW数据库中包含7张维表和一张事实表。7张维表分别为:订单方式维表、销售人员及销售地区维表、发货方式维表、订单日期维表、客户维表、订单状态维表、客户价值维表。建立7张维表语句和建立7张维表的ETL如下: 语句执行成功的结果如图所示:

DW数据库包含的事实表为FACT_SALEORDER。建立1张事实表语句和建立1张事实表的ETL如下: 三、建事实表 CREATE TABLE FACT_SALEORDER( SALEORDERID INT, TIME_CD V ARCHAR(8), STATUS INT, ONLINEORDERFLAG INT, CUSTOMERID INT, SALESPERSONID INT, SHIPMETHOD INT, ORDER_V ALUES INT, SUBTOTAL DECIMAL(10,2), TAXAMT DECIMAL(10,2), FREIGHT DECIMAL(10,2)) ----------------------------------- 四、事实表的ETL /* FACT_SALEORDER的ETL*/ TRUNCATE TABLE FACT_SALEORDER INSERT INTO FACT_SALEORDER SELECT SalesOrderID,CONVERT(CHAR(8),,112) , ,,ISNULL,0),ISNULL,0),,,,, FROM A, V_SUBTOTAL_V ALUES B WHERE >= AND <

哈尔滨工业大学 数据挖掘理论与算法实验报告(2016年度秋季学期) 课程编码S1300019C 授课教师邹兆年 学生姓名汪瑞 学号 16S003011 学院计算机学院

一、实验内容 决策树算法是一种有监督学习的分类算法;kmeans是一种无监督的聚类算法。 本次实验实现了以上两种算法。在决策树算法中采用了不同的样本划分方式、不同的分支属性的选择标准。在kmeans算法中,比较了不同初始质心产生的差异。 本实验主要使用python语言实现,使用了sklearn包作为实验工具。 二、实验设计 1.决策树算法 1.1读取数据集 本次实验主要使用的数据集是汽车价值数据。有6个属性,命名和属性值分别如下: buying: vhigh, high, med, low. maint: vhigh, high, med, low. doors: 2, 3, 4, 5more. persons: 2, 4, more. lug_boot: small, med, big. safety: low, med, high. 分类属性是汽车价值,共4类,如下: class values:unacc, acc, good, vgood 该数据集不存在空缺值。

由于sklearn.tree只能使用数值数据,因此需要对数据进行预处理,将所有标签类属性值转换为整形。 1.2数据集划分 数据集预处理完毕后,对该数据进行数据集划分。数据集划分方法有hold-out法、k-fold交叉验证法以及有放回抽样法(boottrap)。 Hold—out法在pthon中的实现是使用如下语句: 其中,cv是sklearn中cross_validation包,train_test_split 方法的参数分别是数据集、数据集大小、测试集所占比、随机生成方法的可

1.前言 随着中国加入WTO,国金融市场正在逐步对外开放,外资金融企业的进入在带来先进经营理念的同时,无疑也加剧了中国金融市场的竞争。金融业正在快速发生变化。合并、收购和相关法规的变化带来了空前的机会,也为金融用户提供了更多的选择。节约资金、更完善的服务诱使客户转投到竞争对手那里。即便是网上银行也面临着吸引客户的问题,最有价值的客户可能正离您而去,而您甚至还没有觉察。在这样一种复杂、激烈的竞争环境下,如何才能吸引、增加并保持最好的客户呢? 数据挖掘、模式(Patterns>等形式。用统计分析和数据挖掘解决商务问题。 金融业分析方案可以帮助银行和保险业客户进行交叉销售来增加销售收入、对客户进行细分和细致的行为描述来有效挽留有价值客户、提高市场活动的响应效果、降低市场推广成本、达到有效增加客户数量的目的等。 客户细分―使客户收益最大化的同时最大程度降低风险 市场全球化和购并浪潮使市场竞争日趋激烈,新的管理需求迫切要求金融机构实现业务革新。为在激烈的竞争中脱颖而出,业界领先的金融服务机构正纷纷采用成熟的统计分析和数据挖掘技术,来获取有价值的客户,提高利润率。他们在分析客户特征和产品特征的同时,实现客户细分和市场细分。 数据挖掘实现客户价值的最大化和风险最小化。SPSS预测分析技术能够适应用于各种金融服务,采用实时的预测分析技术,分析来自各种不同数据源-来自ATM、交易、呼叫中心以及相关分支机构的客户数据。采用各种分析技术,发现数据中的潜在价值,使营销活动更具有针对性,提高营销活动的市场回应率,使营销费用优化配置。 客户流失―挽留有价值的客户 在银行业和保险业,客户流失也是一个很大的问题。例如,抵押放款公司希望知道,自己的哪些客户会因为竞争对手采用低息和较宽松条款的手段而流失;保险公司则希望知道如何才能减少取消保单的情况,降低承包成本。 为了留住最有价值的客户,您需要开展有效的保留活动。然而,首先您需要找出最有价值的客户,理解他们的行为。可以在整个客户群的很小一部分中尽可能多地找出潜在的流失者,从而进行有效的保留活动并降低成本。接着按照客户的价值和流失倾向给客户排序,找出最有价值的客户。 交叉销售 在客户关系管理中,交叉销售是一种有助于形成客户对企业忠诚关系的重要工具,有助于企业避开“挤奶式”的饱和竞争市场。由于客户从企业那里获得更多的产品和服务,客户与企业的接触点也就越多,企业就越有机会更深入地了解客户的偏好和购买行为,因此,企业提高满足客户需求的能力就比竞争对手更有效。 研究表明,银行客户关系的年限与其使用的服务数目、银行每个账户的利润率之间,存在着较强的正相关性。企业通过对现有客户进行交叉销售,客户使用企业的服务数目就会增多,客户使用银行服务的年限就会增大,每个客户的利润率也随着增大。 从客户的交易数据和客户的自然属性中寻找、选择最有可能捆绑在一起销售的产品和服务,发现有价值的产品和服务组合,从而有效地向客户提供额外的服务,提高活期收入并提升客户的收益率。

实验三 一、实验原理 K-Means算法是一种 cluster analysis 的算法,其主要是来计算数据聚集的算法,主要通过不断地取离种子点最近均值的算法。 在数据挖掘中,K-Means算法是一种cluster analysis的算法,其主要是来计算数据聚集的算法,主要通过不断地取离种子点最近均值的算法。 算法原理: (1) 随机选取k个中心点; (2) 在第j次迭代中,对于每个样本点,选取最近的中心点,归为该类; (3) 更新中心点为每类的均值; (4) j<-j+1 ,重复(2)(3)迭代更新,直至误差小到某个值或者到达一定的迭代步 数,误差不变. 空间复杂度o(N) 时间复杂度o(I*K*N) 其中N为样本点个数,K为中心点个数,I为迭代次数 二、实验目的: 1、利用R实现数据标准化。 2、利用R实现K-Meams聚类过程。 3、了解K-Means聚类算法在客户价值分析实例中的应用。 三、实验内容 依据航空公司客户价值分析的LRFMC模型提取客户信息的LRFMC指标。对其进行标准差标准化并保存后,采用k-means算法完成客户的聚类,分析每类的客户特征,从而获得每类客户的价值。编写R程序,完成客户的k-means聚类,获得聚类中心与类标号,并统计每个类别的客户数

四、实验步骤 1、依据航空公司客户价值分析的LRFMC模型提取客户信息的LRFMC指标。

2、确定要探索分析的变量 3、利用R实现数据标准化。 4、采用k-means算法完成客户的聚类,分析每类的客户特征,从而获得每类客户的价值。

五、实验结果 客户的k-means聚类,获得聚类中心与类标号,并统计每个类别的客户数 六、思考与分析 使用不同的预处理对数据进行变化,在使用k-means算法进行聚类,对比聚类的结果。 kmenas算法首先选择K个初始质心,其中K是用户指定的参数,即所期望的簇的个数。 这样做的前提是我们已经知道数据集中包含多少个簇. 1.与层次聚类结合 经常会产生较好的聚类结果的一个有趣策略是,首先采用层次凝聚算法决定结果

实验一 ID3算法实现 一、实验目的 通过编程实现决策树算法,信息增益的计算、数据子集划分、决策树的构建过程。加深对相关算法的理解过程。 实验类型:验证 计划课间:4学时 二、实验内容 1、分析决策树算法的实现流程; 2、分析信息增益的计算、数据子集划分、决策树的构建过程; 3、根据算法描述编程实现算法,调试运行; 4、对所给数据集进行验算,得到分析结果。 三、实验方法 算法描述: 以代表训练样本的单个结点开始建树; 若样本都在同一个类,则该结点成为树叶,并用该类标记; 否则,算法使用信息增益作为启发信息,选择能够最好地将样本分类的属性; 对测试属性的每个已知值,创建一个分支,并据此划分样本; 算法使用同样的过程,递归形成每个划分上的样本决策树 递归划分步骤,当下列条件之一成立时停止: 给定结点的所有样本属于同一类; 没有剩余属性可以进一步划分样本,在此情况下,采用多数表决进行 四、实验步骤 1、算法实现过程中需要使用的数据结构描述: Struct {int Attrib_Col; // 当前节点对应属性 int Value; // 对应边值 Tree_Node* Left_Node; // 子树 Tree_Node* Right_Node // 同层其他节点 Boolean IsLeaf; // 是否叶子节点 int ClassNo; // 对应分类标号 }Tree_Node; 2、整体算法流程

主程序: InputData(); T=Build_ID3(Data,Record_No, Num_Attrib); OutputRule(T); 释放内存; 3、相关子函数: 3.1、 InputData() { 输入属性集大小Num_Attrib; 输入样本数Num_Record; 分配内存Data[Num_Record][Num_Attrib]; 输入样本数据Data[Num_Record][Num_Attrib]; 获取类别数C(从最后一列中得到); } 3.2、Build_ID3(Data,Record_No, Num_Attrib) { Int Class_Distribute[C]; If (Record_No==0) { return Null } N=new tree_node(); 计算Data中各类的分布情况存入Class_Distribute Temp_Num_Attrib=0; For (i=0;i 四大经典大数据应用案例解析 什么是数据挖掘(Data Mining)?简而言之,就是有组织有目的地收集数据,通过分析数据使之成为信息,从而在大量数据中寻找潜在规律以形成规则或知识的技术。在本文中,我们从数据挖掘的实例出发,并以数据挖掘中比较经典的分类算法入手,给读者介绍我们怎样利用数据挖掘的技术解决现实中出现的问题。 数据挖掘是如何解决问题的? 本节通过几个数据挖掘实际案例来诠释如何通过数据挖掘解决商业中遇到的问题。下面关于“啤酒和尿不湿”的故事是数据挖掘中最经典的案例。而Target 公司通过“怀孕预测指数”来预测女顾客是否怀孕的案例也是近来为数据挖掘学者最津津乐道的一个话题。 一、尿不湿和啤酒 很多人会问,究竟数据挖掘能够为企业做些什么?下面我们通过一个在数据挖掘中最经典的案例来解释这个问题——一个关于尿不湿与啤酒的故事。超级商业零售连锁巨无霸沃尔玛公司(Wal Mart)拥有世上最大的数据仓库系统之一。为了能够准确了解顾客在其门店的购买习惯,沃尔玛对其顾客的购物行为进行了购物篮关联规则分析,从而知道顾客经常一起购买的商品有哪些。在沃尔玛庞大的数据仓库里集合了其所有门店的详细原始交易数据,在这些原始交易数据的基础上,沃尔玛利用数据挖掘工具对这些数据进行分析和挖掘。一个令人惊奇和意外的结果出现了:“跟尿不湿一起购买最多的商品竟是啤酒”!这是数据挖掘技术对历史数据进行分析的结果,反映的是数据的内在规律。那么这个结果符合现实情况吗?是否是一个有用的知识?是否有利用价值? 为了验证这一结果,沃尔玛派出市场调查人员和分析师对这一结果进行调查分析。经过大量实际调查和分析,他们揭示了一个隐藏在“尿不湿与啤酒”背后的美国消费者的一种行为模式: 在美国,到超市去买婴儿尿不湿是一些年轻的父亲下班后的日常工作,而他们中有30%~40%的人同时也会为自己买一些啤酒。产生这一现象的原因是:美国的太太们常叮嘱她们的丈夫不要忘了下班后为小孩买尿不湿,而丈夫们在买尿不湿后又随手带回了他们喜欢的啤酒。另一种情况是丈夫们在买啤酒时突然记起他们的责任,又去买了尿不湿。既然尿不湿与啤酒一起被购买的机会很多,那么沃尔玛就在他们所有的门店里将尿不湿与啤酒并排摆放在一起,结果是得到了尿不湿与啤酒的销售量双双增长。按常规思维,尿不湿与啤酒风马牛不相及,若不是 实验三设计并构造AdventureWorks数据仓库实例 【实验要求】 在SQL Server 平台上,利用AdventureWorks数据库作为商业智能解决方案的数据源,设计并构造数据仓库,建立OLAP和数据挖掘模型,并以输出报表的形式满足决策支持的查询需求。 【实验内容】 步骤1:需求分析:以决策者的视角分析和设计数据仓库的需求; 步骤2:根据所设计的需求,确定本数据仓库的主题和主题与边界; 步骤3:设计并构造逻辑模型; 步骤4:进行数据转换和抽取,建立数据仓库:创建数据源,,建立OLAP和挖掘模型,使用多维数据集进行分析,建立数据挖掘结构和数据挖掘模型,创建报表。 【实验平台】 Win7操作系统,SQL Server 2005 【实验过程】 一、创建Analysis Services 项目 1.打开Business Intelligence Development Studio。 2.在“文件”菜单上,指向“新建”,然后选择“项目”。 3.确保已选中“模板”窗格中的“Analysis Services 项目”。 4.在“名称”框中,将新项目命名为AdventureWorks。 5. 单击“确定”。 二、创建数据库和数据源 1.运行AdventureWorks sql server 2005示例数据库.msi,然后用SQL Server Management Studio 附加数据库AdventureWorks_Data.mdf 。 (1)运行AdventureWorks sql server 2005示例数据库.msi (2)用SQL Server Management Studio附加数据库AdventureWorks_Data.mdf 通信与信息工程学院 课程设计说明书 课程名称: 数据仓库与数据挖掘课程设计题目: 超市商品销售分析及数据挖掘专业/班级: 电子商务(理) 组长: 学号: 组员/学号: 开始时间: 2011 年12 月29 日完成时间: 2012 年01 月 3 日 目录 1.绪论 (1) 1.1项目背景 (1) 1.2提出问题 (1) 2.数据仓库与数据集市的概念介绍 (1) 2.1数据仓库介绍 (1) 2.2数据集市介绍 (2) 3.数据仓库 (3) 3.1数据仓库的设计 (3) 3.1.1数据仓库的概念模型设计 (4) 3.1.2数据仓库的逻辑模型设计 (5) 3.2 数据仓库的建立 (5) 3.2.1数据仓库数据集成 (5) 3.2.2建立维表 (8) 4.OLAP操作 (10) 5.数据预处理 (12) 5.1描述性数据汇总 (12) 5.2数据清理与变换 (13) 6.数据挖掘操作 (13) 6.1关联规则挖掘 (13) 6.2 分类和预测 (17) 6.3决策树的建立 (18) 6.4聚类分析 (22) 7.总结 (25) 8.任务分配 (26) 数据挖掘实验报告 1.绪论 1.1项目背景 在商业领域中使用计算机科学与技术是当今商业的发展方向,而数据挖掘是商业领域与计算机领域的乔梁。在超市的经营中,应用数据挖掘技术分析顾客的购买习惯和不同商品之间的关联,并借由陈列的手法,和合适的促销手段将商品有魅力的展现在顾客的眼前, 可以起到方便购买、节约空间、美化购物环境、激发顾客的购买欲等各种重要作用。 1.2提出问题 那么超市应该对哪些销售信息进行挖掘?怎样挖掘?具体说,超市如何运用OLAP操作和关联规则了解顾客购买习惯和商品之间的关联,正确的摆放商品位置以及如何运用促销手段对商品进行销售呢?如何判断一个顾客的销售水平并进行推荐呢?本次实验为解决这一问题提出了解决方案。 2.数据仓库与数据集市的概念介绍 2.1数据仓库介绍 数据仓库,英文名称为Data Warehouse,可简写为DW或DWH,是在数据库已经大量存在的情况下,为了进一步挖掘数据资源、为了决策需要而产生的,它并不是所谓的“大型数据库”。........ 2.2数据集市介绍 数据集市,也叫数据市场,是一个从操作的数据和其他的为某个特殊的专业人员团体服务的数据源中收集数据的仓库。....... 3.数据仓库 3.1数据仓库的设计 3.1.1数据库的概念模型 3.1.2数据仓库的模型 数据仓库的模型主要包括数据仓库的星型模型图,我们创建了四个 金融行业应用 1.前言 随着中国加入WTO,国内金融市场正在逐步对外开放,外资金融企业的进入在带来先进经营理念的同时,无疑也加剧了中国金融市场的竞争。金融业正在快速发生变化。合并、收购和相关法规的变化带来了空前的机会,也为金融用户提供了更多的选择。节约资金、更完善的服务诱使客户转投到竞争对手那里。即便是网上银行也面临着吸引客户的问题,最有价值的客户可能正离您而去,而您甚至还没有觉察。在这样一种复杂、激烈的竞争环境下,如何才能吸引、增加并保持最好的客户呢? 数据挖掘(Data Mining,DM)是指从大量不完全的、有噪声的、模糊的、随机的数据中,提取隐含在其中的、有用的信息和知识的过程。其表现形式为概念(Concepts)、规则(Rules)、模式(Patterns)等形式。用统计分析和数据挖掘解决商务问题。 金融业分析方案可以帮助银行和保险业客户进行交叉销售来增加销售收入、对客户进行细分和细致的行为描述来有效挽留有价值客户、提高市场活动的响应效果、降低市场推广成本、达到有效增加客户数量的目的等。 客户细分―使客户收益最大化的同时最大程度降低风险 市场全球化和购并浪潮使市场竞争日趋激烈,新的管理需求迫切要求金融机构实现业务革新。为在激烈的竞争中脱颖而出,业界领先的金融服务机构正纷纷采用成熟的统计分析和数据挖掘技术,来获取有价值的客户,提高利润率。他们在分析客户特征和产品特征的同时,实现客户细分和市场细分。 数据挖掘实现客户价值的最大化和风险最小化。SPSS预测分析技术能够适应用于各种金融服务,采用实时的预测分析技术,分析来自各种不同数据源-来自ATM、交易网站、呼叫中心以及相关分支机构的客户数据。采用各种分析技术,发现数据中的潜在价值,使营销活动更具有针对性,提高营销活动的市场回应率,使营销费用优化配置。 客户流失―挽留有价值的客户 在银行业和保险业,客户流失也是一个很大的问题。例如,抵押放款公司希望知道,自己的哪些客户会因为竞争对手采用低息和较宽松条款的手段而流失;保险公司则希望知道如何才能减少取消保单的情况,降低承包成本。 为了留住最有价值的客户,您需要开展有效的保留活动。然而,首先您需要找出最有价值的客户,理解他们的行为。可以在整个客户群的很小一部分中尽可能多地找出潜在的流失者,从而进行有效的保留活动并降低成本。接着按照客户的价值和流失倾向给客户排序,找出最有价值的客户。 交叉销售 在客户关系管理中,交叉销售是一种有助于形成客户对企业忠诚关系的重要工具,有助于企业避开“挤奶式”的饱和竞争市场。由于客户从企业那里获得更多的产品和服务,客户与企业的接触点也就越多,企业就越有机会更深入地了解客户的偏好和购买行为,因此,企业提高满足客户需求的能力就比竞争对手更有效。 研究表明,银行客户关系的年限与其使用的服务数目、银行每个账户的利润率之间,存在着较强的正相关性。企业通过对现有客户进行交叉销售,客户使用企业的服务数目就会增多,客户使用银行服务的年限就会增大,每个客户的利润率也随着增大。 数据挖掘实验报告-实验1-W e k a基础操作 学生实验报告 学院:信息管理学院 课程名称:数据挖掘 教学班级: B01 姓名: 学号: 实验报告 课程名称数据挖掘教学班级B01 指导老师 学号姓名行政班级 实验项目实验一: Weka的基本操作 组员名单独立完成 实验类型■操作性实验□验证性实验□综合性实验实验地点H535 实验日期2016.09.28 1. 实验目的和要求: (1)Explorer界面的各项功能; 注意不能与课件上的截图相同,可采用打开不同的数据文件以示区别。 (2)Weka的两种数据表格编辑文件方式下的功能介绍; ①Explorer-Preprocess-edit,弹出Viewer对话框; ②Weka GUI选择器窗口-Tools | ArffViewer,打开ARFF-Viewer窗口。(3)ARFF文件组成。 2.实验过程(记录实验步骤、分析实验结果) 2.1 Explorer界面的各项功能 2.1.1 初始界面示意 其中:explorer选项是数据挖掘梳理数据最常用界面,也是使用weka最简单的方法。 Experimenter:实验者选项,提供不同数值的比较,发现其中规律。 KnowledgeFlow:知识流,其中包含处理大型数据的方法,初学者应用较少。 Simple CLI :命令行窗口,有点像cmd 格式,非图形界面。 2.1.2 进入Explorer 界面功能介绍 (1)任务面板 Preprocess(数据预处理):选择和修改要处理的数据。 Classify(分类):训练和测试分类或回归模型。 Cluster(聚类):从数据中聚类。聚类分析时用的较多。 Associate(关联分析):从数据中学习关联规则。 Select Attributes(选择属性):选择数据中最相关的属性。 Visualize(可视化):查看数据的二维散布图。 (2)常用按钮大数据应用案例

数据挖掘实验三

数据挖掘实验报告 超市商品销售分析及数据挖掘

数据挖掘商业案例

数据挖掘实验报告-实验1-Weka基础操作